软件测试AI面试题库大全,如何快速通过面试?

要快速通过软件测试AI面试,核心在于:1、熟练掌握高频题库并套用标准答题模板、2、突出AI测试的差异化能力与落地案例、3、以量化数据证明质量提升、4、按风险与覆盖构建清晰思路、5、用一周冲刺法高效准备并现场结构化输出。同时结合岗位JD,定位重点工具与场景,避免面试走偏。

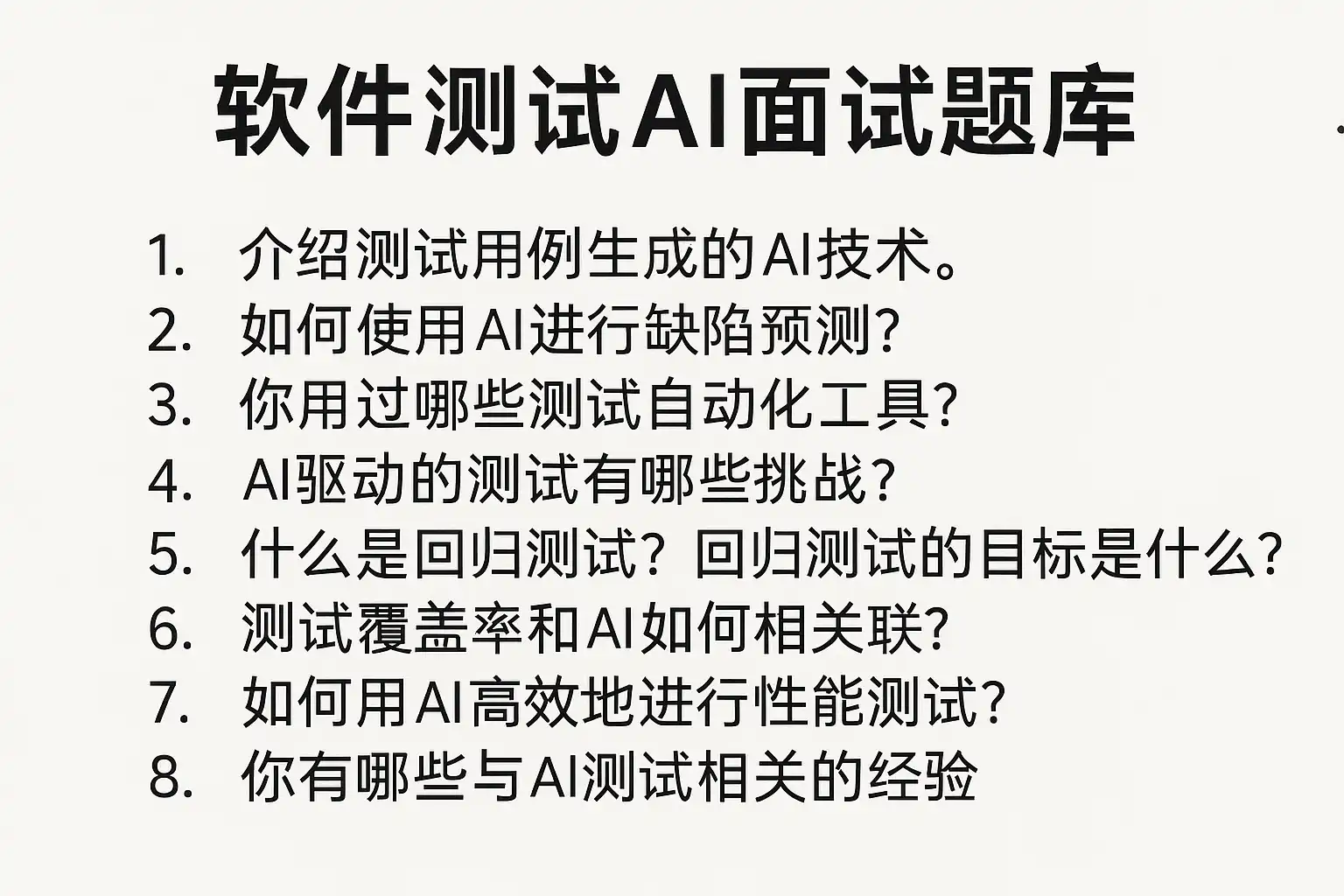

《软件测试AI面试题库大全,如何快速通过面试?》

一、速通策略与答题框架

-

面试速通“五件套”:

-

题库地图:按“基础测试/自动化/接口/性能/安全/AI模型/MLOps/质量度量/CI-CD”分类梳理高频题。

-

标准答题模板:场景-目标-方法-工具-指标-结果-反思(每题控制在60~120秒)。

-

数据化案例库:每类题至少准备2个项目案例,指标可落地(如覆盖率、缺陷率、F1、AUC、PSI、MTTR等)。

-

追问防御:准备“为什么这么做/风险和替代方案/如何量化”的二层回答。

-

仿真演练:3轮模拟,记录口误与逻辑断点,打磨到“顺畅、具体、可量化”。

-

通用答题框架(STAR+RQE):

-

S(情境)→ T(任务)→ A(行动)→ R(结果)+ RQ(风险与质量度量)→ E(经验与扩展)

-

关键表达金句:

-

“我按风险优先级构建用例集,覆盖核心交易路径与高风险边界。”

-

“AI场景我用‘数据质量→模型验证→部署监控→偏差治理’四层闭环。”

-

“我们把接口自动化纳入CI,每次提交触发回归,缺陷逃逸率下降40%。”

-

面试现场流程(3步):

-

先澄清场景与目标(15秒);给出结构化方法(60-90秒);用数据落地(15-30秒)。

表:题型-速答要点-指标-示例金句

| 题型 | 速答要点 | 常用指标 | 示例金句 |

|---|---|---|---|

| 测试设计 | 等价类/边界值/决策表/因果图/场景法 | 用例有效率、缺陷发现率 | “订单金额我用边界值穷举:0/1/9999/10000/Max。” |

| 自动化 | 分层架构、稳定性、数据驱动、CI触发 | 通过率、执行时长、覆盖率 | “PageObject+数据驱动,隔离定位与逻辑,稳定性提高到99%。” |

| 接口测试 | 协议/鉴权/状态码/幂等性/契约 | 响应时间、错误率、契约通过率 | “先契约校验再断言幂等,POST防重复用业务幂等键。” |

| 性能压测 | 场景设计、负载模型、瓶颈分析 | TPS、95RT、错误率、CPU/IO | “容量基准+峰值模拟,95RT≤200ms后再做降级验证。” |

| 安全 | OWASP、输入校验、权限模型 | 漏洞数量、修复SLA | “输入统一净化,业务权限用RBAC+ABAC双层。” |

| AI模型 | 数据质量、偏差/漂移、验证集、上线监控 | F1/AUC、PSI、KS、公平性差值 | “每周计算PSI,>0.25触发重训,维持效果稳定。” |

二、AI面试题库分类与高频考点总览

-

基础测试方法:

-

高频问法:等价类与边界值如何结合?如何做场景法覆盖支付异常?

-

关键点:风险驱动、可度量覆盖、可重复执行、场景抽象能力。

-

自动化测试(Web/App/接口):

-

高频问法:选择Selenium和Playwright的依据?如何提升自动化稳定性?

-

关键点:分层架构(PO/DSL)、选择器健壮性、数据隔离、并行执行、CI集成。

-

接口与协议(REST/GraphQL/gRPC):

-

高频问法:如何验证幂等?如何做契约测试?如何Mock依赖?

-

关键点:状态码矩阵、鉴权(OAuth/JWT)、Schema校验、服务隔离。

-

性能测试(JMeter/Locust):

-

高频问法:如何构造负载模型?如何定位性能瓶颈?

-

关键点:用户画像→并发曲线→资源采样→瓶颈归因(DB/网络/锁)。

-

安全测试(OWASP Top 10):

-

高频问法:XSS/SQL注入/权限绕过如何预防与验证?

-

关键点:输入净化、参数化查询、权限防横向越权、日志审计。

-

AI与数据测试:

-

高频问法:如何验证分类模型/推荐系统/LLM的质量?如何监控数据漂移?

-

关键点:数据质量(缺失、异常、偏态)、数据切分(train/val/test)、指标(Accuracy/F1/AUC/MAE/RMSE)、偏差与公平性(Demographic Parity、Equal Opportunity)、漂移(PSI/KS)、A/B实验。

-

MLOps与上线监控:

-

高频问法:如何在CI/CD中纳入模型评估?如何管理版本与回滚?

-

关键点:特征版本化、模型注册(MLflow)、灰度与回滚、在线监控告警。

-

测试管理与质量度量:

-

高频问法:如何定义覆盖率?如何制定质量门槛?

-

关键点:需求到用例可追溯、缺陷密度、逃逸率、MTTR、自动化覆盖、质量阈值进入/退出标准。

-

DevOps与交付:

-

高频问法:如何把测试融入Pipeline?如何在K8s上做环境隔离?

-

关键点:拉通Build-Unit-API/UI-Perf-Sec,多环境隔离,工件管理。

三、典型高频题与标准回答示例

-

问:如何设计一个登录模块的测试用例?

-

答:按风险和边界分层。功能层覆盖正常/异常(用户名为空、密码为空、错误格式);安全层覆盖暴力破解限制、错误次数锁定、验证码策略;接口层断言状态码与鉴权Token;性能层验证并发登录95RT;兼容层覆盖不同浏览器与APP分辨率。数据驱动保证重复性。最终以通过率、缺陷发现率和错误率为指标度量。

-

问:Selenium与Playwright如何选择?

-

答:看团队栈与稳定性。Selenium生态丰富、跨语言强;Playwright更快、选择器稳定性高、并发更优。我的策略是PO分层+数据驱动,无论框架都在CI中并行执行。以用例执行时长下降30%、稳定性≥99%为目标。

-

问:如何验证接口幂等与契约?

-

答:契约先行(OpenAPI/GraphQL Schema),再做幂等测试:重复提交、网络抖动、超时重试;使用业务幂等键与服务器侧去重。指标为契约校验通过率、错误率、重复订单率(趋近0)。

-

问:如何进行性能压测?

-

答:根据真实画像建模:峰值每秒请求数、会话时长、读写比例;先做容量基线,再做压力/稳定/降级测试。采样CPU、内存、GC、DB慢SQL,结合火焰图定位瓶颈。目标是95RT≤200ms、错误率≤1%、资源利用率平衡。

-

问:如何测试AI分类模型的效果?

-

答:流程为数据质量(缺失值/异常/偏态)→分层抽样切分train/val/test→指标选择(F1优先于Accuracy应对类不平衡;AUC衡量排序能力)→阈值调优(ROC/PR曲线)→偏差与公平性评估(不同人群TPR/TNR差异)→上线监控(PSI/KS漂移、误报/漏报趋势)。以F1≥既有版本+5%、PSI< 0.1稳定为门槛。

-

问:如何评估与测试推荐系统?

-

答:离线评估(HitRate/NDCG/覆盖率/多样性/新颖性)+在线A/B(CTR/CVR/停留时长/GMV)。对抗冷启动用内容特征与探索策略(ε-greedy/Thompson)。监控偏好漂移与长尾覆盖。以在线CTR提升≥3%且多样性不降低为目标。

-

问:如何测试LLM/生成式AI的质量?

-

答:构建任务化评估集合(问答/代码/摘要),设定Rubric与标注规范;自动指标(BLEU/ROUGE仅参考),重点用事实性/有害性/一致性人工评审与基准集评估;引入对抗提示与越权红队;上线监控“幻觉率/敏感语触发率”。通过安全过滤与提示工程降低幻觉与有害内容。

-

问:CI/CD中如何集成测试?

-

答:Pipeline分阶段:Unit→API契约→UI并发→性能基线→安全扫描→部署验证。质量门槛如单测覆盖≥80%、API错误率≤0.5%、UI稳定性≥98%、95RT≤200ms。不达门槛拒绝发布。报告沉淀于TestRail/Allure,告警入Slack/飞书。

-

问:如何做数据漂移监控与回滚?

-

答:线上定期计算PSI/KS;当PSI>0.25触发告警与重训流程。模型与特征版本化(MLflow),灰度发布+影子流量对比;出现效果下降则一键回滚到上版本。告警SLA≤15分钟,回滚≤30分钟。

四、面试实战:一周速通计划与现场策略

-

7天冲刺计划:

-

Day1:拆解JD,标注核心栈(Web/App/接口/AI方向);建立题库目录与案例清单。

-

Day2:强化测试设计方法,写出10个业务场景的边界表与决策表。

-

Day3:自动化与接口实操,完成一个小项目的API自动化+UI稳定性优化。

-

Day4:性能与安全,跑JMeter基线与3个OWASP演示用例。

-

Day5:AI测试专项,完成一个分类或推荐模型的评估与漂移监控Demo(Evidently/Great Expectations)。

-

Day6:2次模拟面试,录音回放,优化表达与数据化。

-

Day7:整理作品集与度量面板(覆盖率、F1/AUC、PSI、缺陷逃逸率、MTTR),准备3分钟项目陈述。

-

现场策略:

-

开场30秒:定位岗位与差异化优势(如“我在AI场景做过PSI监控与灰度评估”)。

-

答题结构:一句目标、三步方法、两个指标、一个风险反思。

-

白板能力:将复杂问题可视化(流程图/用例矩阵/指标面板),展示抽象与结构力。

-

追问处理:

-

Why:解释原理与权衡。

-

Risk:给出替代方案与兜底机制。

-

Metric:用数据闭环支撑结论。

五、作品集、简历与演示环境

-

作品集要素:

-

项目简述(场景/规模/角色)

-

方法与工具(如Selenium+PyTest、Postman+Newman、JMeter、Evidently/MLflow)

-

指标与结果(UI稳定性99%、API错误率≤0.3%、95RT≤180ms、F1+6%、PSI< 0.1)

-

关键挑战与解决(定位瓶颈、数据偏差、环境不稳定)

-

可视化报告链接(Allure/TestRail、Grafana、MLflow)

-

简历“量化四句式”:

-

目标:提升X质量指标

-

方法:采用Y技术/流程

-

结果:指标变化(百分比/时长/稳定性)

-

扩展:可复用沉淀(框架/模板/规范)

-

演示环境准备:

-

代码仓库与README(如何运行测试)

-

数据集与评估脚本(分类/推荐/LLM)

-

报表快照与仪表盘(Grafana/MLflow)

六、工具栈与资源清单(含i人事)

-

常用工具:

-

测试:Selenium/Playwright、Appium、Postman/Newman、REST Assured、PyTest、Robot Framework、Allure、TestRail

-

性能:JMeter、Locust、k6、火焰图(Async-Profiler)

-

安全:OWASP ZAP、Burp Suite

-

DevOps:GitHub Actions、Jenkins、GitLab CI、Docker、Kubernetes

-

AI/数据:Great Expectations、Evidently AI、MLflow、Weights & Biases、TFX、Kubeflow、Seldon、Apache Airflow

-

学习与题库资源:

-

OWASP Top 10文档与示例

-

JMeter官方最佳实践

-

Playwright官方测试示例库

-

机器学习模型评估指南(F1/AUC/ROC/PR)

-

数据漂移与公平性评估(PSI、KS、Demographic Parity)

-

企业与人才管理平台:

-

许多企业通过ATS管理招聘流程与在线测评,熟悉平台流程有助于匹配用人方规范。例如“i人事”在人力资源数字化与招聘管理上的应用广泛,理解其流程能提高沟通效率。i人事官网: https://www.ihr360.com/?source=aiworkseo;

七、常见追问与陷阱题化解

-

陷阱1:只讲工具不讲方法

-

化解:回到风险驱动与覆盖策略,工具只是手段。

-

陷阱2:指标堆砌不落地

-

化解:讲清采样方法与基线建立;指标与业务目标绑定。

-

陷阱3:忽略AI的漂移与偏差

-

化解:加入“数据质量→模型验证→监控→治理”的闭环与门槛。

-

陷阱4:自动化“一把梭”

-

化解:分层与ROI评估;业务高频与稳定场景优先。

-

常见追问示例与答法:

-

问:为什么选F1而不是Accuracy?

-

答:类不平衡场景中,Accuracy会被多数类掩盖,F1更能综合反映精确率与召回率。

-

问:如何证明UI定位稳定?

-

答:选择器策略(data-test-id优先)、重试机制、失败截图与日志、近3个月稳定性≥98%。

八、不同岗位侧重点对比

| 岗位类型 | 关注重点 | 典型问题 | 必备指标 |

|---|---|---|---|

| 测试工程师(功能/接口) | 场景覆盖、稳定性、契约与幂等 | 设计用例、接口鉴权、异常流 | 覆盖率、错误率、契约通过率 |

| SDET/自动化 | 框架设计、分层、CI、并行 | 架构如何避免脆弱性?如何落地并行? | 执行时长、稳定性、自动化覆盖 |

| 性能测试 | 负载建模、瓶颈定位 | 峰值场景构造、火焰图分析 | 95RT、TPS、资源利用率 |

| 安全测试 | Top10风险、权限模型 | 如何防越权/XSS/注入? | 漏洞数量、修复SLA |

| AI测试/数据质量 | 模型评估、偏差与漂移、实验设计 | 如何选指标?如何监控与回滚? | F1/AUC、PSI/KS、在线CTR |

九、AI系统测试的风险清单与防护

-

数据层:

-

风险:样本偏差、标签噪声、分布漂移、隐私泄露

-

防护:分层抽样、双人标注一致性、PSI/KS监控、脱敏与最小化采集

-

模型层:

-

风险:过拟合、性能退化、不可解释

-

防护:交叉验证、早停与正则、SHAP/LIME辅助解释

-

服务层:

-

风险:延迟波动、资源争用、依赖不可用

-

防护:限流熔断、降级与缓存、依赖Mock与重试策略

-

伦理与合规:

-

风险:不公平决策、敏感属性滥用、生成有害内容

-

防护:公平性评估、策略白名单、内容过滤与红队演练

-

上线与监控:

-

风险:不可控回归、版本冲突、告警迟滞

-

防护:灰度发布、影子流量对比、SLA化告警与自动回滚

十、总结与行动清单

-

主要观点:

-

快速通过面试的核心在于“题库熟练+结构化答题+数据化案例+AI差异化能力”。

-

将测试抽象为“风险→覆盖→度量→优化”的闭环,并以指标落地支撑可信度。

-

AI测试要补齐“数据/模型/监控/治理”四段链路与公平性、漂移等专项能力。

-

行动清单(48小时版本):

-

拆解目标岗位JD,列出10道高频题并用模板写出答案。

-

准备2个可量化项目案例,提炼“方法-指标-结果-反思”。

-

跑通一个API自动化与一个性能基线Demo;完成一个AI评估脚本(F1/AUC+PSI)。

-

整理作品集与报告快照,形成3分钟讲述话术。

-

进行1~2次模拟面试,优化表达与追问应对。

-

进一步建议:

-

面试前一晚复盘“指标面板与风险清单”,现场用白板可视化你的结构化思路。

-

面试后记录追问点,补充到题库与案例中,形成持续进化的竞争力。

精品问答:

软件测试AI面试题库大全中,哪些题型最常见?

我准备软件测试AI面试,想知道面试题库里哪些题型出现频率最高,重点准备哪些内容能更有效率?

在软件测试AI面试题库大全中,常见题型主要包括:

- 自动化测试脚本编写(占比约40%)

- 测试用例设计与优化(占比约30%)

- 缺陷管理及追踪工具使用(占比约15%)

- 测试理论与方法(占比约15%) 通过重点复习自动化测试脚本和测试用例设计,可以覆盖70%以上的面试内容,提高通过率。

如何利用软件测试AI面试题库大全快速提升面试通过率?

我感觉面试题库内容很多,不知道怎么高效利用题库资源,快速提升面试表现,有没有实用的学习方法?

快速提升面试通过率的关键策略包括:

- 制定每日学习计划,分阶段攻克题库中的重点题型

- 结合真实案例,如用Selenium完成自动化测试脚本,理解原理与实操

- 使用表格归纳常见错误及解决方案,强化记忆

- 通过模拟面试检验掌握程度,针对薄弱环节反复练习 数据显示,系统化复习能提升面试通过率至少30%。

软件测试AI面试中常用的自动化测试工具有哪些?

作为软件测试初学者,我对自动化测试工具了解不多,不知道面试中常被问及哪些工具,如何准备相关问题?

面试中常见的自动化测试工具包括:

| 工具名称 | 功能描述 | 适用场景 |

|---|---|---|

| Selenium | 跨浏览器自动化测试 | Web应用测试 |

| JUnit | 单元测试框架 | Java项目单元测试 |

| Postman | API接口测试工具 | RESTful API测试 |

| 了解工具的基本原理及应用场景,结合具体案例编写简单测试脚本,是面试准备的重点。 |

软件测试AI面试题库大全如何帮助理解测试理论与方法?

我对测试理论和方法的理解不够深入,想知道题库中是否有针对这部分的内容,如何通过题库加深理解?

软件测试AI面试题库大全中包含大量关于测试理论(如黑盒测试、白盒测试、冒烟测试等)和方法的题目,通过以下方式加深理解:

- 针对每种测试方法,结合实际项目案例分析其应用效果

- 使用列表形式总结各测试类型的优缺点,例如:

- 黑盒测试:无需源码,适合功能验证,但覆盖率有限

- 白盒测试:代码层面检查,覆盖率高,但需具备编程能力

- 通过题库中的情景题,练习如何选择合适的测试策略,提升理论与实践结合能力 研究表明,掌握测试理论能提高缺陷发现率20%以上。

文章版权归"

转载请注明出处:https://irenshi.cn/p/387971/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。