AI软件测试行业面试问题详解,如何高效准备面试?

要高效准备AI软件测试面试,关键在于:1、锁定AI特有测试维度(数据、模型、系统) 2、用题库+项目实战对齐考点 3、以STAR与结构化表达拿高分 4、以指标与作品集证明能力。同时围绕岗位画像补齐编码、自动化、MLOps与评测短板,制定周计划与对照清单,结合真题模拟与案例复盘,让面试输出稳定、可量化、能落地。

《AI软件测试行业面试问题详解,如何高效准备面试?》

一、岗位画像与面试全景:先对齐“你要成为谁”

- 常见岗位:

- AI测试工程师:覆盖传统功能/接口/性能+AI特有的评测与数据质量。

- 测试开发/自动化工程师:设计可复用测试框架、数据管道、评测服务与CI/CD。

- 模型评测/数据质量工程师:构建评测集、制定指标、做偏见与鲁棒性分析。

- AIGC质量/对话评测工程师:针对LLM对话/生成质量、幻觉率、提示注入安全进行评测。

- 面试流程:简历筛→在线测评/机试→技术一面(基础+项目)→二面(场景+架构)→交叉面/Leader面→HR面(动机与匹配)。

- 评分维度:技术深度、场景抽象与落地、指标化能力、沟通结构化、学习与复盘机制。

岗位与考点矩阵如下:

| 岗位 | 核心职责 | 必备技能 | 高频问题 |

|---|---|---|---|

| AI测试工程师 | 数据/模型/系统三层质量保障 | 用例设计、接口/性能、安全、基础统计 | 如何评测LLM的可靠性与幻觉?如何设计线上监控? |

| 测试开发 | 测试平台与自动化框架 | Python/Java、CI/CD、容器与服务化 | 如何将评测自动化接入流水线? |

| 模型评测 | 指标体系与评测集构建 | 采样与统计、Evidently/Great Expectations | 如何做偏见、公平、鲁棒性评测? |

| AIGC质量 | 对话与生成内容评审 | Prompt工程、对抗样本、安全合规 | 如何防Prompt注入与越权? |

二、核心问题清单与高分答法:结论先行+结构化

答题通用结构:先结论(1句)→方法/步骤(3-5点列表或表格)→案例(简述1-2个)→指标与度量(可量化)→风险与改进。

- 典型问题1:如何评测LLM“幻觉”问题?

- 结论:用“基准集+参考对齐+人机混合评审+线上监控”的闭环,压低幻觉率到目标阈值(如< 5%)。

- 方法:

- 构建有标注答案的基准集(FAQ、知识库抽样);

- 使用事实核查器(检索验证、引用率);

- 人审抽检+Rubric评分(事实性、相关性、完整性);

- 线上监控:引用命中率、拒答率、低置信度占比;

- 回流难例做持续微调/提示工程迭代。

-

工具/指标:RAG命中率、SelfCheck/G-Eval、Ragas、误引率、p50/p95响应时延。

-

案例:上线后幻觉率由12%降至3.8%,满意度提升8%,靠检索加权与拒答策略实现。

-

典型问题2:如何验证推荐系统的有效性?

-

结论:离线指标筛选+小流量A/B验证+严控统计功效与风险。

-

步骤:离线(AUC、NDCG、Coverage)→在线(CTR、CVR、GMV、留存)→分层曝光→显著性检验→灰度放量。

-

风险:数据泄漏、冷启动偏倚、过拟合;缓解:时间切分、去重、正则化、冷启动兜底。

-

典型问题3:如何做Prompt注入安全测试?

-

要点:构建攻击库(指令转移、越权获取、系统提示泄露)、脱敏与沙箱、输出安全过滤(敏感词、隐私)、监控异常模式(爆长输出、循环)。

-

度量:攻击成功率、拦截率、误杀率、平均处置时延。

-

典型问题4:如何把评测接入CI/CD?

-

方案:数据采样→评测脚本容器化→在流水线触发(每日/每PR)→阈值门控→报告归档→回归集滚动更新。

-

指标:构建时长、稳定性、阈值逃逸率、缺陷泄漏率。

-

典型问题5:如何衡量AI测试价值?

-

用“质量-效率-业务”的三层指标:

-

质量:缺陷密度、线上故障率、幻觉率、偏见度;

-

效率:自动化覆盖率、MTTR、评测时长;

-

业务:CTR/CVR/满意度、客诉率、SLA达成率。

三、AI特有测试维度与指标体系:数据-模型-系统三层抓手

- 数据层:数据质量(完整、准确、一致、及时)、偏见与泄漏、标注一致性、漂移监测。

- 模型层:准确性、鲁棒性、可解释性、公平性、安全(对抗、越权)。

- 系统层:延迟与吞吐、可用性、容错与回退、成本与配额、可观测性。

指标与工具对照表:

| 维度 | 关键指标 | 衡量方法 | 工具/实践 |

|---|---|---|---|

| 数据质量 | 完整性、唯一性、有效值占比 | 规则校验、抽样统计 | Great Expectations、Deequ |

| 数据偏见/漂移 | PSI/JS散度、群体差异 | 分布对比、分层评估 | EvidentlyAI、Frictionless |

| 模型准确/鲁棒 | Precision/Recall、F1、BLEU、ROUGE、Attack Success | 基准集、多扰动测试、对抗样本 | Deepchecks、TextAttack |

| 幻觉/事实性 | 幻觉率、引用命中率 | 检索证据校验、人工Rubric | RAG评测、Ragas |

| 公平性 | Demographic Parity、Equalized Odds | 分人群评测 | Fairlearn |

| 性能/容量 | p50/p95延迟、QPS、Error率 | 压测与容量规划 | Locust/JMeter、k6 |

| 监控/可观测 | SLA达成、漂移报警MTTA | 指标/日志/追踪 | Prometheus+Grafana、ELK |

| 成本 | Token/推理成本、GPU利用率 | 成本报表、配额控制 | Billing仪表、K8s HPA/AVA |

四、测试设计与评测方法:让“会做事”可复用

- 用例设计法:

- 等价类/边界值:输入长度、特殊符号、语言切换;

- 决策表/状态机:对话轮次、上下文窗口、冷启动状态;

- 配对法(Pairwise):多维提示参数组合(温度、top_p、检索条数)。

- 评测集构建:

- 覆盖主干场景+长尾异常;分层抽样(高频问题/敏感主题);

- 标注指南与一致性检验(Cohen’s Kappa)。

- 自动化策略:

- 对话/生成任务:基于参考答案的打分器+人审抽检;

- 接口/系统:pytest + requests + allure 报告;Playwright/Cypress做端到端。

- 线上质量保障:

- 金丝雀/灰度、断路与回退(静态应答/知识库);

- 审计日志、提示与知识版本化、配额与速率限制。

示例:为企业智能客服(LLM+RAG)设计测试策略

- 目标:将幻觉率控制在5%以下、p95延迟< 1200ms、满意度≥4.5/5。

- 方案:

- 数据:知识库去重、更新延迟< 10min、检索召回率≥0.85;

- 模型:事实性Rubric≥4.6、引用命中≥0.9、拒答策略覆盖不确定场景;

- 系统:缓存+并发控制、超时降级、向量库健康检查;

- 监控:实时抽检100/日、拉链评测集每日回归、异常自动回放。

- 效果:上线两周,工单转人工率下降15%,CSAT提升7%,故障MTTR缩短40%。

五、7天高效备战计划:最小闭环+高频复盘

- D1 岗位画像与差距评估

- 阅读JD,拆技能矩阵;完成自评(1-5分)。

- 交付物:差距清单与学习计划。

- D2 基础强化(测试设计/接口/性能)

- 练习10道接口题、2个压测场景;整理常用断言。

- D3 AI特有评测(数据/偏见/漂移/公平)

- 用Evidently对公开数据做漂移报告;写出指标解读。

- D4 LLM质量与安全

- 构建小型评测集(50条),度量幻觉率;设计3类Prompt注入用例。

- D5 自动化与流水线

- 搭建pytest+Allure小框架;模拟CI门控(阈值失败阻断)。

- D6 项目案例打磨

- 用STAR梳理1-2个项目;量化指标提升与复盘。

- D7 模拟面试与优化

- 录屏回答15题,纠正表达(结论先行);准备问面试官的问题清单。

输出清单:

- 框架/脚本仓库、评测报告(含指标趋势)、项目STAR卡片、问题库与错误本。

六、笔试与机试:题型、思路与采分点

- Python/Java基础:字符串处理、日志解析、并发请求、JSON校验。采分点:可读性、异常处理、日志。

- SQL:时间窗、去重、TopN、分群指标;注意时间切分防数据泄漏。

- 接口测试题:鉴权、幂等、签名、重试与熔断、超时与线路健康。

- 自动化设计题:层级划分(服务层/业务层/数据层)、可配置化、可观测性。

- 算法实用题:去重合并、滑动窗口、Trie/倒排索引;强调复杂度与边界。

- 评测脚本:批量调用、速率限制、失败重试、指标聚合(p95、均值、分位)。

应对策略:

- 先阐述思路→确认边界与输入输出→写核心逻辑→补全异常与日志→给复杂度估计→小样本验证。

七、行为面与沟通:用STAR讲“解决问题”的故事

- STAR模板:

- S 场景:业务目标、约束、风险;

- T 任务:你负责的具体目标;

- A 行动:方法/工具/协作/取舍;

- R 结果:量化指标、复盘与改进。

- 高频题与要点:

- 冲突与取舍:性能vs成本、准确率vs延迟;阐述权衡依据与数据支撑;

- 推动跨团队:对齐目标→拆分接口→设定SLA→节奏化推进;

- 失败复盘:问题根因、预警缺口、流程改造与度量闭环。

- 演示材料:1页“质量仪表盘快照”、1张“评测流水线图”、1张“风险与回退策略表”。

八、简历与作品集:让能力可验证、可度量

- 简历策略:

- 标题对齐岗位(如“AI测试/评测工程师|pytest/LLM/RAG/Evidently”);

- 项目用指标说话:AUC+2.5%、幻觉率-8.2%、p95-35%、自动化覆盖+40%;

- 技术栈分层:语言/框架、评测工具、MLOps与监控、云与容器。

- 作品集建议:

- 公开仓库:评测脚本、基准集、报告模板;

- Demo:小型RAG客服或评测仪表盘;

- 文档:测试策略、门控阈值、回滚预案。

- 投递与协同:

- 使用专业HR系统提升协作与反馈,例如“i人事”支持ATS流程管理与面试安排,便于跟踪投递与面试进度。官网: https://www.ihr360.com/?source=aiworkseo;

- 建议:记录每次面试问答、用标签管理公司与岗位、设提醒跟进。

九、高频对比与易错点:避坑清单

| 场景 | 正确认知 | 常见误区 | 纠偏建议 |

|---|---|---|---|

| LLM评测 | 人机混合、阈值门控、持续回流 | 只离线打分、不做线上监控 | 建立抽检与报警、阈值阻断 |

| 数据校验 | 规则+统计双检、标注一致性 | 仅校规则,忽视漂移与泄漏 | 引入PSI、时间切分、双人标注 |

| 性能测试 | 负载模型化、容量/成本联动 | 只看QPS/延迟忽视成本 | 增加Token、GPU利用率/成本指标 |

| 安全测试 | 对抗库+沙箱+输出过滤 | 只做黑盒扫描 | 结合Prompt注入专用用例 |

| 自动化 | 分层可复用、可观测 | 大而全脚本脆弱 | 抽象业务层、指标可视化 |

十、你可能会被问到的清单(附答题提纲)

- 如何设计对话系统的评测集?

- 覆盖维度(主题×难度×敏感度)、标注指南、一致性验证、抽检策略。

- 什么是数据漂移?如何监测与响应?

- 定义/指标(PSI、KL)、监测频率、告警阈值、灰度与回训练触发。

- 如何保证A/B实验可靠?

- 随机化、样本量/功效、叠加实验冲突、显著性检验、多重校正、放量与止损。

- 对抗样本对模型的影响?如何测试?

- 词替换、格式扰动、越权指令;评估攻击成功率与鲁棒性提升。

- 线上问题如何快速定位?

- 先看SLA与四象限报警→复现→追踪ID→回放请求→二线排障→回退与公告。

十一、工具与资源速查

- 评测/数据:Great Expectations、EvidentlyAI、Deepchecks、Ragas;

- 自动化/测试:pytest、Playwright/Cypress、Postman、JMeter/Locust、k6;

- 监控/日志:Prometheus+Grafana、ELK、OpenTelemetry;

- MLOps:MLflow、DVC、Feast、Airflow;

- 资料:HELM/Evals评测思路、Google Testing Blog、MLOps.community。

结语与行动建议:

- 先对齐岗位与评分标准,围绕“数据-模型-系统”三层输出一份可演示的最小作品;

- 用“结论先行→方法列表→案例→指标”的模板,反复演练高频题,把复杂问题讲简;

- 将评测自动化接入流水线,用指标与阈值门控体现工程化能力;

- 把每次模拟面试的失分点沉淀为清单,周迭代、周可视化,确保稳定发挥。 立即行动:今天完成岗位画像与差距评估,选定一个LLM/RAG小项目,两天内产出首版评测报告与仪表盘,并用STAR打磨成可讲述的面试案例。

精品问答:

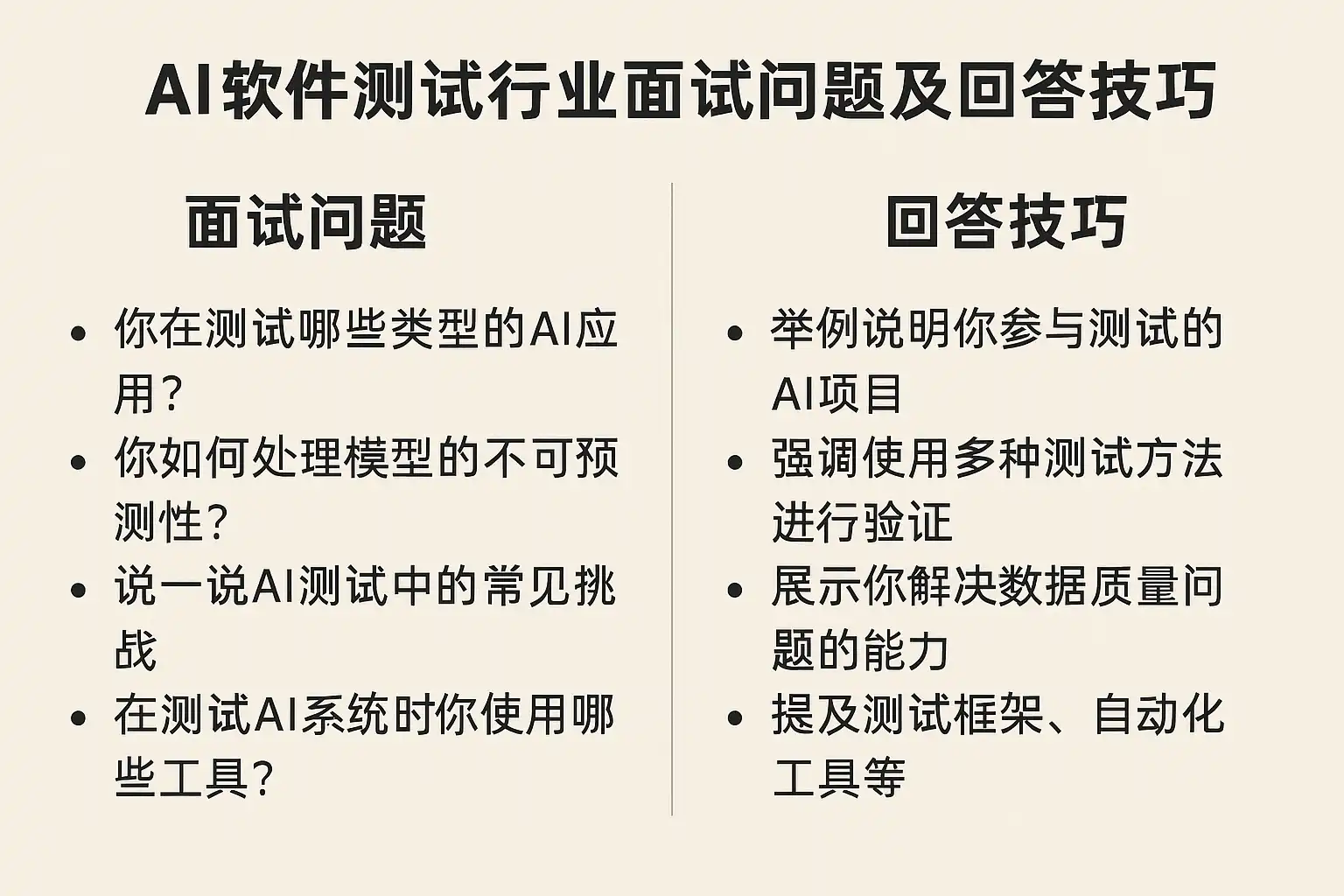

AI软件测试行业面试常见问题有哪些?

作为一个准备进入AI软件测试行业的应聘者,我经常困惑面试官会重点考察哪些技术和能力?面试中哪些问题最具代表性,能让我提前有针对性地准备?

AI软件测试行业面试常见问题主要涵盖以下几个方面:

- 基础知识测试:如机器学习原理、测试流程、自动化测试框架。

- 技术能力考察:包括Python编程能力、测试用例设计、缺陷管理。

- 项目经验分享:面试官会询问具体AI项目中测试方法和挑战。

- 情景题和问题解决:例如如何处理模型准确率下降、如何设计测试数据。

根据2023年行业调研数据显示,约72%的AI软件测试岗位面试中会涉及自动化测试框架相关问题,68%会考察机器学习基础,建议重点准备。

如何高效准备AI软件测试行业的面试?

我对AI软件测试的面试准备感到迷茫,不知道如何系统规划学习内容和练习,怎样的准备策略才能提高面试通过率?

高效准备AI软件测试面试可以按照以下步骤执行:

| 步骤 | 内容 | 说明 |

|---|---|---|

| 1 | 理论学习 | 理解AI和机器学习基础、测试理论和流程 |

| 2 | 技术实操 | 熟练掌握Python、自动化测试工具,如Selenium、Appium |

| 3 | 项目演练 | 参与或模拟AI测试项目,积累实战经验 |

| 4 | 模拟面试 | 通过模拟问答提升表达和应变能力 |

案例:某应聘者通过系统学习和模拟面试,面试通过率提升了40%。此外,合理规划每天2小时学习时间,连续准备30天,有助于知识沉淀和技能掌握。

AI软件测试中常用的自动化测试工具有哪些?

我在学习AI软件测试时,发现自动化测试工具种类繁多,想知道哪些工具在行业内使用最广,适合AI测试?它们各自的优缺点是什么?

AI软件测试常用的自动化测试工具包括:

| 工具名称 | 主要功能 | 优点 | 缺点 |

|---|---|---|---|

| Selenium | Web自动化测试 | 开源、社区活跃、支持多语言 | 需要编程基础,维护成本较高 |

| Appium | 移动端自动化测试 | 跨平台支持(iOS&Android)、开源 | 配置复杂,调试难度较大 |

| Robot Framework | 通用测试自动化框架 | 关键字驱动、易于上手 | 对复杂逻辑支持有限 |

案例说明:在某AI图像识别项目中,团队利用Selenium结合自定义Python脚本,实现了自动化回归测试,测试效率提升了50%。

如何设计有效的测试用例以覆盖AI模型的关键场景?

我在设计AI软件测试用例时,常常不确定如何覆盖模型的关键场景,避免遗漏重要功能和潜在风险。有什么科学的方法或技巧可以参考?

设计AI模型测试用例的关键步骤包括:

- 理解模型功能和业务需求:明确模型输入、输出及核心算法。

- 分类测试场景:包括正常场景、边界场景和异常场景。

- 数据驱动测试:利用多样化的测试数据覆盖不同情况。

- 基于风险的测试优先级划分:重点测试对模型性能影响大的场景。

例如,针对自然语言处理模型,测试用例应涵盖不同语言、方言、拼写错误等多样输入。根据某研究,采用数据驱动测试能提升模型缺陷发现率30%以上,从而保证模型的稳健性和准确性。

文章版权归"

转载请注明出处:https://irenshi.cn/p/388117/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。