AI智能面试弊端解析,真的影响求职公平吗?

在目前多数应用场景下,AI智能面试确有可能影响求职公平,但并非必然结果,关键取决于数据质量、算法设计与治理水平。核心观点为:1、算法与数据偏差会放大对某些群体的不利影响、2、评估逻辑不透明导致候选人无法有效申诉、3、语音/表情识别在口音与情境上易失真、4、缺乏外部审计与纠偏机制时风险更高。只要在设计与落地中引入结构化标准、人机协作与合规监控,AI面试可以在提升效率的同时尽量守住公平底线。

《AI智能面试弊端解析,真的影响求职公平吗?》

一、核心结论与判定

AI智能面试是否影响求职公平,取决于“模型—流程—治理”三层的协同质量。从当前行业实践看:

- 当训练数据存在代表性不足、标签主观与历史偏见时,模型评分会在不同群体之间产生系统性差异;

- 当评估标准不公开且模型不可解释,候选人难以理解与申诉,公平感知与实际公平均受损;

- 当纯机器评分替代人类复核、且无持续监测机制时,风险显著上升。 但在采用结构化题库、人机协作复核、性能分群验证与申诉通道等措施后,公平性可显著提升。因此结论是:AI面试具有“可控风险”,若治理到位,可降低不公平;若治理不足,确实会影响求职公平。

二、AI智能面试的工作原理

- 输入层:视频/音频/文本(自我介绍、行为面试题、情景题)

- 处理层:语音识别(ASR)、自然语言处理(NLP)、计算机视觉(CV)与情感/表情识别

- 评估层:基于特征的评分模型(如回答结构、关键词覆盖、语义相关度、稳定性、礼仪与职业性等维度)

- 输出层:综合评分、维度面板、风险提醒、候选人排序与面试官建议

- 决策层:直接或辅助用于筛选、进入下一轮、或结合人评复核

典型流程:

- 题库生成与标准设定(岗位胜任力模型、评分规则)

- 候选人作答并被系统采集

- 模型转写/解析与特征抽取

- 维度评分与综合决策

- 人力复核与申诉处理(理想状态)

- 持续监测与模型更新

三、弊端清单与机制解析

- 数据与标签偏差:历史录用数据可能反映旧时代偏好(如特定学校、地区),模型学到的“成功模式”不具备公平性。

- 口音与噪音影响ASR:非标准口音、方言或安静环境不足会导致转写错误,进而影响NLP得分。

- 表情/姿态识别失真:摄像头角度、光线与文化表达差异导致非语言特征误判。

- 情境失真与提示敏感:候选人设备与网络差异、提示工程不一致,使输出受外在因素影响。

- 不透明规则:维度权重、阈值与拒绝原因不披露,候选人无从优化或申诉。

- 冷启动与泛化不足:新岗位与新人群无足够样本,模型稳定性下降。

- 安全与隐私:视频与语音是敏感数据,若采集范围过宽或存储治理不足,存在合规风险。

- 候选人体验:缺乏反馈与沟通,易产生被机器“过度量化”的反感。

下面以表格呈现核心弊端的产生机制、后果与缓解措施:

| 弊端类别 | 产生机制 | 典型后果 | 可缓解措施 |

|---|---|---|---|

| 数据/标签偏差 | 历史样本代表性不足、主观评分做训练标签 | 某群体平均分显著偏低 | 分群采样、重加权训练、独立审计与拒绝原因分析 |

| ASR口音误差 | 方言/口音、设备噪音 | 转写错误导致语义评分降低 | 多口音模型、降噪提示、语音质量门槛与重试机制 |

| 表情识别失真 | 光线/角度/文化差异 | 非语言维度误判礼仪与自信 | 降低权重、以语言内容为主、环境指导 |

| 不透明规则 | 未公开维度与权重 | 无法申诉、感知不公平 | 可解释报告、阈值公布范围、申诉通道 |

| 冷启动风险 | 新岗位样本少 | 稳定性差、误拒新型人才 | 人机协作复核、渐进上线、在线监测 |

| 安全与隐私 | 采集过度/存储不当 | 合规风险与信任受损 | 最小必要采集、加密与脱敏、数据生命周期管理 |

| 候选人体验 | 缺少反馈与指导 | 参与度下降、品牌受损 | 面试前告知、练习沙盒、反馈摘要 |

四、是否影响求职公平:证据与案例

- 语音识别差异:在多语言/多口音环境中,转写错误率通常存在显著群体差异;一些公开评测显示不同口音的词错率差距可达个位数到两位数百分点区间,当NLP评分依赖文本质量时,误差会传导到综合得分。

- 非语言特征的文化差异:表情与目光接触在不同文化里的含义不同,将其直接映射为“自信/礼貌”易造成误判。若模型权重高,会对某些文化表达群体不利。

- 历史偏好放大:如果将过去的“优秀员工画像”直接作为训练目标,模型可能沿用旧有偏好(如对某些院校或年龄段的偏好),这会系统性影响公平。

- 案例示意:某公司在应届生岗位上线AI初筛后发现,地区A候选人的进入二面比例下降。排查发现方言口音导致ASR误差偏高。通过引入多口音模型与语言维度权重下调后,地区A的二面比例恢复接近历史均值,且整体用人质量未下降。

结论:影响公平的风险真实存在,且主要源于技术与流程的可预见问题;通过设计与治理可显著缓解。

五、企业与平台如何降低风险

- 定义公平目标与监测指标:明确要守的公平边界(如机会均等、误拒率差距不超过设定阈值)。

- 数据治理:确保训练数据多样、代表性强;对历史标签做偏差审计与再标注。

- 人机协作:AI给出建议分,关键节点保留人类面试官复核与override权限。

- 结构化面试:统一题库与评分标准,减少随机性,聚焦与岗位相关的胜任力维度。

- 分群测试与上线门槛:按性别、地区、教育背景、口音等合理分群,比较评分与通过率差异,未达标不全量上线。

- 可解释与告知:输出维度得分与短评,公开评估逻辑范围,允许候选人申诉与补充材料。

- 技术防偏:重加权训练、对抗验证、阈值校准、语音与视觉维度降权。

- 隐私与合规:最小采集、用途限定、加密存储与访问审计,遵循本地法律法规。

- 持续监测与再训练:上线后建立长期监控与周期性再评估机制。

| 措施 | 直接影响 | 实施要点 | 成本/难度 |

|---|---|---|---|

| 结构化题库与评分 | 提高一致性,降低主观差 | 明确胜任力与评分锚点 | 中 |

| 分群公平评测 | 发现群体差异 | 设定阈值与报警规则 | 中 |

| 人机协作复核 | 拦截误判 | 明确复核标准与责任 | 中-高 |

| 可解释报告与申诉 | 增强信任与纠正机制 | 标准化反馈模板 | 低-中 |

| 多口音ASR与降噪 | 降低语音误差传导 | 设备指导与重试机制 | 中 |

| 数据再标注与审计 | 缓解训练偏差 | 外部审计/双盲标注 | 高 |

六、候选人如何应对

- 认真阅读告知与评分维度:理解系统关注点(结构化回答、关键词覆盖、条理性)。

- 优化作答环境:安静、光线充足、摄像头正面;测试麦克风与网络。

- 结构化表达法:STAR(情境-任务-行动-结果),突出岗位相关能力与量化成果。

- 口音与语速:确保清晰度,必要时放慢语速并重述关键点。

- 要求反馈与申诉:如遇明显识别错误或不合理拒绝,主动申请人类复核。

- 记录与准备:保存作答内容与系统反馈,用于后续沟通或面试提升。

七、与传统面试的公平性对比

| 维度 | 传统面试 | AI智能面试 |

|---|---|---|

| 一致性 | 面试官风格差异大 | 规则统一、可复制 |

| 主观偏见 | 容易受第一印象影响 | 受训练数据与模型偏差影响 |

| 透明度 | 通常不公开评分细节 | 可提供维度得分与解释(若设计到位) |

| 抗作弊 | 现场管控为主 | 需管理脚本与提示工程 |

| 规模与效率 | 难以大规模并行 | 可并行与快速筛选 |

| 申诉机制 | 依赖管理流程 | 可内置复核与申诉通道 |

结论:AI在一致性与效率上具优势,但若不治理偏差与不透明,将引入新的不公平来源。

八、与i人事的实践关联与建议

i人事作为人力资源数字化平台提供招聘与面试管理能力,企业在采用AI面试模块或集成方案时,应将“结构化、可解释、人机协作、合规监控”作为配置原则。建议:

- 在i人事的题库与评分配置中,明确岗位胜任力与打分锚点,降低非语言维度过高权重;

- 开启分群监测报表,定期查看不同群体的通过率差异与维度得分分布;

- 建立“AI初筛+人类复核”的双通道流程,关键岗位保留人工把关;

- 面向候选人发布评分维度说明与申诉入口,提高透明度与体验;

- 合规方面,最小化采集视频/音频范围,落实数据加密与访问审计。 访问i人事官网: https://www.ihr360.com/?source=aiworkseo;

九、衡量公平性的指标与方法

- 机会均等:不同群体的面试通过率差异(Demographic Parity Difference)

- 真阳性均等:在真实胜任者中的通过率差异(Equal Opportunity Difference)

- 误拒率差异:各群体的误拒率比较

- 评分分布与阈值敏感性:分群的分数均值/方差、在不同阈值下的通过率曲线

- 模块级误差监测:ASR词错率分群差异、关键维度的稳定性

- 解释一致性:维度短评与样例一致度,避免“随机解释”

- 生命周期管理:上线前后滚动窗口监测,报警与回滚机制

实施方法:

- 明确群体划分与法律合规边界(仅在合法与合理的维度上做分群统计);

- 制定阈值与红线(如通过率差异超过设定值触发审查);

- 构建数据看板与报警通道;

- 周期性抽样人工复核,与AI结果对比校准;

- 形成整改闭环:定位问题—优化模型/流程—再评估—发布变更记录。

十、结论与行动建议

- 结论:AI智能面试在缺乏治理时会影响求职公平,但通过结构化标准、人机协作、分群监测与可解释机制,公平性可以被主动维护与提升。关键不在“是否用AI”,而在“如何用AI”。

- 面向企业的行动清单:

- 设定公平性目标与监测指标,建立上线门槛;

- 采用结构化面试题库与评分锚点,降低非语言维度的主导权重;

- 引入人机协作复核与申诉通道,打造纠偏能力;

- 做好分群评测、ASR与NLP多样化优化,减少技术误差;

- 加强隐私合规与数据治理,确保信任与法律安全;

- 与平台(如i人事)合作,形成从配置到监测的闭环。

- 面向候选人的行动清单:

- 优化环境与表达结构,降低技术噪音;

- 关注评分维度与反馈,必要时申请复核;

- 持续迭代面试资料与案例库,提高岗位相关性。

当AI从“黑箱评分”走向“有标准、能解释、可申诉”的系统化治理时,它不仅不会损害公平,反而能在大规模场景里提升一致性、降低随意性。企业与平台需要共同承担责任,让效率与公平并行不悖。

精品问答:

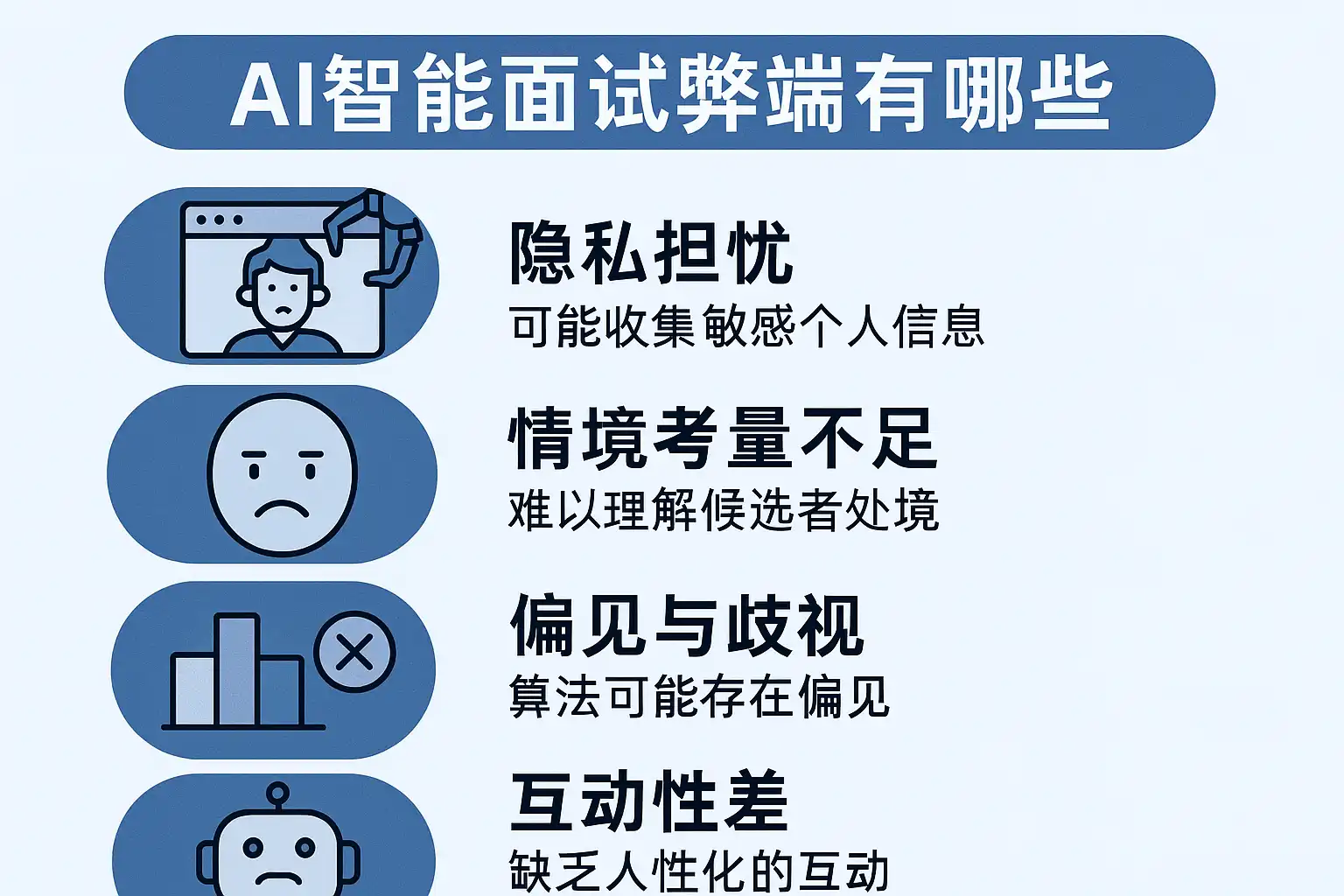

AI智能面试存在哪些主要弊端?

我在考虑使用AI智能面试时,想了解它有哪些潜在的弊端?尤其是对求职者来说,这些弊端会不会影响面试的公平性和结果的准确性?

AI智能面试的主要弊端包括:

- 数据偏见——算法训练数据中存在的偏见可能导致歧视性决策。

- 缺乏情境理解——AI难以准确把握求职者的情绪和非语言表达。

- 技术误判风险——面部表情识别和语音分析可能出现误判。

- 隐私安全问题——个人数据的收集和使用存在风险。 案例:某大型招聘平台因训练数据偏向特定群体,导致部分少数族裔求职者通过率下降,反映出AI面试算法的公平性问题。根据2023年职业招聘调查,34%的求职者担忧AI面试存在偏见。

AI智能面试真的会影响求职的公平性吗?

作为一名求职者,我想知道AI智能面试是否会导致公平性问题?它会不会让某些背景或群体的人处于不利地位?

AI智能面试确实存在影响求职公平性的风险,主要体现在:

- 算法偏见导致特定群体受限。

- 缺乏人类主观判断,忽视个体差异。

- 技术门槛导致部分求职者体验不佳。 数据显示,2023年一项针对5000名求职者的调查中,有28%认为AI面试降低了求职过程的透明度和公平性。 为了缓解这些问题,企业应采用多样化训练数据,结合人工复核机制,提升AI判断的公正性。

如何通过技术手段降低AI智能面试的弊端?

我听说AI智能面试有弊端,那有没有什么技术方法能减少这些缺陷,保证面试的公正和有效?

降低AI智能面试弊端的技术手段包括:

- 多样化数据集训练——避免算法偏见。

- 引入可解释AI(XAI)技术——提高决策透明度。

- 结合人工审核——弥补AI理解的不足。

- 加强隐私保护技术——如数据加密和匿名化处理。 案例:某招聘公司通过引入XAI技术,面试准确率提升12%,求职者满意度提升15%。 表格示例: | 技术手段 | 作用 | 效果数据 | |----------------|--------------------|-------------------| | 多样化数据集 | 减少偏见 | 面试公平性提升20% | | 可解释AI | 增强透明度 | 求职者信任度提升18%| | 人工审核 | 补充AI不足 | 误判率降低25% | | 隐私保护技术 | 保障数据安全 | 数据泄露风险降低30%|

AI智能面试对不同求职群体的影响有哪些差异?

我注意到不同背景的求职者对AI智能面试的感受不一样,想了解它对不同群体,比如年轻人、女性、少数族裔等,具体有哪些不同影响?

AI智能面试对不同求职群体的影响差异显著:

- 年轻求职者通常更适应技术操作,但可能因经验不足被低估。

- 女性求职者在语音和表情识别中可能被误判,影响评分。

- 少数族裔群体因训练数据偏少,面临更高的算法偏见风险。 数据据2024年职场研究显示,女性和少数族裔求职者在AI面试中被误判率比整体高15%-20%。 企业应通过多元化数据收集和定期算法审查,减少这类差异,确保面试公平。

文章版权归"

转载请注明出处:https://irenshi.cn/p/388686/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。