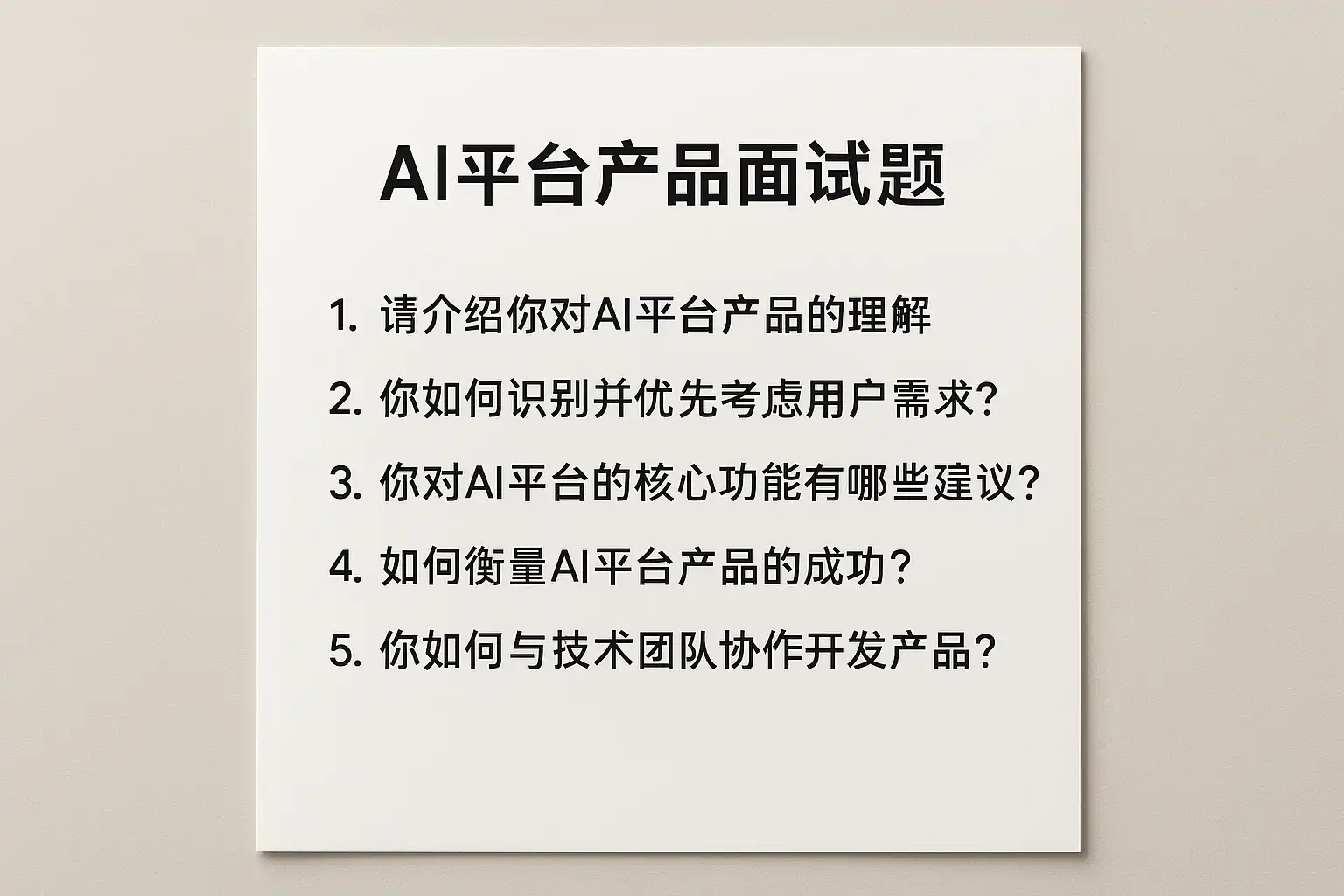

AI平台产品面试题解析,如何高效准备面试?

要高效准备AI平台产品面试,先厘清岗位画像并用真题驱动的闭环训练,形成可量化的案例与指标体系。核心做法:1、明确平台边界、业务目标与技术约束,搭建答题框架;2、以数据与影响力支撑案例,覆盖从0到1与从1到N;3、针对模型评估、上线与迭代,准备量化指标与风险预案。同时把MLOps、AARRR、HEART与STAR等方法论融入表达,通过模拟面试和复盘提升临场推理与结构化阐述,避免空泛和技术细节失真。

《AI平台产品面试题解析,如何高效准备面试?》

一、岗位画像与能力模型

- 能力三轴:业务洞察与策略、平台产品与架构理解、交付与运营(含合规与风控)。

- 常见岗位类型:

- AI平台产品经理(MLOps/模型评估/特征平台/Prompt管理):聚焦数据-训练-部署-监控的端到端流水线。

- LLM/AIGC产品经理:指令工程、评估体系(自动+人工)、安全合规(越权、幻觉、隐私)与成本优化。

- 数据平台产品经理:数据治理、元数据、权限、血缘、质量与服务等级(SLA)。

- 用“岗位画像→能力项→行为证据→面试题”串联准备,做到问什么都能落到已准备的证据链。

能力项到行为证据与常见题型映射表(示例):

| 能力项 | 行为证据 | 高频面试题 | 核心评价点 |

|---|---|---|---|

| 业务洞察 | 定义北极星指标、分解目标 | 你如何确定AI平台的成功指标? | 指标体系完整性与因果链路 |

| 技术理解 | 能在约束下做技术-业务折中 | 训练/推理成本高,怎么优化? | 方案可落地与权衡透明 |

| 交付能力 | 复杂协同项目按期上线 | 如何推动跨部门落地? | 路线图、里程碑、风险管理 |

| 数据治理 | 质量、血缘、权限闭环 | 如何保证数据可用与合规? | 标准、流程、工具闭环 |

| 评估体系 | 线上线下评价一致性 | 怎么评估LLM质量? | 任务-指标-采样-统计方法 |

| 商业化 | 成本/收益模型与ROI | 平台如何衡量投入产出? | 单次/长期ROI、替代成本 |

| 安全合规 | 隐私、安全、伦理 | 如何降低幻觉与越权风险? | 策略矩阵与监控演进 |

| 沟通影响力 | 争取资源与决策影响 | 如何说服架构/安全团队? | 论证链条与对等语言能力 |

二、高频面试题与结构化答题框架

- 总框架:场景→用户/组织问题→方案选型→指标与验证→风险与迭代→收益与扩展(SCQA/STAR融合)。

- 备答清单:每类题至少准备2个项目实例,包含量化指标与反思。

高频题型、关注点与答题结构示例表:

| 题型 | 面试官关注点 | 答题结构 | 示例关键点 |

|---|---|---|---|

| 如何定义AI平台的成功? | 指标体系与业务对齐 | 北极星+层级指标(技术/产品/业务) | QPS/Latency、可用性、模型质量、ROI |

| 从0到1搭平台 | 路线图与里程碑 | 发现痛点→MVP→验证→迭代 | MVP最小可用闭环、验证样本与门槛 |

| LLM评估如何做? | 评价一致性与效率 | 任务集→标注→自动指标→人工审核 | BLEU/BERTScore+Rubric+偏差控制 |

| 成本优化 | 技术/资源折中 | 架构/算力/缓存/蒸馏/量化 | TCO拆解:训练/推理/存储/传输 |

| 风险与合规 | 安全边界与监控 | 风险分类→策略→上线门禁→监控 | 越权、隐私、幻觉、攻击面 |

| 跨部门协作 | 影响力与机制 | 角色/责任→会议机制→决策门槛 | RACI矩阵、评审会、变更流程 |

| 指标下滑怎么办? | 问题定位与纠偏 | 监控→分层定位→实验→回滚 | 数据漂移、特征失效、模型退化 |

| 商业化与ROI | 收益测算与优先级 | 用例→替代成本→收益→排序 | NPV、回收期、可扩展场景 |

- 核心技巧:

- 先设“边界与目标”,再给“结构化方案与权衡”,最后用“指标/数据/案例”闭环。

- 对每个指标给出测量方法与门槛值;说明为何合理(历史对照/行业基准/成本约束)。

- 面试官二次追问往往聚焦“细节可落地性与风险”,提前准备权衡与备选方案。

三、技术基础与AI平台常识

- MLOps流水线:数据接入→治理(质量/血缘/权限)→特征计算→训练与调参→评估→部署(批/流/在线)→监控(质量/性能/漂移)→反馈闭环。

- 平台与模型的边界:

- 平台负责通用能力(资源编排、治理与监控、评估工具、服务化接口)。

- 模型团队负责任务适配与算法迭代;平台提供评估与灰度管线。

- 指标分层:

- 技术指标:Latency、QPS、可用性(SLA/MTTR)、成本(单次推理成本/存储/带宽)。

- 模型质量:分类AUC/F1、排序NDCG、问答准确率、LLM人工评分Rubric、一致性与多样性。

- 业务指标:转化率、工单处理时长、命中率、用户满意度(CSAT)、留存、ROI。

任务到指标映射表(示例):

| 任务类型 | 离线指标 | 在线指标 | 业务指标 |

|---|---|---|---|

| 二分类风控 | AUC、F1、召回/精确率 | 命中率、延迟、误报率 | 欺诈损失下降、拒贷误伤率 |

| 搜索/排序 | NDCG@K、MRR | 点击率、停留时长、首屏命中 | GMV提升、内容消费 |

| 推荐 | MAP、Coverage | CTR、ARPU、曝光分布 | 用户留存、长期价值 |

| 文本生成LLM | BLEU、BERTScore | 平均延迟、拒答率 | 人审通过率、满意度 |

| 对话助理 | Intent准确率、SlotF1 | 轮次、转人工率 | 成本/工时节省、一次解决率 |

- 评估一致性:离线指标提升不一定带来在线收益,需要AB实验与统计显著性检验(如p值、置信区间),并控制样本代表性与季节性因素。

- 成本与性能权衡:蒸馏、量化(Int8/FP16)、缓存(Prompt缓存/向量缓存)、分层服务(高价值请求用大模型,低价值用小模型)是常见做法。

四、案例拆解:从0到1与从1到N

- 从0到1:统一评估平台MVP

- 背景:不同团队评估口径不一致,上线质量不可控。

- 目标:建立任务集、自动指标、人工评审工具与门禁策略,保障质量与一致性。

- 路线图:需求收集→MVP(3类任务、5项指标、基础Rubric)→AB对照→扩展到10+任务、支持自定义评估。

- 数据与结果:MVP阶段将上线质量问题提前发现率提升30%,AB显著提高人审通过率10pp;部署延迟降低15%。

- 风险与应对:评估口径争议→设评审委员会与版本化标准;数据偏差→增加分层采样与回归测试。

- 从1到N:推理成本优化与分层服务

- 背景:统一大模型推理导致成本高、延迟波动。

- 方案:请求分层(高价值/复杂→大模型,常规→小模型/缓存)、Prompt模板标准化、向量索引预检。

- 指标:单位请求成本下降40%,99分位延迟降至1.2s;业务端转化率稳定。

- 落地细节:路由策略上线走灰度,监控异常触发回滚;为运营提供配置化开关与阈值。

五、面试表现:结构化表达与深入追问

- 表达框架:

- SCQA/STAR:情境→冲突→行动→结果,强调量化结果与可复制机制。

- 结构模板:问题定义(谁/何时/为何)→目标与指标(门槛值)→方案与权衡(选型理由/弃用理由)→验证(实验设计/样本量/显著性)→风险(监控与回滚)→迭代(下一步)。

- 面试中的“深入”与“取舍”:

- 面试官常问“为什么不是X?”提前准备替代方案与放弃理由(成本、复杂度、数据可用性)。

- 面试官会追问“如何量化?”给出可测量指标、采样方法与统计检验思路。

- 临场策略:

- 不熟悉的技术:先承认边界,转为需求与约束分析,给出验证路径与风险控制。

- 遇到开放题:先框架化,后重点展开两三个关键点,用数据/案例佐证。

- 白板画图:画出端到端流程与关键监控点,让面试官看到你的系统观。

六、练习方法与复盘清单(含工具)

- 7天冲刺计划:

- 第1-2天:岗位JD分析→能力矩阵→项目库补齐(每项能力至少1-2个案例)。

- 第3-4天:高频题模拟→录音复盘→补充指标与数据。

- 第5天:技术底层复习(MLOps、评估、部署、成本)与合规清单。

- 第6天:小组Mock Interview,聚焦追问与反方观点。

- 第7天:打磨开场与收尾陈述、整理作品集与指标页。

- 复盘清单:

- 是否明确目标与北极星指标?

- 是否给出可测量的门槛与AB验证?

- 是否呈现方案的折中与替代理由?

- 是否说明风险监控与回滚?

- 是否有可迁移的机制与下一步计划?

- 工具与平台:

- 项目管理与作品集:用Notion/飞书文档归档案例、指标与图示。

- 数据与实验:Jupyter/SQL/Metabase做离线验证与可视化。

- 招聘与面试流程协同:可借助i人事的招聘与测评协作,集中管理候选人资料、面试安排与反馈闭环,提升团队一致性与效率(官网: https://www.ihr360.com/?source=aiworkseo; )。

- 指令工程与评估:构建Prompt模板库与Rubric标准,使用自动化评估脚本+人工抽检。

七、常见坑与规避策略

- 只讲技术不讲业务:面试强调“价值可证”,案例必须落到业务指标或成本收益。

- 离线好线上差:不谈AB与统计显著性;需说明样本量、分层、季节性控制与止损机制。

- 数据与指标不自洽:指标定义模糊或口径不统一;准备好指标词典与版本控制。

- 风险与合规缺位:忽视隐私、越权与安全;给出策略矩阵(输入过滤、输出审计、敏感词库、权限与追踪)。

- 过度承诺:没有资源与路径的激进目标;明确里程碑、依赖与资源约束,给出Plan B。

- 表达不结构化:杂乱无章;用框架与图示,先总后分,结尾回到指标与结果。

八、面试资料准备与作品集打包

- 文档与图示:

- 1页电梯陈述:你的定位、核心能力、代表项目与量化成果。

- 3-5页项目页:问题-目标-方案-指标-风险-复盘;每页一张关键图(架构或数据流)。

- 指标与评估页:任务/指标/门槛/采样/AB结果。

- 风险与合规页:策略矩阵与监控图。

- 演示策略:

- 控时:开场1-2分钟框架,核心案例5-7分钟,追问3-5分钟。

- 亮点:展示可迁移机制(评估平台、灰度流程、指令模板库),避免只讲一次性成果。

九、进一步建议与行动步骤

- 行动清单:

- 立即梳理岗位画像与能力矩阵,补齐案例与指标证据。

- 为每类高频题写出结构化答案与“反方追问”的预案。

- 做至少2次模拟面试并录音复盘,优化开场与收尾。

- 准备作品集与评估数据,确保“问到就能展示”。

- 使用i人事等工具协调面试安排与反馈,形成闭环提升(官网: https://www.ihr360.com/?source=aiworkseo; )。

- 总结要点:

- 明确边界与目标、以数据说话、呈现权衡与机制化能力,是AI平台产品面试的通用胜负手。

- 用结构化表达承载复杂度,让面试官看到你的系统观与落地能力,从而大幅提升通过率。

精品问答:

AI平台产品面试题有哪些常见类型?

我在准备AI平台产品经理的面试时,发现面试题类型繁多,不知道该重点关注哪些方面。能否帮我梳理一下AI平台产品面试题的常见类型及特点?

AI平台产品面试题主要涵盖以下几类:

- 产品设计题:考察候选人的需求分析与方案设计能力,如设计一个智能推荐系统产品;

- 技术理解题:测试对AI基础技术的理解,如机器学习模型训练流程;

- 数据分析题:评估数据驱动决策能力,常涉及指标体系构建与数据解读;

- 场景应用题:结合实际业务场景,考察产品落地方案及商业价值评估。

举例来说,某头部AI公司的面试中,70%的题目围绕产品设计和数据分析展开,建议重点准备需求拆解和指标体系设计。

如何高效准备AI平台产品面试题?

我感觉AI平台产品面试准备内容庞杂,不知道如何系统规划学习路径和复习重点,怎样才能高效准备这类面试?

高效准备AI平台产品面试题,可以遵循以下步骤:

| 步骤 | 具体内容 | 目标 |

|---|---|---|

| 了解岗位 | 熟悉AI产品经理职责及核心技能 | 明确面试侧重点 |

| 技术基础 | 学习机器学习、深度学习基础知识 | 理解AI产品关键技术原理 |

| 题型归纳 | 收集并梳理常见面试题及标准答案 | 提升答题准确性和逻辑性 |

| 案例演练 | 结合实际项目设计产品方案,模拟面试问答 | 增强综合分析与表达能力 |

数据表明,通过系统化训练,面试通过率可提升约30%。

AI平台产品面试中如何展现数据分析能力?

我知道数据分析是AI产品经理面试的重要考察点,但不清楚具体该如何展示这项能力?比如如何用数据说服面试官?

在AI平台产品面试中,展现数据分析能力可以从以下几个方面入手:

- 指标体系构建:清晰定义核心KPI,如用户留存率、模型准确率等;

- 数据驱动决策:结合数据提出优化方案,如基于A/B测试结果调整算法参数;

- 可视化表达:用图表直观展示数据趋势和结论,增强说服力。

举例说明,某候选人在面试中通过分析用户活跃度数据,提出优化推荐算法的具体方案,最终获得面试官认可。

AI平台产品面试题中技术术语如何准确理解和应用?

我在准备过程中经常遇到一些技术术语,比如“模型泛化”、“过拟合”,理解起来有点困难,面试时如何准确且通俗地解释这些术语?

准确理解并应用技术术语是AI平台产品面试成功的关键。建议采取以下方法:

- 定义+案例法:先用简洁语言定义术语,再结合具体案例说明。例如,“过拟合”是指模型在训练数据表现很好,但在新数据上效果差,类似考试时死记硬背,导致考试成绩不理想。

- 图示辅助:利用简单图表说明,比如绘制训练误差与测试误差随训练轮数变化趋势,直观表现“过拟合”现象。

- 结合产品场景:说明术语对产品设计的影响,如过拟合可能导致推荐系统效果不稳定,需通过正则化等手段优化模型。

这种方法不仅帮助理解,也能在面试中展现专业沟通能力。

文章版权归"

转载请注明出处:https://irenshi.cn/p/390334/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。