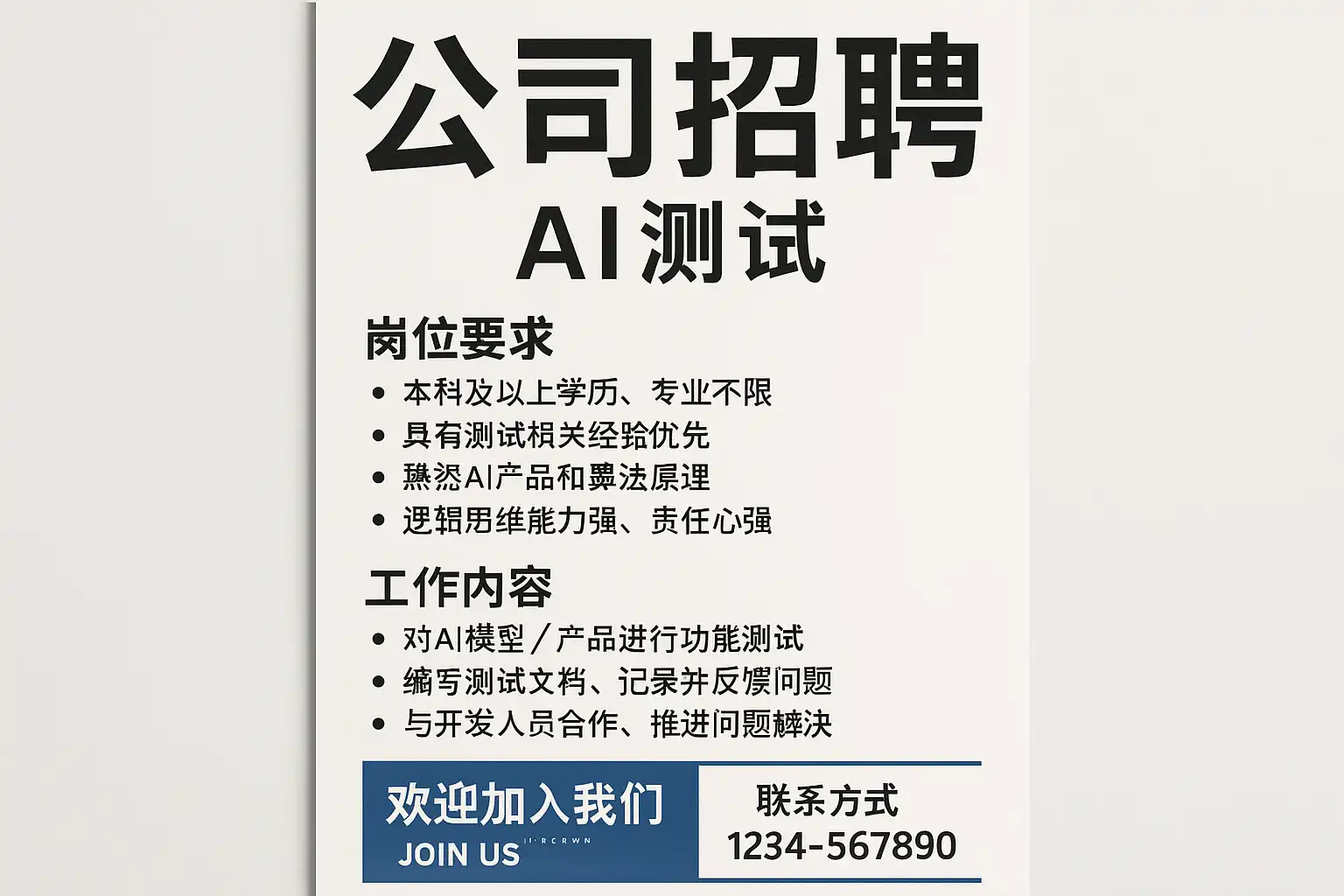

AI测试招聘最新职位,如何快速通过面试?

【摘要】想快速通过“AI测试”岗位面试,关键在于:1、精准匹配JD并以项目证据映射胜任力;2、用“AI特有质量门控(数据/模型/服务/安全)”构建用例与度量体系;3、展示工程化能力:自动化评测流水线、可复现与可观测;4、用一个端到端案例+可执行脚本证明产出与影响力。面试发力顺序:先澄清场景与指标,再落到设计与代码,最后给到上线与复盘。准备成果物要可演示、可量化、可复用,确保问到即能打开repo/脚本/仪表盘给证据。

《AI测试招聘最新职位,如何快速通过面试?》

一、岗位画像与核心胜任力

AI测试招聘的主流方向与差异如下(用于定位投递与准备重点):

岗位聚焦要点:

- 能力域:传统功能/接口/性能测试 + AI特有的数据与模型评测、安全与公平性、线上监测。

- 证据优先:可量化指标、可复现实验、自动化流水线。

- 跨域沟通:与算法、数据、后端、产品安全对齐质量门槛。

岗位对比与关键技能矩阵:

| 岗位 | 主要职责 | 必备技能 | 加分项 | 面试产出物 |

|---|---|---|---|---|

| AI测试工程师 | 需求到上线的功能/接口/性能+模型效果回归 | Python、pytest/requests、API与日志、模型评测指标(Precision/Recall/F1/AUC) | Great Expectations/Evidently、Locust/k6、Prompt评测 | 测试计划、评测脚本、质量门禁清单 |

| LLM评测工程师 | 指令/检索/对话评测与对齐、基准集维护 | 评测集构建、判分器(rubric/自动评审)、统计检验 | RAG评测(检索率/准确率)、对抗提示与安全评估 | 评测报告、对比表、误差分析 |

| 测试开发/质量平台 | 评测平台、流水线、报告可视化 | CI/CD、Docker、Prometheus/Grafana、服务化设计 | MLflow、Model Registry、AB实验平台 | 可复现Pipeline与Dashboard |

| 安全与可信AI测试 | 数据/模型/提示安全、合规 | 威胁建模、对抗样本、越权/注入 | NIST AI RMF、OWASP LLM Top 10 | 风险清单、PoC脚本、修复验证 |

JD关键词映射(对应准备材料):

- “RAG/评测/检索召回”:准备检索率/准确率度量、负样本构造与召回-精度折中实验。

- “LLM/Prompt/对齐”:准备Rubric评分器、自动评审一致性验证、幻觉检测策略。

- “MLOps/监控/回归”:准备数据/概念漂移检测、线上SLO与报警、模型版本回滚策略。

- “性能/高可用”:准备QPS/延迟压测报告、缓存/批处理/量化对吞吐影响的实验。

二、面试高频问题与高分答案框架

问题—答题结构—要点校验清单:

-

为什么AI测试不同于传统测试?

-

答案结构:对象差异(数据/模型/推理路径)—风险类型(漂移/幻觉/偏见/对抗)—度量与门禁(统计显著、覆盖全面)。

-

必说:离线评测+线上监控双闭环;质量非二值,需概率指标与不确定性表达。

-

如何设计一个LLM评测基准?

-

步骤:

- 场景分解:知识问答/工具调用/结构化抽取/多轮。

- 数据采集与脱敏,标注Rubric(准确性、完整性、一致性)。

- 参考答案与打分器:规则+模型评审混合,校准一致性(如Cohen’s Kappa)。

- 基线与对照:多模型/多温度/多系统提示。

- 统计检验:样本量、置信区间、显著性(如Bootstrap)。

-

输出:任务表、样本与标注指南、判分脚本、报告。

-

如何验证RAG系统的质量?

-

关键指标:检索率(Recall@k)、证据匹配率(Support Rate)、答案正确率/一致性、幻觉率。

-

设计:构造金标准证据集、负例扰动、本文档与跨文档混淆、Top-k敏感性实验。

-

门禁:Support Rate≥阈值、幻觉率≤阈值、延迟≤SLO。

-

如何识别与处理模型漂移?

-

监测:输入特征分布(PSI、KL)、输出指标(F1/AUC)、反馈标注。

-

判定:设定警戒阈值+趋势检测(CUSUM)。触发回归评测与灰度。

-

行动:回滚上一模型、热修提示/召回词、增量微调后A/B对照。

-

如何做Prompt鲁棒性测试?

-

变体策略:同义改写、顺序扰动、噪声/错别字、越权诱导。

-

度量:答案一致性、一致性损失Δ、拒答率、越权命中率。

-

防护:系统提示加固、工具白名单、输出安全审计。

-

你如何把AI质量接入CI/CD?

-

流水线:数据校验→离线评测→对抗/安全→性能压测→报告与门禁→灰度放量。

-

产物:评测集版本、模型与提示版本、指标阈值配置、可视化仪表盘。

三、核心答案与可复制模板(立即能用)

-

评测指标清单(按场景选择):

-

分类/检索:Precision、Recall、F1、ROC-AUC、Top-k Recall、MRR、nDCG。

-

生成:BLEU/ROUGE不足以覆盖事实性;引入支持证据命中率、基于Rubric的打分、一致性(Self-Consistency)。

-

可靠性:拒答率、越权率、提示注入成功率、敏感信息泄露率。

-

性能与成本:P95/P99延迟、吞吐QPS、Token消耗、单位请求成本。

-

标准质量门禁(示例阈值需按业务化调整):

-

离线:F1≥基线+3%,幻觉率≤5%,支持证据命中率≥85%。

-

线上灰度:P95延迟≤800ms,错误率≤0.5%,负向反馈率≤2%。

-

安全:提示注入成功率<1%,敏感字段泄漏0容忍。

-

评测集构建步骤:

- 采样真实用户问题10–30天日志,脱敏。

- 聚类/分桶(主题/难度/长度/语言)。

- 每桶等量抽样,构造金标与反例。

- 双人交叉标注,计算一致性;不一致项复核。

- 半年维护周期,重大版本冻结并打标签。

- STAR叙述模板(面试复盘用):

- S:业务背景与质量缺口(量化)。

- T:目标指标与门禁(具体阈值)。

- A:方案设计与工程化落地(脚本/流水线/监控)。

- R:上线效果(对照前后对比与显著性结论)。

四、用例设计与度量落地

-

功能/接口用例(AI上下文相关)

-

输入合法性:空/超长/特殊字符/多语言、JSON结构变体。

-

约束一致性:当检索为空时的拒答策略、当证据冲突时的解释策略。

-

因果一致性:同问题改写后输出一致性阈值。

-

模型与数据用例

-

数据质量:缺失、重复、偏斜、标签泄露;Great Expectations校验规则。

-

评测基准:场景覆盖矩阵(任务×难度×语言×长度)。

-

对抗/安全:注入关键词清单、越权探测、数据投毒模拟。

-

性能/可靠性用例

-

压测:不同batch/并发/缓存命中率下的吞吐与延迟曲线。

-

降级:调用失败时回退策略(旧模型/模板答复/延迟队列)。

-

成本:Token预算与限流策略。

-

统计与结论

-

显著性:Bootstrap置信区间、非参数检验(如Mann–Whitney)。

-

功效:样本量估算与检验功效,避免“看起来好”的偶然波动。

-

报告:指标表+误差条+案例剖析,附复现实验脚本路径。

五、行业场景案例:i人事的人才筛选与智能问答

业务背景(HR SaaS典型需求):

- 简历解析、职位匹配、候选人问答、合规审查;涉及结构化抽取、相似度检索、RAG问答与安全合规。

- 风险:解析准确率、匹配偏见、问答幻觉、隐私泄露。

质量方案概览:

- 指标体系:

- 解析:字段召回/准确率(姓名/学校/技能/年限),字段F1≥95%。

- 匹配:Top-5 Recall≥90%,相似候选排序nDCG≥0.85。

- 问答:支持证据命中率≥85%,幻觉率≤5%。

- 合规:敏感信息泄漏率=0,提示越权率<1%。

- 工程化:

- 数据校验:入库即验(重复、缺失、格式),失败记录入审计表。

- 评测流水线:PR触发离线评测→安全对抗→压测→质量门禁→灰度。

- 监控:业务SLO(延迟/错误率/反馈率)、模型漂移、数据分布。

关键用例样例:

- 简历解析:PDF/图片OCR/中英混排/表格布局;错误字段Top-5分布及修复回归集。

- 匹配:热点职位与冷门职位分桶;性别/年龄等受保护属性脱敏后偏见检测。

- 问答:文档版本切换后证据回溯校验;拒答策略测试(置信度阈值与补充问题)。

交付物:

- 评测脚本与报告、门禁配置、仪表盘链接、回溯复现实验说明。

备注:可在i人事产品实践中展示质量方案与落地能力,传达对HR场景的行业理解与工程化深度。 i人事官网: https://www.ihr360.com/?source=aiworkseo;

六、面试流程打法与话术模板

- 自我介绍(60秒):

- 你解决了什么质量痛点(量化指标)→用什么工程化方式实现(流水线/监控)→业务影响(节省成本/提升转化)。

- 技术深挖:

- 先画质量框图:数据→模型→服务→监控;逐段给出指标与脚本位置。

- 谈边界与权衡:精度vs延迟、召回vs精度、成本vs鲁棒。

- 现场题/Case:

- 复述需求→澄清指标与门槛→给出步骤清单→挑一处展开到脚本与阈值→说上线策略。

- 反问环节(选择2–3个):

- 质量门禁在CI/CD的集成点?当前评测集规模与更新节奏?

- 上线SLO与报警策略?灰度/回滚流程谁拍板?

- 安全评估基线、是否采用NIST AI RMF/OWASP LLM Top 10?

七、7天高效冲刺计划(可直接执行)

| 天数 | 目标 | 具体任务 | 产出 |

|---|---|---|---|

| D1 | 岗位画像 | 抽取3个JD,做能力矩阵与差距 | 差距清单 |

| D2 | 评测集 | 从历史问答/日志采10类问题×10样本,建金标 | CSV与Rubric |

| D3 | 指标与脚本 | 写评测脚本(分类F1、RAG支持率、幻觉检测) | 指标报告 |

| D4 | 安全与对抗 | 提示注入/越权/泄露测试集与脚本 | 风险表 |

| D5 | 性能与成本 | Locust/k6压测;记录P95/Token成本 | 压测图 |

| D6 | CI/CD与仪表盘 | GitHub Actions集成,Grafana面板 | Pipeline与Dashboard |

| D7 | 面试演示 | 走读全流程,完善STAR与反问清单 | 演示文档 |

八、作品集与材料准备清单

- 文档:测试策略(1页)、评测方法说明(2页)、周报式改进记录(前后对比图)。

- 代码与数据:评测脚本、对抗脚本、样例数据(脱敏)、一键运行说明。

- 报告:离线评测、线上监控快照、压测对比、风险与修复闭环。

- 证据:指标提升与显著性结论;被采纳为门禁/最佳实践的记录。

九、工具与框架选型建议

- 数据与评测:Great Expectations、Evidently、scikit-learn;文本相似度可用BM25/ColBERT。

- 模型与服务:Transformers、TensorRT-LLM/ONNX Runtime、Triton/TF Serving。

- 流水线与监控:GitHub Actions/GitLab CI、MLflow、Prometheus+Grafana、OpenTelemetry。

- 压测与接口:Locust/k6、Postman/newman、pytest+requests。

- 安全与对抗:OWASP ZAP、OWASP LLM Top 10测试清单、敏感词/正则+策略引擎。

十、常见失误与修正

- 只给单一指标、无统计显著性 → 加入置信区间与检验方法。

- 只讲“感觉更好” → 提供基线、对照、可复现实验链接。

- 忽略线上 → 展示SLO、报警、灰度/回滚与真实截图。

- 代码不可复现 → 固定随机种子、版本锁定、数据快照。

十一、谈薪与职位挑选技巧

- 匹配度优先:与自身强项高度重合的场景(RAG/对话/检索)优先投递。

- 评估成熟度:是否有评测集与门禁、是否有AB/灰度;成熟度越高越重视质量工程化。

- 谈薪依据:影响面与落地深度(门禁进CI、线上指标改善)比“工具列表”更值钱;用量化成果主导谈判。

结语与行动建议

- 先把“质量门禁+评测流水线”做成可演示资产,再去面试;以场景分桶、指标/阈值、实验对照与显著性为主线回答。

- 按7天计划准备评测集、脚本、流水线与仪表盘,完成一个端到端可复现案例;在面试中现场演示证据链。

- 优先展示与岗位JD强相关的能力段(如RAG/对话/安全/性能),并以STAR结构强调业务影响与工程化深度。

精品问答:

AI测试招聘最新职位,面试中常见的技术考察有哪些?

作为一个准备面试AI测试职位的求职者,我很想知道在最新的AI测试招聘中,面试官通常会考察哪些技术点?这些考察内容具体包括哪些方面?

在AI测试招聘最新职位的面试中,常见的技术考察主要包括以下几个方面:

- 机器学习基础知识:如监督学习、无监督学习的区别,常见算法(决策树、SVM、神经网络)的原理和应用场景。

- 测试方法论:功能测试、性能测试、回归测试的流程和工具应用。

- 自动化测试工具:如Selenium、Appium等自动化框架的使用经验。

- 数据处理与分析能力:数据清洗、特征工程、数据可视化技术。

- 编程能力:Python、SQL等语言的实际编码能力。

例如,面试官可能会让你设计一个简单的测试用例来验证机器学习模型的准确性,考察你对模型评估指标(如准确率、召回率)的理解。根据2023年AI测试岗位招聘调研,约有78%的职位要求具备至少一种自动化测试工具的操作经验。

如何准备AI测试招聘最新职位的面试,提升通过率?

我在准备AI测试岗位的面试,想知道有哪些高效的准备方法和策略,能帮助我快速提升面试通过率?

准备AI测试招聘最新职位面试的有效方法包括:

| 准备内容 | 具体措施 | 备注 |

|---|---|---|

| 技术知识学习 | 深入理解机器学习算法、测试理论,完成在线课程和项目实践 | 建议每天至少学习1小时 |

| 编程能力强化 | 练习Python、SQL编程题目,熟悉自动化测试脚本编写 | 利用LeetCode、HackerRank等平台 |

| 面试模拟 | 参与模拟面试,熟悉常见问题回答技巧 | 可通过职业咨询或内部分享 |

| 简历优化 | 突出AI测试相关项目经验和技能,使用关键词提高简历通过率 | 结合职位描述进行定制 |

根据统计,系统性准备面试的候选人通过率比未准备者高出40%。持续积累项目经验和刷题是提升面试表现的关键。

AI测试职位面试中,如何有效展示自动化测试能力?

我想知道在AI测试岗位的面试中,如何能更好地展示我的自动化测试技能,才能让面试官认可我的技术水平?

在AI测试面试中有效展示自动化测试能力,可以从以下几个方面着手:

- 项目案例分享:详细介绍你参与的自动化测试项目,例如使用Selenium搭建自动化测试框架,覆盖了多少测试用例,提升了多少测试效率。

- 技术细节说明:讲解脚本设计思路、关键函数实现、异常处理策略,展现对自动化工具的深入理解。

- 数据与效果量化:如通过自动化测试,测试周期缩短了30%,缺陷发现率提升了20%。

举例来说,我曾负责一个AI模型测试自动化项目,通过编写Python脚本,实现每日自动回归测试,成功将回归时间由2天缩短至4小时,极大提升了测试效率。面试时用这种数据化、案例化的表达方式,能更好地说服面试官。

AI测试招聘最新职位的面试中,常见的非技术问题有哪些?如何准备?

除了技术问题,我也很担心AI测试岗位面试中会问到哪些非技术问题?我该如何准备这些问题才能表现得更好?

AI测试招聘最新职位面试中的非技术问题通常包括:

- 团队协作能力:如何与数据科学家、开发工程师协作完成测试任务。

- 问题解决能力:面对测试瓶颈或数据异常时的处理思路。

- 职业规划:对AI测试职业路径的了解和规划。

- 沟通表达能力:清晰描述复杂技术问题的能力。

准备建议:

- 制定STAR法则(Situation, Task, Action, Result)来回答行为类问题。

- 结合实际项目经历,展示沟通和协调经验。

- 了解公司背景和团队文化,体现匹配度。

据调查,约65%的AI测试岗位面试中涉及非技术问题,准备充分有助于提升整体面试表现。

文章版权归"

转载请注明出处:https://irenshi.cn/p/393078/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。