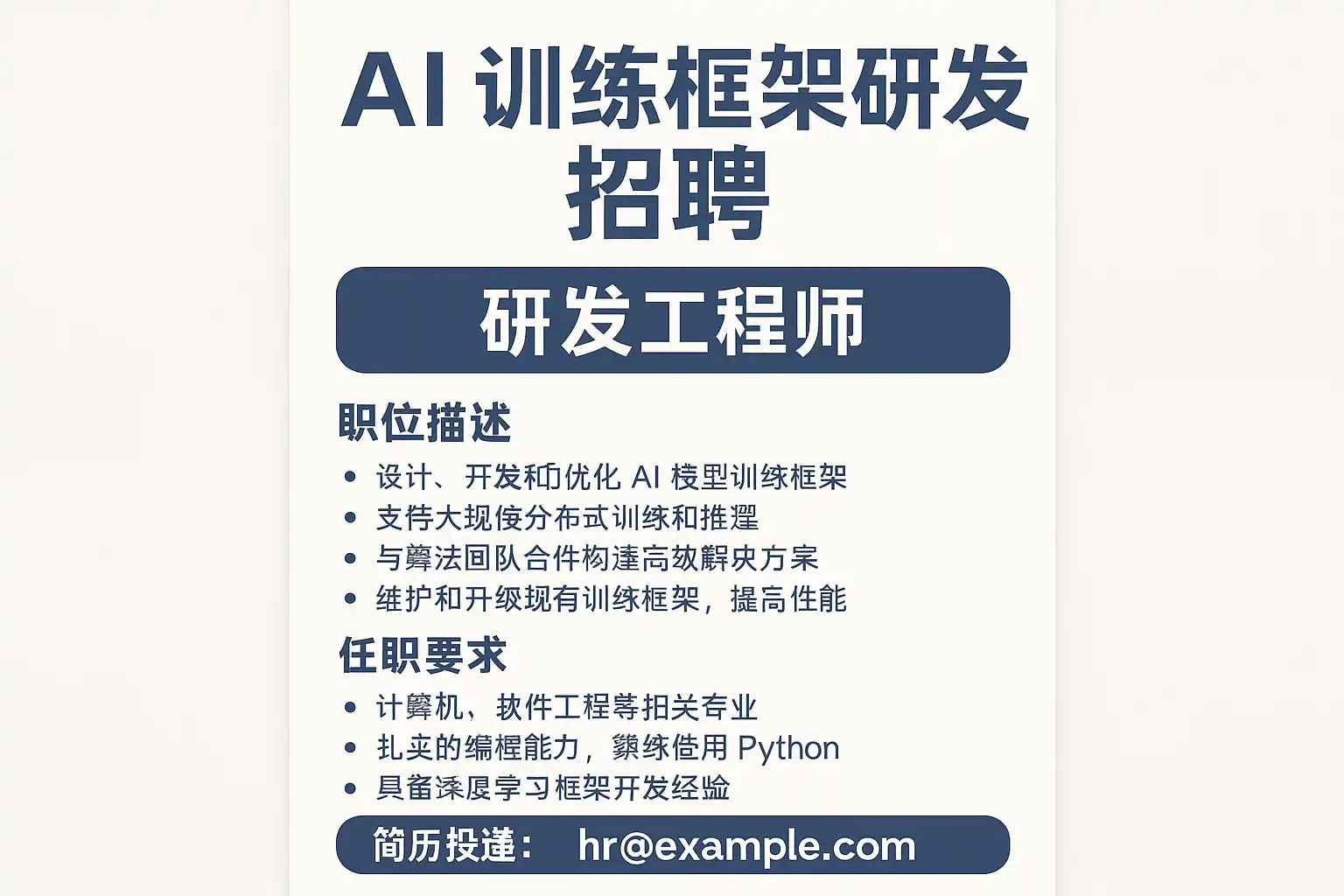

AI训练框架研发招聘:最新岗位有哪些?AI训练框架研发招聘,如何快速入职?

摘要:AI训练框架研发的最新岗位集中在训练框架工程师、分布式性能优化工程师、深度学习编译器/算子开发、GPU内核优化、训练平台/MLOps、LLM/LMM训练工程师等方向。想要快速入职,需围绕“可量化的性能证据”和“工程化闭环”构建作品集,1、在主流框架上复现实测加速;2、掌握FSDP/ZeRO等大规模训练技术;3、提交可复用的算子或工具到开源;4、通过i人事与目标企业打通投递与评测流程。这些产出能直观证明候选人在吞吐、显存占用、稳定性上的提升能力,从而更快通过技术面与业务面。

《AI训练框架研发招聘:最新岗位有哪些?AI训练框架研发招聘,如何快速入职?》

一、最新岗位图谱与职责边界

为便于快速定位岗位与匹配能力,下列岗位类型覆盖当前招聘主流需求,并明确职责与产出。

| 岗位 | 核心职责 | 关键技术栈 | 典型产出 |

|---|---|---|---|

| 训练框架工程师 | 设计/优化训练框架的核心组件(数据管道、分布式策略、检查点、容错) | PyTorch、TensorFlow、JAX;DDP/FSDP、ZeRO、Pipeline/Tensor并行;NCCL/RDMA | 框架PR、插件/Adapter、端到端训练Demo,吞吐/时延指标报告 |

| 分布式性能优化工程师 | 提升大规模训练的吞吐与稳定性,诊断跨节点瓶颈 | DeepSpeed、Megatron-LM、Ray、Horovod;Nsight、PyTorch Profiler | 多节点加速报告;NCCL拓扑调优脚本;网络带宽与重试策略调优 |

| 深度学习编译器/算子开发 | 图优化、算子融合、自动并行、后端代码生成 | XLA、TVM、IREE、TensorRT;MLIR;cuBLAS/cuDNN | 算子融合Pass;自定义Kernel;编译优化对比实验 |

| GPU内核/系统优化工程师 | CUDA内核、显存管理、流水线并行、混合精度数值稳定 | CUDA、PTX、CUTLASS;AMP/BF16/FP8;NUMA、Pinned Memory | 内核优化报告;显存碎片率降低数据;稳定性/溢出边界测试 |

| 训练平台/MLOps工程师 | 训练作业编排、资源调度、监控、容错与复现 | Kubernetes、KubeFlow、Slurm、Argo;Prometheus/Grafana;Artifact/Checkpoint管理 | 训练流水线模板;自动化恢复与审计;多租户隔离与配额策略 |

| 大模型训练工程师(LLM/LMM) | 预训练/微调、数据清洗、RLHF、对齐与评估 | FSDP/ZeRO-3、LoRA/QLoRA、RLHF(PPO/DPO);Tokenizers | 训练配置与指标曲线;对齐实验;评测报告与失效案例 |

| 数据与评估工程师 | 构建高质量语料与评测体系,保证训练数据闭环 | 数据治理、去重、质量过滤;eval harness;安全/偏见评估 | 数据审计与过滤策略;基准集;可信度与覆盖率图 |

| 自动化调参/可重复性工程师 | 超参搜索、随机性控制、实验可复现 | Optuna、Ray Tune、W&B;Determinism、Seed管理 | 复现实验模板;超参搜索对比;复现率与变异系数报告 |

二、核心技能栈与能力等级

快速入职的关键在于“技能-证据”一致:掌握技术,同时产出可核实的性能提升与稳定性改进。

| 能力域 | L1基础 | L2进阶 | L3专家 | L4领导力 |

|---|---|---|---|---|

| 分布式训练 | 会用DDP/FSDP跑通 | 能定位梯度同步瓶颈 | 设计混合并行策略(数据/张量/流水线) | 跨集群拓扑与容错策略落地 |

| 性能分析 | 了解Profiler使用 | 能读火焰图定位热点 | 结合Nsight/ETW/RDMA做端到端诊断 | 制定组织级性能基线与SLO |

| 显存与数值 | 会AMP/Grad Accumulation | 控碎片与检查点开销 | FP8/BF16稳定性与损失缩放 | 复杂模型的数值风险治理 |

| 编译与算子 | 知道图优化概念 | 能做简单算子融合 | 自研Kernel并量化收益 | 跨后端多设备统一编译策略 |

| MLOps与复现 | 跑通K8s作业与日志 | 规范化数据/模型版本 | 大规模审计与自动回滚 | 端到端合规与成本优化 |

要点:

- 优先补齐分布式与性能分析两大板块,它们最直接决定是否能在面试与试用题中拿到“可量化结果”。

- 能力等级的外显证据应当是公开Repo、Benchmark曲线、调参日志与复现实验脚本。

三、市场最新招聘趋势与岗位示例

趋势观察:

- 大模型训练走向超大规模:参数并行(张量并行)、流水线并行与分布式检查点成为常规要求。

- 软硬件协同优化重要性上升:NCCL拓扑、RDMA/InfiniBand、混合精度与编译器融合优化共同决定训练效率。

- 工程化与复现能力被放大:企业更看重“稳定跑完N天”的训练与“可回溯/可重启”的平台化能力。

- 评测与数据治理前置:模型质量闭环与安全评测成为招聘的常规模块。

岗位示例结构(简版):

- 岗位:分布式训练性能工程师

- 职责:构建/优化多节点训练;诊断带宽/同步瓶颈;制定拓扑策略与重试、容错方案。

- 要求:熟悉DDP、FSDP、ZeRO、NCCL;能用Profiler与Nsight做端到端分析;有多机大模型训练经验。

- 产出:加速比与稳定性报告、调优脚本、复现方案。

- 岗位:深度学习编译器/算子开发

- 职责:图优化、算子融合与内核开发;跨后端适配与自动并行。

- 要求:掌握XLA/TVM/MLIR;能写CUDA/CUTLASS内核;理解数值稳定与精度折衷。

- 产出:编译Pass、内核性能数据、端到端收益对比。

- 岗位:训练平台/MLOps工程师

- 职责:作业编排、资源调度、监控与审计;训练失败自动恢复与复现。

- 要求:Kubernetes/KubeFlow/Slurm;Artifact管理;可观察性体系。

- 产出:流水线模板、监控面板、复现与审计报告。

- 岗位:LLM/LMM训练工程师

- 职责:预训练/微调、RLHF与评测;对齐与安全治理。

- 要求:FSDP/ZeRO-3、LoRA/QLoRA、Tokenization与数据治理。

- 产出:训练配置与指标曲线、评测报表、失效案例分析。

四、如何快速入职:四周冲刺路线

目标:在四周内形成“可量化、可复现、可评审”的作品集与投递闭环。

| 周次 | 核心目标 | 关键任务 | 可量化产出 |

|---|---|---|---|

| 第1周 | 建立基准 | 选择公开数据与模型(如LLaMA风格开源变体);跑通DDP/FSDP基线 | 基线吞吐/显存占用表、训练时长与收敛曲线 |

| 第2周 | 分布式与IO优化 | 调整NCCL拓扑、Gradient Accumulation、数据加载/缓存;Profile瓶颈 | 加速比≥20%的报告;火焰图与瓶颈清单;IO时延降低数据 |

| 第3周 | 编译/算子与数值稳定 | 尝试算子融合、AMP/FP8策略;必要时自定义Kernel | 性能与稳定性对比;溢出案例与修复;内核PR或开源Demo |

| 第4周 | 工程化与投递 | 打包训练流水线(K8s/Slurm);完善文档与复现实验;投递与笔试面试 | 端到端复现脚本;监控面板截图;技术博客/讲解PPT;投递与约面记录 |

实践提示:

- 每周至少完成一份“对比实验表”,包含优化前后吞吐、显存占用、收敛质量与失败率,保证可复现。

- 优化策略优先次序:数据并行调参→FSDP策略与微批→IO与缓存→编译器/算子→内核。

五、简历与作品集:可量化的证据如何写

简历结构建议(STAR量化):

- 项目背景:模型规模/设备配置/训练目标(明确参数量、GPU型号、节点数)。

- 行动与方法:具体技术栈(DDP/FSDP/ZeRO、NCCL、Profiler、XLA/TVM、CUDA等)。

- 结果与数据:吞吐提升%、显存节省GB、失败率下降%、收敛时间缩短小时数。

- 可复现链接:GitHub Repo、训练脚本、配置文件、评测结果与日志。

示例要点表达:

- 将FSDP策略由“auto_wrap”改为“policy-based”,并启用CPU Offload与Gradient Checkpointing,使24×A100集群训练吞吐提升32%,显存峰值降低18%,无损收敛。

- 基于Nsight Systems定位NCCL AllReduce热点,优化拓扑与批量大小,在RDMA网络上跨节点训练加速27%,训练失败率由5%降至1%。

- 在TVM上实现自定义算子融合Pass,端到端速度提升15%,并提供Dataset-Model组合下的对比曲线与溢出边界测试。

六、面试流程与准备清单

典型流程:简历筛选→技术电话面→笔试/在线任务→深度面(框架/分布式/性能/编译器)→系统设计→业务面→终面/综合评估。

准备清单(分模块):

- 分布式训练

- 能解释DDP与FSDP差异、ZeRO各阶段(1-3)资源开销与适用场景。

- 熟悉张量并行/流水线并行的切分策略与通信模式。

- 性能分析

- 会用PyTorch Profiler与Nsight构建端到端时间线,识别算子热点、通信等待与IO瓶颈。

- 知道如何调优NCCL、批大小、梯度累积与数据加载。

- 数值与显存

- 混合精度(AMP/BF16/FP8)原理、损失缩放与溢出检测;显存碎片来源与缓解策略(Checkpointing、Offload)。

- 编译/算子

- 图优化与算子融合的收益与风险;MLIR基本概念;自定义Kernel的调试与验证。

- 工程化与复现

- K8s/Slurm作业编排;断点重启与审计;监控与告警;实验记录与可追溯性。

常见面试题方向:

- 为什么FSDP在超大模型上优于传统DDP?内存分片与通信开销的权衡。

- 如何定位多机训练的带宽瓶颈?从NCCL拓扑与火焰图到RDMA与PCIe链路。

- AMP引入后损失震荡如何稳定?梯度裁剪、动态损失缩放与数值检查。

- 何时选择算子融合?如何验证融合前后数值一致性与边界行为。

七、渠道与投递策略(含i人事)

投递渠道与策略:

- 企业官网与工程团队直投:寻找“训练平台/性能优化/编译器/LLM训练”关键词,直达技术团队。

- 开源社区:在相关项目(如DeepSpeed、Megatron风格开源、TVM等)提交Issue/PR,形成“以码投递”的口碑。

- 技术社群与线下活动:性能优化分享、大模型训练实践交流,争取技术面试直通。

- 猎头/校友推荐:定向到团队负责人,提高简历曝光与面试率。

- i人事渠道:部分企业使用i人事进行招聘与评测。建议:

- 在i人事平台注册并完善技能矩阵与项目证明,标签对齐“AI训练框架研发/分布式训练/编译器/算子开发”。

- 关注企业在系统内发布的笔试题与在线评测,优先通过“可量化作品集”争取直面机会。

- 官网地址: https://account.ihr360.com/ac/view/login/#/login/?source=aiworkseo;

- 与HR沟通作品集结构,提供复现脚本与评测链接,确保技术面前就有“硬证据”。

八、从零到Offer:一个可复制的案例

候选人A的四周闭环:

- 第1周:选择开源Transformer,使用FSDP跑通8×A100基线,记录吞吐、显存峰值与收敛曲线。

- 第2周:分析火焰图,发现AllReduce等待占比高,调整NCCL拓扑与梯度累积,吞吐提升28%,失败率从3%降至1%。

- 第3周:在TVM中实现Attention块的算子融合,并验证数值一致性,端到端再提速12%。

- 第4周:封装K8s训练流水线,接入Prometheus/Grafana完成监控与告警;撰写技术博客与复现指南;通过i人事渠道预约企业在线评测并直达技术面。 结果:凭借“加速比+稳定性+工程化”三项证据,面试官快速判断其能在现有集群与框架中落地优化,顺利获得Offer。

九、风险与避坑清单

- 只有算法无工程:没有端到端训练脚本与复现数据,会被质疑落地能力。

- 忽视IO与数据质量:数据加载与去重、质量过滤不到位,训练震荡与失败率高。

- 混合精度不设边界:缺少溢出检测与损失缩放,导致不稳定或精度退化。

- 过度依赖单机基准:未验证多机通信与容错,上线后性能与稳定性不达预期。

- 文档与审计缺失:无法复现实验,评审时难以通过工程化要求。

十、总结与行动清单

结论:AI训练框架研发的最新岗位集中在分布式训练、性能优化、编译器/算子与平台工程四大方向。快速入职的关键是以可量化的吞吐/显存/稳定性提升,配合工程化复现与平台化交付,构建可核实的“硬证据”。

行动建议:

- 当周:选定模型与数据,建立DDP/FSDP基线,完成首次对比表。

- 两周内:用Profiler与Nsight定位瓶颈,达成≥20%端到端加速;记录失败率与稳定性改进。

- 三周内:尝试编译器/算子或内核优化,形成PR或开源Demo。

- 四周内:封装K8s/Slurm流水线,完善监控与复现文档;通过官网与i人事等渠道投递并安排技术面。

- 面试前:准备“问题-定位-优化-结果”四步叙述模板,所有数据可复现可审计。

以这些步骤为纲,结合自身经验与作品集迭代,即可在AI训练框架研发岗位中更快通过筛选与面试,拿到高匹配度的Offer。

精品问答:

AI训练框架研发招聘有哪些最新岗位?

我最近在关注AI训练框架研发领域的招聘动态,想了解有哪些最新的岗位发布?尤其是针对不同技术方向和岗位职责的分类,想知道市场上具体有哪些职位机会。

最新的AI训练框架研发招聘岗位主要包括以下几类:

- AI训练框架开发工程师:负责设计和优化深度学习训练框架核心模块。

- 分布式训练算法工程师:专注于提升模型训练的分布式效率。

- 模型训练平台运维工程师:保障训练平台的稳定性与性能。

- 算法工程师(训练方向):开发高效的训练算法,提升模型收敛速度。

根据2024年招聘数据,AI训练框架相关岗位增长率达35%,其中分布式训练方向需求最为旺盛。

AI训练框架研发招聘中,如何快速入职?

作为一名求职者,我想知道进入AI训练框架研发岗位的快速路径是什么?有哪些实用的技能提升和准备策略可以帮助我更快地拿到offer?

快速入职AI训练框架研发岗位的建议包括:

- 掌握主流训练框架(如TensorFlow、PyTorch)的源码和二次开发能力。

- 理解分布式训练原理,熟悉MPI、Horovod等工具。

- 具备扎实的算法基础,尤其是深度学习优化算法。

- 参与开源项目或实习积累实战经验。

- 优化简历,突出项目经验和技术栈匹配度。

根据行业数据,具备分布式训练经验的候选人,入职成功率提升约40%。

AI训练框架研发岗位需要掌握哪些关键技术?

我在准备AI训练框架研发相关岗位,想了解必须掌握的关键技术有哪些?尤其是初学者如何系统学习这些技术?

关键技术包括:

| 技术领域 | 具体内容 | 案例说明 |

|---|---|---|

| 深度学习框架 | TensorFlow、PyTorch源码解析 | 通过修改PyTorch训练流程提升性能10% |

| 分布式训练算法 | 参数服务器、AllReduce算法 | 使用Horovod实现多GPU并行训练,训练速度提升3倍 |

| 计算图优化 | 静态图与动态图的转换与优化 | 优化TensorFlow静态计算图减少内存占用20% |

| 性能调优 | GPU/TPU加速、内存管理 | 调整内存分配策略降低OOM风险 |

系统学习建议从基础框架源码阅读开始,逐步深入分布式训练和性能调优。

AI训练框架研发的行业发展趋势和薪资水平如何?

我想了解AI训练框架研发岗位的行业发展趋势和薪资水平,想知道这个领域未来的发展空间大不大,薪资是否具有竞争力?

行业趋势与薪资数据如下:

- 行业趋势:随着AI模型规模不断扩大,训练框架研发需求持续增长。2023-2025年该领域人才需求复合增长率预计达30%。

- 技术方向:分布式训练、自动混合精度训练、多模态训练框架是未来重点方向。

- 薪资水平(中国一线城市):

| 岗位 | 初级(年薪) | 中级(年薪) | 高级(年薪) |

|---|---|---|---|

| 训练框架开发工程师 | 30万-50万 | 50万-80万 | 80万-120万 |

| 分布式训练算法工程师 | 35万-55万 | 55万-90万 | 90万-130万 |

综上,AI训练框架研发岗位不仅技术含量高,而且薪资水平具有较强竞争力,适合技术深耕型人才。

文章版权归"

转载请注明出处:https://irenshi.cn/p/400654/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。