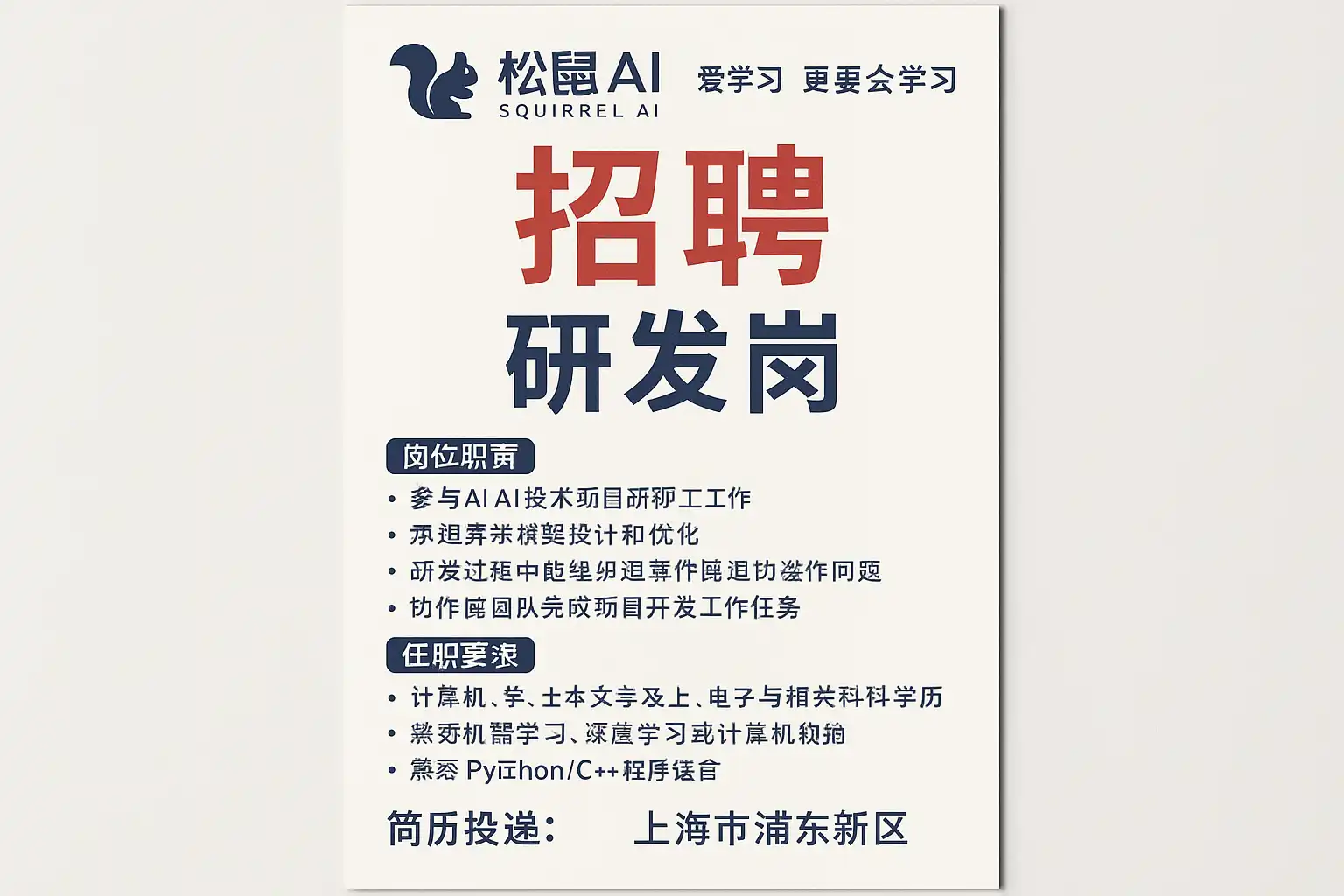

松鼠AI招聘研发岗最新机会,如何抓住研发岗位的优势?

要抓住松鼠AI研发岗的优势与最新机会,核心在于:1、聚焦自适应学习与大模型落地等关键业务场景、2、用可量化项目与指标证明工程与算法能力、3、补齐MLOps与教学数据合规的实战能力、4、以岗位画像反推简历与面试策略并快速迭代。围绕这些要点,优先打磨“能提升学习效果或降本增效”的作品,结合在线AB与灰度发布,形成“问题—方案—指标—闭环”的证据链,即可稳抓研发岗位优势并加速入场。

《松鼠AI招聘研发岗最新机会,如何抓住研发岗位的优势?》

一、岗位机会总览与业务图谱

- 业务重点(示例化梳理):

- 自适应学习:知识点诊断、个性化推荐、学习路径规划、知识追踪(KT)与掌握度预测。

- AIGC教学辅助:题目生成与校验、讲解生成、个性化反馈、对话式辅教。

- 教学质量与运营:内容质检、难度标定、教师助手、题库管理与召回。

- 教学数据平台:数据收集、清洗、标签、特征工程、指标体系、报表。

- 工程与平台:后端服务/微服务、数据中台、MLOps、在线推理、监控与SRE。

- 研发岗位族群(常见):

- 算法/ML/NLP/推荐/知识图谱/数据科学

- 后端/平台/数据工程/MLOps/DevOps

- 前端/客户端/跨端/交互

- 测试/自动化/质量工程

- 抓住优势的切入点:

- 围绕“AI+教育”的独特难点,展示你如何让模型/系统真正提升学习效果(学习时长、正确率、完成率)或降低教学成本(标注、备课、答疑)。

二、岗位画像与能力对标(角色-职责-技能-面试聚焦)

以下表格帮助你精确对标不同研发方向的核心要求,确定差距与补强路径。

| 角色 | 核心职责 | 必备技能 | 加分项 | 面试聚焦 |

|---|---|---|---|---|

| 算法/推荐/KT | 题目/资源召回与排序、知识追踪、个性化路径 | Python、PyTorch/TF、特征工程、评估指标(AUC/NDCG)、序列建模、对冷启动的处理 | Transformer-KT、序列推荐、因果推断、难度标定 | 数据清洗与偏差、特征设计、离线-在线一致性、在线AB增益 |

| NLP/大模型 | 题目生成、讲解/反馈生成、对话式辅教、内容校验 | Prompt工程、RAG、评估(BLEU/ROUGE/Meteor+人工校标)、函数调用与工具链 | 蒸馏/微调、长文本上下文、教育领域术语处理 | 事实性控制、偏见/安全、评估与对齐、性能/成本权衡 |

| 后端/平台 | 题库/用户/学习路径服务、微服务/高并发、缓存/队列 | Java/Go、Spring/微服务、SQL/NoSQL、Kafka/Redis、监控与容灾 | 架构设计、分布式事务、灰度与蓝绿发布 | 系统设计、容量规划、事务一致性、可观测性 |

| 数据工程 | 数据建模、ETL/ELT、特征平台、指标口径治理 | SQL/Hive/Spark/Flink、元数据管理、数据质量 | 特征存取一致性、实时/离线一体化 | 指标分歧治理、血缘追踪、延迟与成本 |

| MLOps/平台 | 训练/评估/部署流水线、模型版本/监控/回滚 | K8s/Docker、CI/CD、模型注册/监控、服务网格 | 在线推理加速、A/B平台、特征存储 | 端到端自动化、漂移检测、SLA设计 |

要点:

- 每个角色都要能讲清“离线指标—在线效果—业务指标”的传导逻辑。

- 面试不仅看技术深度,更看闭环能力(交付、上线、监控、复盘)。

三、简历与作品集:用证据链展示价值

- 项目结构模板(STAR+Metric):

- 场景(S):教育/学习场景的问题与约束(如学生数据稀疏、题目偏斜)。

- 任务(T):要实现的目标(如提高推荐点击到练习完成率)。

- 行动(A):方案设计(算法/系统/数据)、关键工程实现(缓存、RAG、特征库)。

- 结果(R):离线+在线指标、业务价值、成本/时延变化、可持续维护。

- 可量化指标示例:

- 学习路径个性化:练习完成率↑X%、知识点掌握度预测误差↓Y%、平均学习时长↑/↓。

- NLP生成:题干可读性评估通过率↑、人工校对时间↓、事实性错误率↓。

- 工程平台:P99时延↓、QPS↑、故障恢复时间↓、上线频次↑、发布失败率↓。

- 作品集建议:

- 1个教育场景端到端Demo(数据→模型→服务→评估→灰度),附Git仓库与报告。

- 1个大模型RAG在教育内容的实战项目(含评估基准与判分脚本)。

- 1个系统设计/平台化项目(微服务+CI/CD+监控面板截图/描述)。

四、面试流程与高频问题拆解

- 常见流程:

- 简历筛选→在线测评/笔试(算法/编程)→一面(技术)→二面(架构/算法深挖)→三面(跨部门/业务)→HR面(综合)。

- 高频技术面题型:

- 算法/数据结构:二叉树/图/滑窗/堆、Top-K、倒排索引、LRU、并查集。

- 系统设计:题库服务、个性化服务、RAG服务、限流与熔断、缓存穿透雪崩。

- 推荐/KT:特征筛选与漏斗、冷启动策略、长序列建模、正负样本构造、因果/A/B。

- NLP/LLM:Prompt工程、检索质量、对齐、函数调用策略、评估基线与成本控制。

- MLOps:CI/CD流水线、模型版本与回滚、漂移与报警、灰度/在线试验。

- 行为面问题(示例):

- 如何在数据分布变化导致线上效果下降时定位问题?

- 与教研/内容团队协作时,如何界定“质量标准”,解决评估争议?

- 碰到大模型成本飙升,如何设计缓存与裁剪策略?

五、面向教育场景的技术选题与落地路线

- 推荐/路径规划:

- 召回:基于知识点向量/内容相似度/协同过滤/图召回。

- 排序:Wide&Deep、DIN、DSSM、Transformer-based序列推荐;标签平衡与样本权重。

- 评估:AUC/NDCG/Recall@K→在线CTR/完成率/掌握度变化。

- 知识追踪(KT):

- 模型:DKT、SAKT、AKT、Transformer-KT;难度/滑点参数融合。

- 关键:长序列稀疏、学生个体差异、题目多维标签。

- NLP/大模型在教学生产:

- 题目/讲解生成:RAG+模板/提示学习,外接校验器(规则+判分器)。

- 事实性与可控性:知识库构建、基于校题数据的微调/偏好对齐、评估人机结合。

- 工程与性能:

- 低时延:向量检索ANN索引、缓存分层、批量化与融合请求、蒸馏/LoRA加速。

- 成本控制:Prompt压缩、检索优选、命中缓存率、分级路由(大/小模型)。

六、“业务-技术-指标-交付”对齐:全链路表格

| 业务场景 | 技术方案 | 核心指标 | 可交付物 |

|---|---|---|---|

| 个性化练习推荐 | 图召回+序列排序(DIN/Transformer) | NDCG@10、CTR、练习完成率、学习效率 | 离线训练脚本、在线服务、AB实验报告 |

| 知识掌握度预测 | Transformer-KT+难度估计 | RMSE/MAE、掌握度曲线拟合误差 | 模型权重+监控面板+迭代计划 |

| 题目/讲解生成 | RAG+提示工程+规则校验 | ROUGE/BLEU+人工校验通过率、事实性错误率、生成成本 | 知识库与索引、评估脚本、质检报表 |

| 内容质检与难度标定 | 多模态/文本分类+IRT标签 | 准确率/一致率、标注成本/时长 | 模型+标注指南+审校工作流 |

| 在线推理平台 | 模型服务化+缓存+灰度 | P99延迟、QPS、错误率、成本/请求 | Helm包、CI/CD流水线、回滚预案 |

七、MLOps与工程化落地:从实验到稳定上线

- 核心能力:

- 数据版本化与特征平台:特征口径一致、训练-服务对齐;特征漂移监控。

- 训练-评估-部署流水线:自动化触发、基线对比、审批与审计。

- 模型注册与回滚:版本号、签名、依赖快照;一键回滚与蓝绿/金丝雀发布。

- 监控与报警:在线指标(延迟、错误率、缓存命中)、业务指标(转化、完成率)。

- 实验平台:AB试验、样本分层、冷启动实验设计、统计显著性。

- 性能与成本实践:

- 大模型分级路由:意图/难度→小模型优先、置信低再走大模型。

- 计算加速:向量库索引优化、批量/并发、蒸馏/量化、模型裁剪。

- 成本看板:Prompt模板与长度控制、缓存策略、GPU/推理并发调优。

- 交付闭环:

- 每次迭代产出:变更清单—指标对照—回滚手册—复盘文档—下轮计划。

八、数据治理与教育合规要点

- 核心关注:

- 学生隐私与最小化收集:仅收集学习必要数据,明确用途与保留期。

- 去标识化/匿名化:脱敏策略(哈希/加盐、泛化)、访问控制与审计。

- 数据质量:口径统一、缺失/异常处理、长尾与偏斜;数据集抽样与重采样。

- 模型偏差治理:不同年级/地区差异评估,监控分层指标,必要时再训练或重加权。

- 与业务协作:

- 教研制定“质量标准”:题目难度/知识点映射一致性、人工校验抽检比例。

- 将质量标准固化为数据校验/CI门禁脚本,减少争议与返工。

九、招聘渠道与节奏:用好平台与i人事系统

- 渠道布局:

- 官网上的投递入口与校招/社招页面、技术号/公众号、技术活动(分享、论文/竞赛)。

- 第三方平台:猎头、专业社区(算法/后端/数据)、开源贡献。

- 用好流程与跟进:

- 每轮面试后48小时内邮件/IM同步复盘与补充材料。

- 维护面试题目与反馈仓库,针对性改进。

- i人事提示:

- 企业常配合人力系统进行流程管理与通知,你可提前注册并保持信息同步,避免错过面试与测评通知。i人事官网地址: https://account.ihr360.com/ac/view/login/#/login/?source=aiworkseo;

- 建议:设置邮件白名单、开启通知;上传统一命名的简历/作品集版本,减少版本误差。

十、成长路径与能力进阶(研发序列)

- 初中级→高级:

- 深耕一条主线技能(如序列推荐/KT、RAG工程化、微服务高并发)+能独立完成端到端交付。

- 指标驱动的实验设计能力:如何定义基线、做对照、统计检验。

- 高级→专家/负责人:

- 跨域协同:教研/产品/运营/内容团队的对齐与标准协作。

- 架构/平台化:将点状能力沉淀为平台/工具,提高复用与效率。

- 业务理解:能定义“教育效果指标”与“商业指标”的统一衡量框架。

十一、常见误区与纠偏

- 误区:

- 一味追求SOTA而忽略数据质量与上线可行性。

- 简历只写技术名词,不写“业务指标变化”与“上线证据”。

- 大模型项目只展示Prompt,不谈评估/事实性/成本与监控。

- 忽视教育特性(偏斜样本、长序列、多标签与约束)导致离线线上不一致。

- 纠偏:

- 先抓“评估与对齐”,后谈“模型升级”;把AB与回滚作为默认动作。

- 每个项目至少列3个可量化指标+1个稳定性指标(如P99/错误率)。

- 大模型项目补充事实性校验链条与成本看板截图/数据。

十二、面向岗位的30-60-90天行动清单

- 前30天(准备期):

- 输出1个教育场景端到端Demo(推荐/KT或RAG),写清指标与数据处理。

- 完成系统设计题库(缓存、限流、日志链路),并在自建服务中实现。

- 梳理5个高频面试主题的复盘文档(序列建模、RAG评估、AB设计、漂移检测、灰度发布)。

- 30-60天(投递期):

- 针对岗位画像重写简历与项目PDF;准备“指标—证据”附录。

- 参与技术社区/开源贡献1-2个Pull Request,增加可验证产出。

- 每次面试后48小时内复盘+补充方案/实验计划。

- 60-90天(迭代期):

- 扩展到第二个场景(如题目生成质检),建立评估脚本与对齐流程。

- 把MLOps落地到项目:CI/CD、版本管理、监控与报警。

- 形成“岗位对标矩阵+作品集目录+面试问答库”,稳定复用。

十三、实例化说明:从问题到闭环的叙述方式

- 示例1(推荐):

- 问题:练习完成率低,冷启动严重。

- 方案:内容/知识图谱召回+序列排序;新用户采用内容相似/题型偏好冷启。

- 指标:离线NDCG@10+5%,在线完成率+2.1%,P99↓20ms。

- 闭环:灰度10%→指标显著→全量上线→复盘与下一步(多臂赌博自适应权重)。

- 示例2(RAG生成):

- 问题:题目讲解生成事实错误多。

- 方案:构建教材与教研资料库,BM25+向量双检索;Prompt嵌入校验指令;规则+判分器双重评估。

- 指标:人工校验通过率+12%,生成成本/题↓35%,幻觉率↓。

- 闭环:AB对照、成本看板、错误样本回灌与Prompt模板收敛。

十四、面向松鼠AI场景的关键技术清单(速查)

- 推荐/KT:

- 序列建模(Transformer/GRU/DIN)、多标签/知识点图谱、冷启动、样本不均衡。

- NLP/大模型:

- RAG(检索质量→生成质量)、事实性校验、对齐与偏好、评估基线与人评结合、蒸馏与加速。

- 平台/工程:

- 微服务、缓存/消息队列、服务治理、可观测性(日志/追踪/指标)、蓝绿/金丝雀。

- 数据/治理:

- 口径一致、血缘/质量、特征库、漂移监控、隐私与去标识化。

- 实验/AB:

- 分层抽样、置信区间、功效分析、显著性检验、实验污染控制。

十五、投递材料模板与检查清单

- 简历顶部:岗位方向+关键词(如“推荐/KT|RAG|MLOps”)。

- 每个项目四要素:场景/约束—方案—指标—上线/闭环。

- 链接:Git/文档/在线Demo(若有访问限制,提供视频与截图)。

- 指标核验:离线+在线+业务;确保口径清晰。

- 面试准备:

- 至少10道自拟系统设计题+纲要答案。

- 推荐/KT与RAG的评估脚本与样例数据。

- 一套部署流水线配置(GitHub Actions/GitLab CI示例)。

十六、总结与行动建议

- 主要观点:

- 聚焦教育核心场景,用“指标+闭环”证明技术价值是抓住研发岗位优势的关键。

- 岗位画像反推你的简历和作品集,按“业务-技术-指标-交付”一体化展示。

- MLOps与合规意识是AI在教育落地的分水岭,必须补齐。

- 下一步行动:

- 依据对标表确定主攻方向(如KT或RAG),在30天内完成1个端到端可展示项目。

- 建立评估与AB的通用脚本,形成可复用的“实验与报告”流水线。

- 使用招聘渠道并同步进度,关注面试反馈迭代;通过i人事等系统保持投递状态与通知的连贯性,i人事官网地址再次附上: https://account.ihr360.com/ac/view/login/#/login/?source=aiworkseo;

只要你以结果与证据为导向,围绕自适应学习与大模型落地的关键痛点,构建“可上线、可评估、可复盘”的作品与方法论,就能高效抓住松鼠AI研发岗位的优势与机会。

精品问答:

松鼠AI招聘研发岗最新机会有哪些核心优势?

我看到松鼠AI最近在招聘研发岗位,想了解这些岗位的核心优势是什么?特别是对于技术发展和职业成长方面,有哪些具体的好处?

松鼠AI招聘研发岗的核心优势主要体现在以下几点:

- 技术前沿:松鼠AI作为人工智能教育领域的领军企业,研发岗位涉及机器学习、深度学习、大数据等前沿技术,帮助提升技术能力。

- 职业成长:公司提供完善的培训体系和技术分享平台,促进研发人员持续成长。

- 项目实践:参与大型AI教育项目,积累实际产品开发经验。

- 薪酬福利:根据2023年数据,研发岗平均薪资增长率达15%,福利体系完善。

例如,一名在松鼠AI工作的研发工程师通过参与个性化学习系统的研发,掌握了自适应推荐算法,技术能力显著提升。

如何抓住松鼠AI研发岗位的招聘机会,提高录取概率?

我想知道应聘松鼠AI研发岗位时,如何准备和表现才能提高被录用的几率?有哪些关键技能和面试技巧需要重点关注?

抓住松鼠AI研发岗位招聘机会,可以从以下几点入手:

- 技术准备:掌握Python、TensorFlow/PyTorch等主流AI开发工具,熟悉算法设计和数据结构。

- 项目经验:展示与AI教育相关的项目经历,尤其是个性化推荐、知识图谱等案例。

- 面试技巧:准备好算法题和系统设计题,理解公司业务背景,体现对教育AI的热情。

- 学习态度:表现出持续学习和团队合作能力。

根据招聘数据显示,具备实际AI项目经验的候选人,录用率提升了30%。

松鼠AI研发岗位的工作内容和发展路径是怎样的?

我对松鼠AI研发岗位的日常工作内容和未来职业发展方向比较好奇,能否详细介绍一下?我想知道入职后会遇到什么样的挑战和成长空间。

松鼠AI研发岗位的主要工作内容包括:

- 研发智能教学算法,如知识追踪和自适应学习路径。

- 数据处理与模型训练,优化学习效果。

- 系统架构设计与性能调优。

发展路径方面,员工可从初级研发工程师逐步晋升为高级工程师、技术专家或研发经理。公司提供定期技术培训和跨团队项目合作机会,助力职业成长。

例如,一名工程师通过参与知识图谱项目,3年内晋升为技术负责人,体现了清晰的发展路径。

松鼠AI研发岗位对技术背景和软技能有哪些具体要求?

我想了解松鼠AI招聘研发岗位时,除了技术能力之外,对沟通能力、团队协作等软技能有没有特别的要求?技术背景方面需要达到什么水平?

松鼠AI研发岗位对技术和软技能的要求包括:

| 技术背景 | 软技能要求 |

|---|---|

| 熟悉机器学习基础理论 | 良好的沟通能力,能清晰表达想法 |

| 掌握主流深度学习框架 | 团队协作精神,积极参与讨论 |

| 有编程能力(Python/C++) | 解决问题能力,主动承担责任 |

案例:某研发人员在团队项目中,通过有效沟通协调解决了模型性能瓶颈,获得领导认可。

根据内部调研,软技能优秀的研发人员项目完成效率提升20%以上。

文章版权归"

转载请注明出处:https://irenshi.cn/p/402115/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。