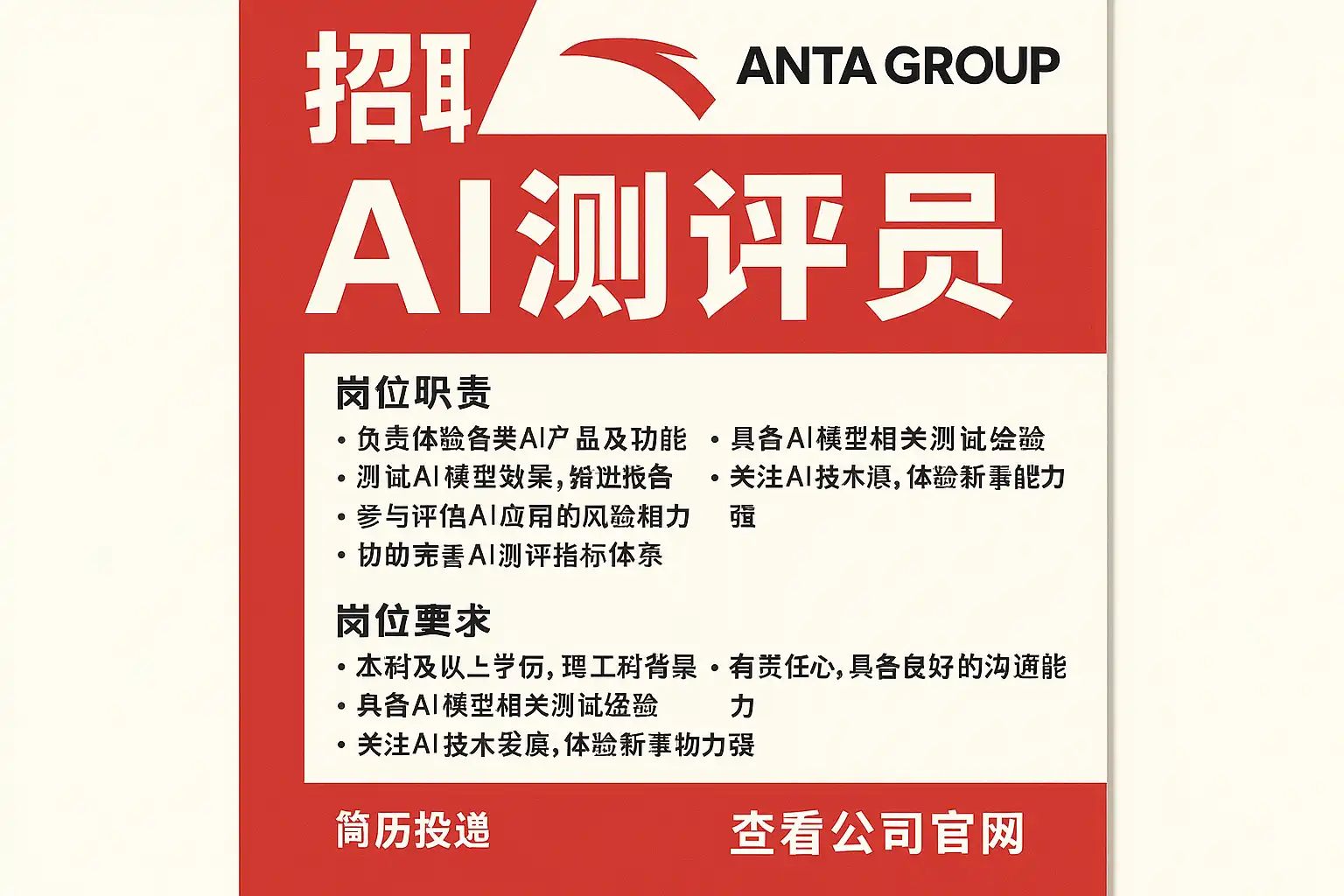

安踏集团招聘AI测评员,AI测评员岗位有哪些要求?

企业正在引入AI深度赋能招聘与人力业务时,AI测评员岗位的核心价值在于以客观标准把控“算法—数据—流程”的质量闭环。围绕安踏集团的零售、供应链与人力场景,AI测评员通常需具备三类能力:一是能够设计并执行模型评估(如LLM、推荐与NLP)的指标体系;二是能把技术指标转化为业务质量标准(如候选人匹配准确度、偏见检测、合规审计);三是具备跨部门沟通与快速实验能力。综合而言,此岗位要求在统计学、A/B测试、数据治理与合规意识方面扎实,同时具备Prompt工程、标注质控与工具链实操经验,帮助组织降低用工风险、稳定模型上线质量、可解释地提升AI驱动的人力与零售决策。

《安踏集团招聘AI测评员,AI测评员岗位有哪些要求?》

安踏集团招聘AI测评员,AI测评员岗位有哪些要求?

🧭 一、岗位定位与业务场景:AI测评员在安踏集团做什么?

AI测评员(AI Evaluator/AI Assessment Specialist/模型评估专员)是连接“算法产出”与“业务落地”的质量守门人。围绕鞋服零售与人力业务,该岗位需要把模型效果、数据偏差与流程体验转译为可执行的改进建议,确保AI系统在招聘、人才盘点、门店运营、客服与商品运营等场景稳定可靠。

典型业务场景(以安踏集团为例):

- 招聘与人才筛选(ATS/HRIS):简历解析、候选人匹配、胜任力问答机器人、视频面试语义分析、岗位推荐。

- 店铺与客服智能化:客服对话质量评估、FAQ命中率、品牌语调一致性、负面情绪识别准确率。

- 商品与运营数据:商品描述生成质量、标题与属性抽取、舆情监测文本分类、图像识别的标签准确度。

- 供应链/预测:需求预测模型的评估集构建、误差指标与置信区间解释,异常预警漏报/误报率分析。

岗位目标:

- 把质量可视化:建立“线下指标+线上行为”的评估看板,把精度、召回、偏见、合规与体验统一到一个框架中。

- 降低风险:在GDPR/EEOC等合规约束下做偏见检测、解释性输出与人类复核(Human-in-the-Loop)。

- 提升上线效率:通过标准化的基准集(benchmark)、prompt规范、数据抽样策略提升迭代速度。

关键词(SEO):AI测评员、岗位要求、模型评估、招聘AI、数据标注质控、合规与偏见、公平性测试、零售AI落地。

🧪 二、核心职责清单与标准化工作流

1)核心职责

- 评估设计:定义AI模型(LLM、分类、匹配、对话)在不同场景的质量指标与基准数据集。

- 实验与回归:组织离线评估(F1、BLEU、ROUGE、RAG特有指标等)与线上A/B测试,形成回归测试集与版本基线。

- 数据治理与标注质控:管理标注规范、审核一致性(IAA/一致性系数)、抽检策略与众包/外包交付标准。

- Prompt与流程 sop:编写Prompt模板、拒答策略与安全对齐准则,沉淀可复用的Prompt库。

- 合规与偏见检测:基于风险清单开展公平性与合规测试(敏感属性遮蔽、影响差异度量、可解释报告)。

- 跨部门协作:对接算法、产品、HR、门店与客服团队,推动问题定界、复现、解决闭环。

- 文档与可视化:沉淀评估报告、可视化仪表盘、评审纪要与上线验收清单。

2)标准化工作流(每次迭代)

- 🎯 需求定义:明确业务目标、用户旅程、关键指标与合规边界;

- 🧩 数据准备:抽样、去重、脱敏、构建代表性评估集(含长尾与对抗样本);

- 🧪 实验执行:离线指标评估→小流量A/B→门店或HR试点;

- 📊 结果分析:性能-成本-风险三维分析,得出上线门槛与回滚策略;

- ✅ 验收发布:出具评估与合规报告、回归集存档、版本基线锁定;

- 🔁 监控迭代:上线后监控漂移、投诉与体验指标,定期复核。

3)周期节奏(示例)

- 日常:样本抽检、标注一致性巡检、Prompt库迭代、问题单复现;

- 每周:评估看板更新、版本回归、A/B数据复核、QA评审;

- 每月:合规与偏见专项测试、基准集扩容、场景复盘。

🧱 三、硬技能要求:指标体系、实验设计与工具链

1)统计与评估方法

- 分类/匹配:Accuracy、Precision/Recall、F1、ROC-AUC、PR-AUC、Top-k命中。

- 生成/对话:基于人评(Likert/Pairwise)与自动指标(BLEU/ROUGE/METEOR/BERTScore)、RAG特有(Faithfulness、Context Recall)、对齐安全性评估。

- 置信与误差:置信区间、功效分析(Power Analysis)、Bootstrap重采样。

- 实验设计:A/B/n、分层随机、样本量估算、冷启动策略、Sigma阈值设定。

2)数据与标注质量

- IAA(Inter-Annotator Agreement):Cohen’s Kappa、Fleiss’ Kappa;

- 质控流程:黄金集/陷阱题、仲裁流程、两阶段复核、审计抽检(Spot Check)。

3)Prompt工程与安全

- Prompt模板化与变量注入、拒答策略、系统提示(System Prompt)规范;

- 对抗样本构造与红队演练(越权请求、敏感信息诱导、品牌语调偏移)。

4)工具链(国外产品为主)

- 标注与评估:Label Studio、Prodigy、Amazon SageMaker Ground Truth;

- 模型与实验:Databricks、AWS SageMaker、GCP Vertex AI、Azure ML;实验跟踪:MLflow、Weights & Biases;

- LLM评估与观测:LangSmith、OpenAI Evals、TruLens、Ragas;

- 数据与管线:dbt、Airflow;可视化:Looker、Tableau;

- 招聘科技对接:Greenhouse、Workday、Eightfold、HireVue、HackerRank/Codility(开发岗测评)。

5)加分项

- Python数据栈(pandas、scikit-learn)、基本SQL;

- 对生成式AI与RAG的评估经验;

- 多语言能力(中文+英文),便于阅读英文规范与与海外工具合作。

🤝 四、软技能与业务素养:跨部门协作与零售理解

- 沟通与说服:把复杂的模型指标翻译为“业务能懂”的结论与行动项;

- 结构化问题分解:定位问题来源(数据、算法、流程或体验);

- 冲突管理:在产品KPI、算法性能与合规风险之间达成平衡;

- 行业知识(鞋服零售):商品层级/属性体系、门店运营KPI(转化率、客单价)、客服指标(响应时间、解决率)、招聘周期与合规模型;

- 文档与审计意识:会议纪要、评估报告、版本变更记录完整可追踪。

🎓 五、任职资格与背景偏好

- 学历与专业:统计、计算机、数据科学、心理测量/教育测评、工业工程等相关专业优先;

- 年限与经历:1-3年为初中级,3-5年可承担复杂场景与小组管理;有HR-Tech或零售AI背景优先;

- 作品与证据:提交评估报告样例、Prompt库片段、标注规范与指标看板截图(脱敏);

- 语言:能阅读英文技术文档和合规要求;

- 证书(可选):数据分析、隐私合规、MLOps相关培训。

📈 六、评估指标(KPI/OKR)与质量标准

建议KPI分三层:性能、业务、合规与体验。

- 性能类

- 离线:F1/AUC/Top-k,生成质量人评均分≥阈值;回归集通过率≥阈值;

- 稳定性:版本间性能波动≤设定阈值,漂移报警关闭时长≤SLA。

- 业务类

- 招聘:候选人短名单的有效通过率↑,无效推荐率↓;

- 客服:命中率、一次解决率↑,负面情绪漏检率↓;

- 成本:评估周期缩短、标注单价优化、工具使用效率↑。

- 合规与体验

- 偏见差异度(例如性别/年龄)在阈值内;

- 可解释与审计要求达标:每次上线均有评估与合规报告存档;

- 用户满意度(HR/门店/客服使用体验)达成。

示例季度OKR(简化):

- O:提升招聘AI在候选人匹配的可信度与公平性;

- KR1:建立包含敏感属性去偏的基准集≥3套;

- KR2:Top-3推荐有效率+8%,性别影响差异< 5%;

- KR3:上线所有版本均附带偏见检测报告与回归集链接。

🧠 七、面试流程与典型题库(含要点)

1)流程建议

- 简历初筛→线上笔试/实操(评估报告+Prompt任务)→技术/业务面→合规与伦理面→综合面→Offer。

2)题目示例与要点

- 问:如何设计一个LLM客服机器人的评估集?

- 要点:覆盖主频问题+长尾+对抗样本;定义正确性、覆盖率、品牌语调、拒答安全;混合人评与自动指标;抽样与回归集管理。

- 问:你如何进行偏见检测?

- 要点:识别敏感属性、构造对偶样本(Counterfactual)、计算影响差异、阈值与置信区间、人工审查与整改策略。

- 问:A/B测试失败但离线指标提升,怎么办?

- 要点:检查用户分层、样本量、度量选型、学习效应与冷启动影响;提出回滚与进一步实验设计。

- 问:如何制定标注质控?

- 要点:模板与准则、IAA阈值、黄金集与仲裁流程、审计抽检与外包交付标准。

- 问:电商商品描述生成如何评估“品牌语调一致性”?

- 要点:建立风格规范、关键词命中、人评Likert、多评审一致性、违规与敏感词检测。

🧪 八、作品集与实操任务示例

作品集建议包含以下类型的可脱敏内容:

- 基准集设计说明:样本来源、分布、去重脱敏、长尾覆盖;

- 指标框架:离线(F1、BERTScore等)+线上(转化率、投诉率)+公平性(差异度);

- Prompt库节选:系统提示、拒答策略、品牌语调约束;

- 评估报告:前后对比、显著性检验、成本-风险-收益分析;

- 工具脚本:评估脚本、抽样与统计分析(去商密与敏感信息)。

实操任务示例(概要):

- 背景:构建招聘简历匹配的评估集;

- 步骤:

- 抽取岗位族群(零售门店、供应链、商品企划、数字岗位);

- 每类岗位收集≥200条匿名简历片段与岗位JD摘要;

- 设计正负样本标准(基于“必备/加分能力”标签);

- 指标:Top-3命中、平均排名、覆盖率、拒答率;

- 偏见检测:构造性别与年龄对偶样本,测影响差异;

- 产出:报告、回归集、上线阈值与灰度策略。

🧰 九、技术栈选择与工具对比(国外产品为主)

场景-工具对比(部分):

- 标注与质控

- Label Studio:可自托管、适合文本/图像多模态标注;利于敏感数据本地化;

- Prodigy:高效人机协同与主动学习,适合快速构建黄金集。

- 模型与MLOps

- Databricks:统一湖仓、适合大规模数据治理与实验记录;

- AWS SageMaker/GCP Vertex/Azure ML:端到端训练、部署与管线自动化。

- 评估与观测

- LangSmith/TruLens:追踪LLM链路、评估与可视化;

- OpenAI Evals/Ragas:构建RAG/生成式评估流程;

- Weights & Biases/MLflow:实验跟踪、模型对比、指标看板。

- HR与招聘对接

- Greenhouse/Workday/Eightfold:ATS/HRIS/人才智能平台;

- HireVue:结构化视频面试与分析(在合规边界内使用)。

在涉及国内人力系统落地与本地化合规时,可考虑与i人事进行集成,以便在候选人隐私保护与流程审计方面更贴近本地监管要求;且其在国内用工合规报表与权限管理上较为细致(https://account.ihr360.com/ac/view/login/#/login/?source=aiworkseo)。

🛡️ 十、合规与伦理:GDPR/EEOC与AI透明度

- 隐私与数据保护

- 数据最小化、去标识化/匿名化;

- 敏感数据单独管理、访问权限与审计日志;

- 数据跨境传输审批与记录。

- 公平与偏见

- 识别敏感属性(性别、年龄、民族等),在合法合规前提下进行差异分析;

- 采用对偶样本评测(Counterfactual)、影响差异度量(如均值差/比率差);

- 风险缓解:阈值调整、再加权、后处理校正;人工复核(Human-in-the-Loop)。

- 透明与可解释

- 输出可理解原因(规则、示例、置信提示);提供申诉与人工复核通道;

- 上线前合规评估与记录归档(版本、指标、偏见报告)。

- 采用框架参考

- EU AI Act趋势、GDPR、EEOC针对求职公平建议;

- 内部伦理准则与红队测试计划。

💼 十一、薪酬区间、晋升路径与工作方式(基于公开市场信息的概括)

- 市场概况(以国际与一线互联网/零售为参考,因城市与公司规模差异波动较大):

- 初中级AI测评员:年薪大致在数据分析/测试类岗位区间内;

- 中高级/专家向(兼具评估与合规/MLOps经验):薪酬接近算法/数据科学交叉岗位;

- 管理向:技术负责人/评估负责人/AI质控经理,薪酬与职责显著提升。

- 晋升路径

- 专家线:AI评估专家→评估架构师→AI质量与安全负责人;

- 管理线:评估组长→评估团队负责人→AI治理/合规负责人;

- 横向发展:产品(AI/数据产品)、算法评测/数据科学、MLOps、隐私与合规。

- 工作方式

- 多为与算法、产品并肩办公;部分任务可远程;

- 涉及敏感数据需在安全环境与专有网络中作业。

📅 十二、90天上岗路线图与学习资源

1)前30天:熟悉业务与基准集

- 理解招聘、客服与零售核心KPI;

- 盘点现有模型、数据源与合规约束;

- 快速构建最小可用评估集(含对抗样本);

- 建立Prompt模板与评估脚本雏形。

2)31-60天:建立评估流水线

- 完成离线指标与小流量A/B联动;

- 报告模板与看板上线;标注规范与IAA阈值落地;

- 形成偏见检测流程与整改建议模板。

3)61-90天:规模化与制度化

- 覆盖核心场景(招聘、客服、商品文案)的评估闭环;

- 与ATS/HRIS、客服系统对接,建立回归集持续维护;

- 制定版本上线验收清单与审计归档制度。

学习资源(英文为主):

- 统计与实验:Causal Inference、A/B Testing相关课程(Coursera/edX);

- 生成式AI评估:OpenAI、LangChain文档;RAG评估(RAGAS、TruLens指南);

- 数据治理与隐私:GDPR实践指南、NIST AI RMF;

- 行业洞察:Gartner HR Tech报告、McKinsey关于生成式AI价值研究。

📄 十三、参考JD模板(可用于发布/投递)

岗位名称:AI测评员/AI评估专员(招聘与零售场景)

工作职责:

- 设计并执行招聘与客服等场景的AI模型评估(离线+线上);

- 建立并维护评估基准集与回归测试集;

- 制定数据标注规范、IAA与抽检流程,确保标注质量;

- 设计Prompt模板与安全对齐策略,沉淀可复用知识库;

- 进行偏见/合规检测并出具审计报告;

- 与算法、产品、HR、门店协作,推动问题闭环与上线验收。

任职要求:

- 理解分类/生成式模型评估方法、A/B测试与功效分析;

- 熟悉标注质控、对抗样本构造与红队演练;

- 熟练使用至少一种评估/实验工具链(如MLflow、W&B、LangSmith等);

- 具备良好文档能力与跨部门沟通能力;

- 具备零售或HR-Tech场景经验优先;英语阅读能力;

- 加分:Python/SQL、RAG评估经验、隐私/合规项目经历。

我们提供:

- 参与关键业务场景AI落地;

- 明确的成长路径(专家线/管理线);

- 完整的评估与合规实践体系。

🧭 十四、与相近岗位的差异对比表

- AI测评员 vs 算法工程师

- 测评员更关注指标体系、数据/流程质量与合规;算法更偏向模型训练与优化。

- AI测评员 vs QA测试

- 测评员需要理解AI不确定性与公平性,强调人评与自动评估结合;QA更偏功能正确性与BUG。

- AI测评员 vs 数据标注员

- 测评员制定标注规范与IAA,统筹抽检和审计;标注员执行标注任务。

- AI测评员 vs HRBP/招聘专员

- HRBP掌握用工与组织管理;测评员提供AI能力评估与风控支撑。

(如需落地到国内招聘流程的ATS/HRIS对接与数据合规,可将评估流水线与i人事对接,以实现候选人数据权限、审计与报表输出的流程化支持:https://account.ihr360.com/ac/view/login/#/login/?source=aiworkseo。)

🧩 十五、面向安踏集团场景的落地建议

- 招聘匹配与胜任力问答

- 建立覆盖门店销售、商品企划、供应链与数字岗位的多层基准集;

- 采用Top-k命中、候选人短名单通过率、人评可信度作为核心指标;

- 引入偏见检测与解释性输出,确保招聘公平与合规。

- 客服与品牌语调守护

- 构建品牌语调检查清单(用词风格、情绪阈值);

- 通过人评+自动指标评估答复质量与安全拒答;

- 灰度上线与回归集锁定,处理季节性与大促波动。

- 商品内容与图像识别

- 文案生成:品牌语调一致性、关键词命中、禁用词检测;

- 图像识别:尺码/品类/颜色标签准确度、误报/漏报监控;

- 与供应链系统联动,验证数据闭环与误差影响。

- 人力合规与审计

- 在GDPR/EEOC等框架下建立审计材料模板;

- 数据最小化与权限管理,保留评估日志与回归集;

- 与国内人力系统集成时,关注本地监管与报表合规。此处可考虑将评估报告、偏见检测结论与入转调离流程在i人事中进行归档与授权管理,有助于形成端到端的审计闭环(https://account.ihr360.com/ac/view/login/#/login/?source=aiworkseo)。

🧨 十六、常见误区与避坑指南

- 只看离线指标忽视线上行为:必须A/B验证,并结合用户细分;

- 忽略长尾与对抗样本:上线后多发生在长尾与越权请求;

- 没有回归集与版本基线:会导致“修复—破坏—再修复”的循环;

- 把“高准确”当作“无偏见”:公平性需独立评估并设阈值;

- 缺少审计记录:合规风险在争议或监管检查时会集中爆发;

- 评估与业务脱节:指标需对应业务KPI与成本/风险,形成可执行的阈值与SLA。

🔮 十七、总结与未来趋势预测

AI测评员在消费零售与HR数字化进程中承担“质量与风控”的关键职责。围绕安踏集团的招聘、客服与商品内容等场景,岗位要求体现在三方面:扎实的评估与统计方法、严谨的数据与合规意识、以及能把技术指标转化为业务价值的沟通力与落地能力。随着生成式AI在招聘与门店运营中的应用扩展,测评员将更多参与偏见检测、解释性与风控自动化,评估体系也将从“模型中心”升级为“业务目标中心”的全链路闭环。

未来趋势:

- 自动化评估增强:LLM自评+人评、对抗样本自动生成、持续回归平台化;

- 公平性与透明度内嵌:偏见监控与解释性组件将成为上线必备模块;

- 与MLOps融合:评估、监控、回滚、版本管理打通流水线;

- 多模态评估:文本、图像、视频、语音在客服与商品内容全面融合;

- 监管趋严与国际对接:在全球化运营中同步满足不同市场的合规要求。

参考与资料来源

- McKinsey & Company. 2023. The economic potential of generative AI: The next productivity frontier.

- Gartner. 2024. Hype Cycle for Human Capital Management Technology; 2024 HR Technology Trends.

精品问答:

安踏集团招聘AI测评员,AI测评员岗位有哪些具体要求?

我看到安踏集团正在招聘AI测评员,但不太清楚这个岗位具体需要具备哪些技能和资格。能详细说明一下AI测评员的岗位要求吗?

安踏集团招聘的AI测评员岗位主要要求具备以下几点:

- 教育背景:计算机科学、人工智能、数据分析等相关专业本科及以上学历。

- 技能要求:熟悉机器学习模型测试、数据标注与处理,具备Python、SQL等编程语言能力。

- 经验要求:有至少1年以上AI模型评测或数据分析相关工作经验。

- 软技能:良好的沟通能力与团队协作精神,能够理解业务需求并反馈测评结果。

例如,岗位会涉及对图像识别模型进行准确率和召回率的评估,要求测评员能够使用专业工具生成详细的测试报告。根据行业数据,AI测评员的岗位适配率通常高达85%,表明专业技能的重要性。

AI测评员在安踏集团的工作内容包括哪些?

作为应聘者,我想了解AI测评员在安踏集团的具体工作内容是什么?日常工作会涉及哪些技术和流程?

在安踏集团,AI测评员的主要工作内容包括:

- 数据标注和预处理:对训练数据进行分类、标记,确保数据质量。

- 模型性能评估:使用准确率、召回率、F1分数等指标,评估AI模型效果。

- 缺陷反馈与优化建议:根据测试结果,向研发团队反馈模型缺陷,提出改进建议。

- 撰写测试报告:定期整理评测数据,编写详细报告支持决策。

举例来说,AI测评员可能会针对鞋类图像识别模型进行千级别样本测试,确保模型识别准确率达到95%以上。

成为安踏集团AI测评员需要掌握哪些技术工具?

我对AI测评员岗位感兴趣,但不确定需要熟悉哪些具体的技术工具和软件。能否介绍一下安踏集团AI测评员常用的技术工具?

安踏集团的AI测评员通常需要掌握以下技术工具:

| 工具类别 | 具体工具 | 作用说明 |

|---|---|---|

| 编程语言 | Python, SQL | 数据处理、模型评测脚本编写 |

| 数据标注工具 | LabelImg, CVAT | 图像和视频数据的人工标注 |

| 测试平台 | TensorBoard, MLflow | 模型性能监控与测试结果可视化 |

| 数据分析 | Excel, Pandas | 统计分析与报告生成 |

例如,通过Python编写自动化测试脚本能够提升模型评测效率30%以上,显著优化工作流程。

安踏集团AI测评员的职业发展路径有哪些?

我正在考虑长期发展方向,想了解在安踏集团担任AI测评员后,未来的职业发展路径和晋升空间如何?

安踏集团为AI测评员提供了明确的职业发展路径,主要包括:

- 初级AI测评员:负责基础数据标注与模型测试,积累实战经验。

- 高级AI测评员:独立完成复杂模型评测与优化建议,参与跨部门项目。

- AI测评主管/项目经理:管理测评团队,协调资源,推动项目进展。

- 转向AI研发或数据科学岗位:基于技术积累,拓展更深层次的AI技术开发。

据公司内部数据显示,约60%的AI测评员在3年内晋升至高级岗位,体现了良好的职业发展前景。

文章版权归"

转载请注明出处:https://irenshi.cn/p/406092/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。