AI算法岗招聘流程详解,如何快速通过面试?

AI算法岗招聘流程详解:如何快速通过面试?

《AI算法岗招聘流程详解,如何快速通过面试?》

**想快速通过 AI 算法岗面试,关键在于:明确岗位差异、以量化成果打造项目叙事、系统化覆盖编码/机器学习理论/ML系统设计三大模块,并以可复现的实验与线上指标证明业务价值。**结合目标公司流程制定时间表、提前准备简历与作品集、强化沟通结构(STAR/MECE),并通过模拟面试与错题复盘降低失误率。对于深度学习与大模型方向,**掌握训练与推理优化(如LoRA、量化、RAG、评测)**与工程落地(监控、灰度、A/B测试)尤为关键。

🚀 一、招聘全流程与时间线总览

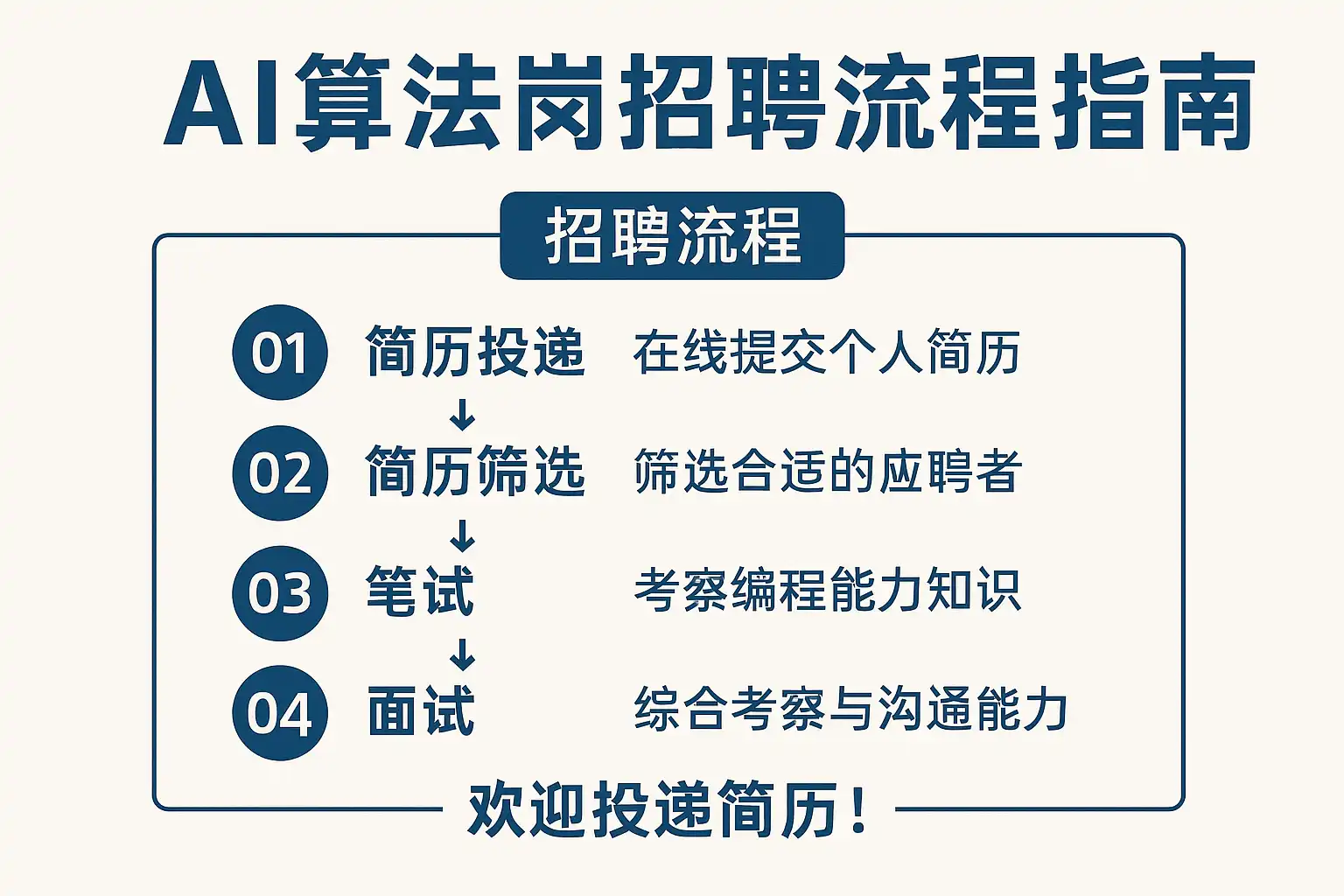

AI 算法工程师/Applied Scientist 的招聘流程具有较强的标准化与阶段性。理解每一环的目的、产出与用时,有助于你精准备考、合理分配精力。

- 常见流程:JD解读 → 投递/内推 → OA(在线评测/笔试)→ 技术初面(Coding/ML基础)→ 技术二面(项目深挖/系统设计)→ 交叉面/Bar Raiser → 业务负责人(HM)面 → HR面/薪资沟通 → 背调/Offer → 入职

- 时间节奏:国际化公司通常 2–6 周;初创公司可能加速至 1–3 周

流程与时间线(示例):

| 阶段 | 目的 | 产出 | 典型用时 |

|---|---|---|---|

| JD 解读与定位 | 明确岗位类型与能力模型 | 定位目标与简历定制 | 0.5–1 天 |

| 投递/内推 | 拿到笔试/面试机会 | 投递记录、内推跟进 | 1–3 天 |

| OA/笔试 | 验证基本编码与数学 | 通过阈值进入面试 | 2–7 天 |

| 技术初面 | 数据结构算法 & ML 基础 | 代码正确 + 分析完善 | 30–60 分钟 |

| 技术二面 | 项目深挖 & ML 系统设计 | 明确业务与工程能力 | 45–75 分钟 |

| 交叉面/Bar Raiser | 通用素质与文化契合 | 评估稳定性与潜力 | 45–60 分钟 |

| HM 面 | 业务匹配与优先级 | 角色匹配确认 | 30–60 分钟 |

| HR 面 | 薪酬与入职安排 | TC框架与期望对齐 | 20–40 分钟 |

| 背调/Offer | 合规与确认 | Offer 发放 | 3–10 天 |

关键建议:

- 对于多轮技术面,尽量将重点安排在 2 周内完成,避免状态波动

- 若有多家公司并行,提前做好窗口期管理,减少冲突

🧭 二、岗位分类与能力模型:先“匹配”,再“超越”

算法岗不是同一种职位。不同公司与团队对“ML Engineer/Applied Scientist/Research Scientist/Data Scientist/MLOps/LLM Engineer”的考察重点不同。先识别岗位画像,再做针对性准备。

| 岗位方向 | 核心关键词 | 面试侧重 | 典型交付 |

|---|---|---|---|

| ML Engineer(应用工程) | 工程、上线、特征、A/B | 编码 + ML系统设计 + 线上监控 | 线上指标提升、稳定上线 |

| Applied Scientist | 模型创新 + 落地 | 论文方法到产品化 | 新模型 + 业务增益 |

| Research Scientist | 算法研究、论文 | 理论推导 + 实验严谨度 | 论文、专利、SOTA对比 |

| Data Scientist(产品分析) | 统计、因果、AB | 数据建模 + 业务洞察 | 分析报告、实验设计 |

| MLOps/ML Platform | 架构、管道、治理 | CI/CD、特征/模型管理 | 训练/推理平台、SLA |

| LLM Engineer | Prompt、RAG、微调 | 评测、优化、成本控制 | LLM 应用、评测体系 |

| CV/NLP/RecSys 专岗 | 任务专项深度 | 领域SOTA + 工程 | 端到端方案与提升 |

匹配要点:

- JD关键词抓取:如“Feature Store”“A/B Testing”“CUDA/ONNX”“LoRA/RAG”“GNN/CTR”等

- 核心能力模型:编码能力(必备)、ML理论、系统设计、领域深度、工程化(数据治理、监控、上线)、沟通与协作

🧾 三、简历与作品集:用数据与可复现性“说话”

你的简历是进入面试的门票。对算法岗而言,量化指标与可复现的作品集尤其重要。

简历策略:

- 一页为主(应届/1–5年),突出“项目产出 + 可复现链接”

- 每条经历使用“动作+方法+量化业务指标”,例如:

- 设计召回+重排两阶段推荐,将DAU点击率提升 7.2%,广告eCPM 提升 4.1%,在双十一流量峰值保持 P95 延迟 < 120ms(K8s 扩缩容 + Redis 缓存)

- 基于LoRA对开源 7B 模型微调客服语料,解答准确率由 72% 提升至 87%,推理成本下降 38%(8-bit 量化 + KV Cache)

- 关键字自然覆盖:PyTorch/TensorFlow、scikit-learn、Ray/Airflow、Faiss/ANN、Kafka、A/B、Feature Store、Prometheus/Grafana

- 附上链接:GitHub、Hugging Face Spaces、Kaggle、技术博客、Demo视频、Notion 文档

- 公开数据/代码:README 中给出数据准备、复现实验脚本、指标对齐方式

作品集建议:

- 端到端案例:数据→特征→模型→部署→监控→A/B→复盘

- 评测卡:训练曲线、混淆矩阵、PR/ROC、线上指标、成本对比

- 模型卡(Model Card)与数据卡(Data Card):合规与偏见说明(与Gartner等合规框架一致的精神,Gartner, 2024)

常见误区:

- 只写模型名称不写业务指标

- 多个项目“堆砌技术名词”但无可复现链接或实验设计

- 缺少失败实验与错误分析

💻 四、OA/笔试:编码、数学与ML基础的“门槛线”

在线评测的目标是快速筛掉基础不牢的候选人。

常见考点:

- 编码与数据结构:数组/字符串、哈希、栈队列、链表、二叉树、堆、二分、滑窗、并查集、拓扑排序、图最短路

- 复杂度分析:时间/空间/边界情况

- 数学与统计:线性代数(SVD、特征值)、概率(条件概率、贝叶斯)、优化(梯度下降、凸性)、偏差-方差权衡

- ML 基础:逻辑回归、SVM、树模型、特征工程、交叉验证、过拟合/欠拟合

- 框架轻编码:PyTorch 前向/反向、DataLoader、nn.Module、梯度检查

训练工具建议(学习资源对比):

| 资源 | 适用场景 | 优点 | 注意事项 |

|---|---|---|---|

| LeetCode(中等/困难) | 编码刷题 | 题量大/讨论区 | 聚焦高频题 |

| EPI/CLRS | 数据结构/算法理论 | 体系完整 | 注意与面试题型对齐 |

| Stanford CS229/CS231n | ML/DL 基础 | 体系化 | 理论与工程结合 |

| Hugging Face Course | NLP/LLM 实作 | 贴近前沿 | 深入需配实验 |

通过技巧:

- 写出边界用例并在代码前“口述”复杂度

- 用伪代码→再写实现,必要时先通过样例

- 提交前自测:空数组、重复元素、极值

🧠 五、技术面详解:Coding、ML 理论与系统设计

技术面一般围绕三大模块展开:

- Coding 面(30–45 分钟)

- 目标:验证编码熟练度、复杂度意识、可读性

- 做法:快速澄清输入输出、写出边界、讲解思路→实现→测试

- 加分:合理的函数拆分、变量命名、处理异常场景

- ML 理论(30–45 分钟)

- 机器学习:损失函数选择、正则化、交叉验证、特征重要性、树模型与集成(XGBoost/LightGBM)

- 模型选择策略:偏差-方差、学习曲线、特征筛选、模型融合

- 误差分析:数据偏见、样本不均衡(重采样、加权损失)、漂移检测

- ML 系统设计(45–60 分钟)

- 目标:从0到1设计可上线的机器学习系统,兼顾可扩展性与可观测性

- 常见框架:

- 需求与目标:业务 KPI(CTR、转化率、留存、时延、成本)

- 数据与特征:在线/离线、特征时效、漏斗、数据质量校验

- 模型训练:离线训练、超参搜索、特征一致性

- 部署与服务:Batch/Online/Streaming、灰度、回滚

- 实验与评估:A/B 测试、功效分析、冷启动方案

- 监控与治理:数据/概念漂移、延迟/吞吐、模型版本化、可追溯

- 关键词:Feature Store、Feature Drift、Canary、Shadow、Faiss/ANN、向量检索、K8s、Kafka、Airflow、Ray、ONNX/TensorRT

面试官常问:

- 你如何选择离线指标与线上业务指标?冲突时如何取舍?

- 当线上性能下降,你如何定位:数据、特征、模型、服务、流量、外部因素?

- 怎样设计A/B测试以避免相互干扰?如何计算样本量与显著性?

根据行业观察,企业更关注“可落地的端到端能力”以及在复杂系统中稳定交付的记录(McKinsey, 2023)。

🧬 六、深度学习与大模型专项:从训练到推理优化

深度学习方向与 LLM 相关岗位的考察重点在“方法理解 + 工程落地 + 成本/延迟优化 + 可评测”。

必备要点:

- Transformer 基础:自注意力、位置编码、掩码、并行化

- 训练技巧:学习率调度、正则化、混合精度、梯度检查点、分布式训练(DDP、ZeRO)

- 微调与参数高效微调:LoRA、Prefix/Adapter、QLoRA

- 知识增强:RAG(检索质量、索引更新、向量库选择)

- 推理优化:KV Cache、张量并行、量化(8-bit/4-bit)、编译器(TensorRT/ONNX Runtime)

- 评测与安全:任务评测(Exact Match/F1/BLEU/ROUGE)、人评一致性、幻觉控制、内容过滤与治理

- 成本治理:QPS 与延迟目标、吞吐-成本权衡、缓存命中率、批量/流式策略

常见问题与要点:

- 为什么 LoRA 有效?低秩假设与参数高效性

- RAG 的上线挑战是什么?召回质量、索引新鲜度、段落切分、域内评测

- 如何构建 LLM 评测体系?任务集、难度分层、自动与人评结合、回归测试

- 如何定位“幻觉”?数据覆盖、检索失败、提示工程、拒答策略

MIT Technology Review 2024 年度趋势指出,企业级大模型应用的竞争点正从“堆参数”转向“工程化与评测框架”,强调可控性与可观测性对落地成败的决定性影响(MIT Tech Review, 2024)。

🧱 七、项目讲述模板:让面试官“看见价值链”

用结构化的项目叙事框架,帮助面试官快速理解你的“端到端能力”。

项目讲述 S-B-P-R-F 模板:

- S(Scenario)场景:业务目标与约束(延迟、成本、合规)

- B(Baseline)基线:之前方案与指标

- P(Plan)方案:数据→特征→模型→上线→监控→实验

- R(Result)结果:量化指标 + 置信区间/显著性 + 线上稳定性

- F(Follow-up)复盘:失败实验、错误分析、下一步计划

示例一:推荐系统(召回 + 重排)

- Baseline:召回用 item-cf,重排用 LR,CTR 7.1%

- 方案:召回加入 ANN(Faiss)+ 双塔,重排用 GBDT+FM 过渡至 DLRM;特征用用户序列/时间窗;上线使用 Feature Store 保证一致性

- 实验:离线 AUC + 线上 A/B(功效分析),P95 延迟控制在 120ms

- 结果:CTR +7.2%,转化 +3.4%,冷启动用 embedding 回填将新物品曝光优化 18%

- 复盘:召回漏斗与长尾问题仍存,拟加入多路召回与重排蒸馏

示例二:CV 检测

- 方案:从 YOLOv5 到 YOLOv8,数据增广(Mosaic、MixUp)、类别不平衡(Focal Loss)、蒸馏小模型部署端侧(TensorRT INT8)

- 结果:mAP@0.5 +5.3%,端侧延迟 -42%,功耗下降 20%

示例三:企业知识库问答(LLM + RAG)

- 方案:向量索引(HNSW)、段落切分 200–400 tokens、重排序(cross-encoder)、QLoRA 微调

- 评测:基准问集 + 人评一致性 0.82,拒答策略降低幻觉率 27%

- 成本:批处理 + KV Cache,推理成本 -35%

🗣️ 八、沟通与答题技巧:结构化,且业务导向

- 澄清(Clarify):在写代码或设计前用 1–2 分钟确认边界与假设

- 结构化表达:STAR/PREP/MECE,先总后分

- 思考外放:边写边讲,暴露权衡逻辑和复杂度意识

- 当不确定:提出假设、给出方案对比与实验验证路径

- 画图:系统设计时建议画数据流、特征流、训练/推理路径

- 反问问题(示例):

- 团队当前最大的线上挑战是什么?(漂移/成本/冷启动)

- 特征与模型的版本化如何管理?是否有统一 Feature Store?

- A/B 平台如何做功效分析与流量分配?

- 对新人的首个90天期望?

📝 九、家庭作业/Take-home:交付“可复现”的工程化产物

交付物结构:

- README:环境、数据准备、训练/评测/推理脚本

- 配置与随机种子:保证复现;记录实验日志与参数

- 报告(不超过 4–6 页):问题定义、方法、实验设计、结果与误差分析、上线考虑(延迟/成本/扩展)

- 可测试 Demo:API/Notebook/Space 链接

质量加分:

- 基线对比与消融实验

- 错误分析:长尾样本、混淆类别、漂移样本

- 代价-收益:推理时间、GPU 显存、吞吐

💼 十、Offer 与谈薪:结构、级别与节奏

- 薪酬组成:Base + 奖金 + 股权/期权 + 签约金;注意归属(vesting)与税务

- 级别定位:对照 JD 影响范围与技术深度,准备证据清单(项目规模、跨团队协作、条线影响)

- 谈判策略:

- 货比三家,沟通“期望区间”与“底线”

- 以“职责匹配与影响力”为核心理据,而非单纯价格

- 关注非现金条款:远程、签证支持、学习预算、设备、调岗可能

🌍 十一、海外与国内流程差异、合规与远程

- 海外(北美/欧洲):流程更标准化,强调平等与合规(EEO)、隐私(GDPR)、背景调查

- 赞助与身份:需要提前确认工作许可与签证支持政策

- 远程岗位:更重视异步协作、文档化与自驱;面试可能增加情景题与书面表达

合规意识:

- 数据治理与用户隐私:尤其是 RAG/推荐中对 PII 的处理

- 模型公平性与偏见评估:记录评测过程,并在文档中说明约束与风险

🧩 十二、常见高频面试题与要点

编码与算法:

- 滑动窗口 vs 双指针:何时选用?规模与单调性判断

- 二分边界条件:左闭右开 vs 左闭右闭的选择

- LRU/LFU 设计:时间与空间复杂度、并发安全(可口述)

机器学习基础:

- 逻辑回归为何适合二分类?Sigmoid 与交叉熵的由来;过拟合如何控制

- 树模型的优势与瓶颈:可解释性、对数值/类别特征处理、与深度模型融合路径

- 不均衡样本:加权损失、阈值移动、PR 曲线优于 ROC 的场景

深度学习/LLM:

- Transformer 的注意力复杂度与优化策略(稀疏注意力、FlashAttention 的思路)

- LoRA 的原理与在 7B/13B 上的实践坑点(Rank、目标层选择、稳定性)

- RAG 失败的两大主因:召回质量与重排序,如何做诊断

系统设计与上线:

- 如何设计推荐系统的特征管线与在线服务?特征时效性、实时与离线融合

- 模型监控:数据漂移(PSI/KS)、概念漂移、反馈环;报警与回滚策略

- A/B 的功效(Power)与样本量估计:统计显著性、停表风险

🧭 十三、备考路线图(4–8 周)与资源清单

4 周加速路线(在职/临近面试):

- 第1周:简历/作品集完善;刷 15–20 道中等题;复盘树模型/正则化/交叉验证

- 第2周:系统设计专题(推荐/检索/特征与A/B);两次模拟面;准备项目讲述

- 第3周:DL/LLM 专项(Transformer、LoRA、RAG、量化/推理优化);实现一个端到端小项目

- 第4周:错题与面经复盘;高频题清单巩固;进行 2–3 场 Mock 面试

8 周系统路线(转岗/应届):

- 基础期(2 周):算法与数据结构;CS229 知识框架

- 强化期(3 周):端到端项目 + MLOps;阅读“ML 技术债”论文并实践

- 冲刺期(3 周):模拟面试、系统设计、LLM 工程化与评测

精选资源:

- 课程:Stanford CS229/CS231n、DeepLearning.AI 的 MLOps 与 LLM 课程

- 文档:scikit-learn User Guide、PyTorch/TensorFlow 官方教程

- 工程论文:Hidden Technical Debt in ML Systems(理解特征/数据/服务的复杂依赖)

- 博客与社区:Hugging Face、Ray、ONNX Runtime、Faiss

🏢 十四、从企业视角反向理解:结构化面试与工具链

企业在评估算法岗候选人时,更偏好“结构化、可比对、可追溯”的流程。理解这一点有助于你“反向优化”准备。

面试官评估维度(示例):

- 编码(正确性、复杂度、鲁棒性)

- ML 理论(建模、评估、误差分析)

- 系统设计(可扩展、可观测、上线意识)

- 业务影响(指标、ROI、实验设计)

- 协作沟通(结构化表达、文档化、跨团队)

海外常用 ATS 与协作工具:

- Greenhouse、Lever、Ashby、Workday(职位管理、面试安排、评分卡)

- HackerRank/Karat(在线评测/远程面试)

- Confluence/Notion(知识库)、Slack(异步协作)

如果你作为候选人参与多轮安排,建议主动提出“统一时间窗”,并以邮件或文档方式保留沟通记录。对于中大型团队,结构化流程能显著降低偏差与漏评风险(McKinsey, 2023)。

在有些企业场景下,引入合规的招聘管理系统可提升候选人体验与效率。若团队需要在国内进行批量面试排期、流程追踪与评分归档,可考虑以 ATS 对齐流程,例如通过i人事( https://account.ihr360.com/ac/view/login/#/login/?source=aiworkseo;)进行职位发布、简历筛选、面试邀约、评分卡沉淀与报表分析,以便统一口径与数据留存。

🧰 十五、实战清单:按环节对勾,避免临门失误

- JD 对齐:列出岗位“必考+可选”技能清单,对勾自检

- 简历:每条项目一段可量化成果;附 Demo/仓库链接

- OA:高频题过一遍,复杂度/边界表达熟练

- 项目讲述:S-B-P-R-F 模板背熟,准备图示

- 系统设计:两个通用模板(推荐/LLM-RAG),准备可画图的 pipeline

- LLM:准备微调与评测的可落地方案(LoRA、评测集、成本控制)

- 反问问题:准备 6–8 条,优先问“团队挑战与平台能力”

- 面试前 24 小时:复盘错题、梳理失败案例、确认设备与网络

- 面试后:发送感谢信,补充文档或实验结果

🧩 十六、典型场景问答示例(要点速记)

- 问:线上指标变差但离线 AUC 变好?

- 答:数据分布漂移、目标不一致、样本选择偏差;检查线上流量构成与冷启动;评估阈值与代价权衡;必要时灰度回滚

- 问:如何扩展 RAG 以应对知识更新?

- 答:增量索引、向量与倒排混合检索、重排序、索引新鲜度监控;文档切分策略与元数据过滤;定期黄金集回归测试

- 问:AB 测试样本量如何估算?

- 答:设定显著性 α、功效 1-β、最小可检测效应 MDE;使用标准公式或平台工具;控制重叠实验与干扰

- 问:推荐系统冷启动?

- 答:画像回填、内容特征/多模态、相似度迁移;流量保护与探索(Epsilon-Greedy/TS)

🧪 十七、错误分析与复盘方法

- 采样与切片:按照地理、时间、设备、长尾用户切片看指标

- 归因:数据质量(缺失、异常)→ 特征(泄露/时效)→ 模型(过拟合/欠拟合)→ 服务(延迟/容灾)

- 工具:实验追踪(Weights & Biases/MLflow)、日志结构化(ELK)、监控(Prometheus/Grafana)

- 文档化:每次重要实验都留“实验卡”,记录参数、结果、结论与后续动作

🧑🤝🧑 十八、候选人体验与流程协同(对你有直接影响)

- 预约与提醒:明确时区、视频会议链接、编码平台

- 面试节奏:如果题量过大,主动建议分两题并给出时间分配

- 冲突解决:提前沟通已有 Offer 的时间线,寻求合理加速

- 合规沟通:避免询问与工作无关的个人信息;如遇不当问题,礼貌回避并回到技术主题

如果你发现某家公司流程混乱、反馈不及时,也可以在沟通中委婉建议采用更规范的招聘管理流程。对于本地化团队来说,像i人事( https://account.ihr360.com/ac/view/login/#/login/?source=aiworkseo;)这类系统能够在面试邀约、资历分流与评分卡收集方面提高透明度,进而减少候选人的不确定感。

🧱 十九、常见“踩坑”以及如何避免

- 技术叙述“只讲模型不讲业务”:用线上指标、显著性、成本/延迟补齐

- 项目仓库不可复现:缺环境/数据/脚本;用 Docker/conda + README 解决

- 系统设计不落地:缺监控/回滚/灰度;补上可观测性与应急预案

- LLM 方向“只会调 API”:准备自建 RAG、微调与评测,用数据/成本证明能力

- 谈薪只谈数字:转而讨论职责范围、资源、成长路线

🔭 二十、总结与未来趋势预测

要快速通过 AI 算法岗面试,回到三个关键词:匹配、量化、落地。匹配岗位能力模型,量化项目影响,用工程化与可复现的方法把“好点子”变成“真指标”。在流程上,准备结构化的项目叙述与系统设计模板,结合模拟面与错题复盘,显著降低发挥波动。

未来 12–24 个月趋势:

- 从 MLOps 向 LLMOps 演进:数据与评测成为核心资产

- 端到端评测与可观测性平台常态化:漂移/幻觉/一致性被量化管理

- 低成本高效推理:量化、蒸馏、缓存、并行与编译器协同优化

- 数据治理与合规内嵌:模型卡/数据卡、审计与回放能力成为面试亮点

- 角色融合:Applied Scientist 既要能读论文,也要能把系统跑通、把 KPI 做上去

把握这条主线,你的准备将更有“抓手”。在求职竞争加剧的环境中,能稳定地把“实验室结果”变成“线上价值”的候选人,依然会脱颖而出。

参考与资料来源:

- McKinsey. 2023. The State of AI 2023: Generative AI’s breakout year.

- MIT Technology Review. 2024. 10 Breakthrough Technologies and enterprise AI trend analysis.

精品问答:

AI算法岗招聘流程一般包括哪些环节?

我最近在准备AI算法岗的面试,但不太清楚招聘流程具体有哪些环节。能否详细介绍一下AI算法岗的招聘流程,帮助我更好地有针对性准备?

AI算法岗的招聘流程通常包括以下几个关键环节:

- 简历筛选:HR或招聘系统根据关键词匹配筛选简历。

- 笔试/在线测试:测试算法基础、编程能力及数学知识。

- 技术面试:通过结构化面试考察算法设计、代码实现及项目经验。

- 综合面试:评估沟通能力、团队协作及职业规划。

- 背景调查及offer发放。

根据2023年某招聘平台数据,约72%的AI算法岗位会安排至少两轮技术面试。了解每个环节的重点,有助于提高面试通过率。

如何高效准备AI算法岗技术面试?

我对AI算法岗位的技术面试感到有些紧张,想知道有哪些高效的准备方法和学习资源,能够帮助我快速提升面试表现?

准备AI算法岗技术面试可以从以下几个方面入手:

- 算法与数据结构:重点复习排序、图论、动态规划等核心算法。

- 编程语言熟练度:建议掌握Python或C++,熟悉常用库如NumPy。

- 项目经验梳理:用STAR法则(Situation, Task, Action, Result)准备项目介绍。

- 模拟面试练习:通过LeetCode、牛客网等平台进行刷题。

例如,刷题平台数据显示,连续刷题30天可提升面试通过率平均达20%。结合系统学习和实战演练效果最佳。

AI算法岗面试中常见的技术题有哪些类型?

我想知道在AI算法岗位面试中,常见的技术题型都有哪些?这样我能更有针对性地复习和准备。

AI算法岗面试常见技术题主要分为以下几类:

| 题型 | 内容描述 | 案例示范 |

|---|---|---|

| 算法设计 | 动态规划、贪心、回溯等 | 设计一个最短路径算法 |

| 机器学习基础 | 模型原理、损失函数、优化算法 | 解释梯度下降的工作机制 |

| 编程实现 | 代码编写与调试 | 实现二分查找算法 |

| 数学基础 | 线性代数、概率统计基础 | 计算贝叶斯概率 |

结合实际岗位需求,准备这些题型可以显著提升面试表现。

有哪些技巧可以帮助我快速通过AI算法岗面试?

我感觉AI算法岗面试竞争激烈,想知道有哪些实用技巧可以帮助我快速通过面试,提高成功率?

快速通过AI算法岗面试的技巧包括:

- 针对岗位定制简历,突出相关项目和技能。

- 熟练掌握核心算法及其应用场景。

- 用案例讲解项目经验,突出解决问题能力。

- 注重沟通表达,清晰阐述思路。

- 多做模拟面试,提升临场应变能力。

数据显示,准备充分且具备良好表达能力的候选人,面试通过率平均提升30%。合理规划准备时间和内容,能有效缩短面试周期。

文章版权归"

转载请注明出处:https://irenshi.cn/p/409979/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。