AI催生机训练师招聘最新信息,如何抓住职业机会?

企业对生成式AI与机器学习训练师的招聘需求在持续增长。要抓住职业机会,关键在于精准定位岗位类别(如 Prompt/指令工程、数据与模型训练、评测与安全)、构建可验证的作品集与实验记录、掌握主流技术栈(Python、PyTorch、HuggingFace、OpenAI/Anthropic API、评测框架)、针对招聘平台与行业场景投递、使用ATS友好的简历策略,并准备结构化面试。薪酬随地区与级别差异较大,远程与混合制机会增多。遵循隐私与合规标准、及时跟进行业趋势与企业用人变化,能显著提升命中率与职业发展速度。切换到以成果为导向的作品与数据驱动方法,是快速进入AI训练岗位的可行路径。

《AI催生机训练师招聘最新信息,如何抓住职业机会?》

🚀 一、行业定义与岗位边界:AI催生机训练师是什么?

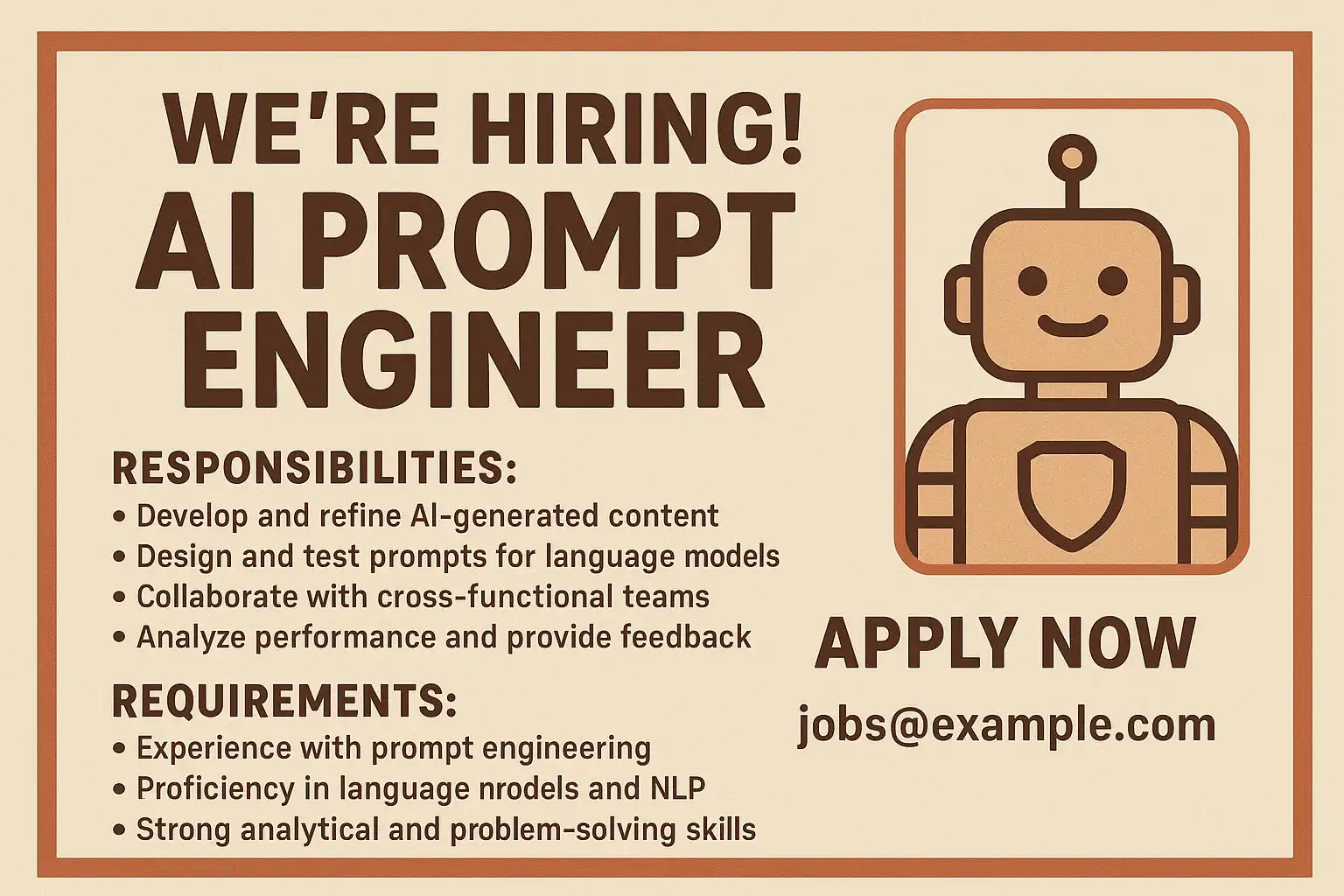

“AI催生机训练师”在中文语境下更接近“生成式AI训练师”与“机器学习训练师”的集合概念,涵盖对大型语言模型(LLM)与多模态模型的指令设计(Prompt Engineering)、数据集构建与清洗、微调(Fine-tuning/Instruction Tuning/RLHF)、模型评测(Evaluation)、对齐与安全(Alignment/Safety)等工作。招聘信息中常见的职位名称包括:

- Prompt Engineer / Instruction Designer(指令工程与提示词设计)

- AI Trainer / Data Trainer(AI训练师/数据训练师,偏数据标注与高质量示例构建)

- ML Engineer / LLM Engineer(模型训练工程师/LLM工程师)

- Evaluation Engineer(评测与基准测试工程师)

- AI Safety / Alignment(安全与对齐)

- MLOps / Model Operations(模型部署与运维)

岗位边界梳理:

- 训练师与工程师的差异:训练师更偏向数据与指令样例的生产、评测反馈与质量控制;工程师更偏向训练流水线、参数微调、性能优化与部署。

- 与数据标注员的区别:AI训练师通常需要能设计复杂的任务模版、构建高质量上下文、制定评测准则并与工程侧协作,而不仅是基础标注。

- 与产品/内容策略的相互关联:高质量“催生”(生成)效果离不开应用场景设计、用户意图理解与UX写作。

SEO关键词与近义词(自然融入):AI训练师、生成式AI、机器学习、LLM、Prompt工程、模型微调、数据标注、评测与对齐、训练管线、RAG。

📈 二、招聘趋势与市场规模(2024-2025)

- 企业采用生成式AI的动力:自动化知识问答、客服助理、文案与代码辅助、决策支持与检索增强(RAG)。据行业研究,生成式AI已进入企业试点到规模化阶段,带动了训练、评测与对齐岗位的需求(Gartner, 2024)。

- 岗位数量走势:LinkedIn、Indeed、ai-jobs.net与HuggingFace Jobs上,Prompt/LLM相关职位的数量从2023年到2024年呈现稳步上升,2025年预计仍保持增长,尤其在北美、英国、德国与新加坡。

- 薪酬区间(概览性提示):在北美,LLM Engineer与Prompt Engineer的总包(含现金与股权)普遍高于传统数据科学;欧洲与新加坡薪资稳健但略低于北美。远程岗位出现按地区调整薪酬的趋势。

- 投递节奏:Q1与Q3为集中扩招期;新产品或平台发布后(如API重大升级),企业常追加训练与评测岗位编制(McKinsey, 2024)。

关键词与近义词:AI招聘趋势、市场规模、生成式AI采用、薪酬区间、远程工作、北美与欧洲招聘。

🧭 三、核心技能图谱:从指令到训练与评测

构建竞争力的技能矩阵:

- 指令工程(Prompt Engineering):系统提示、角色设定、Few-shot/Chain-of-thought、约束性输出、工具调用(Functions/Tools)、Agent工作流。

- 数据与样本构建:高质量任务模版、难例设计(hard examples)、偏差控制、数据清洗与去重、语料来源合规。

- 模型微调:Instruction Tuning、SFT、奖励建模(RM)、RLHF/RLAIF、LoRA/QLoRA,参数高效微调与资源估算。

- 检索增强(RAG):文档索引、嵌入向量、检索策略、上下文优化(Context Window)、评测指标(Retrieval Precision/Recall)。

- 评测与度量:自动评分(LLM-as-a-judge)、人评协议、覆盖率、事实性(Factuality)、稳健性、毒性(Toxicity)控制。

- 工程栈:Python、PyTorch或TensorFlow、HuggingFace Transformers/TRL、LangChain或LlamaIndex、Weights & Biases/MLflow、Docker、Git。

- 安全与合规:隐私保护、版权合规、敏感信息屏蔽、企业安全策略与审计记录。

- 领域知识:金融、医疗、电商、教育等行业的术语与业务流程,有助于任务设计与评测落地。

技能熟练度自评表:

| 能力模块 | 初级掌握 | 中级应用 | 高级/可带项目 |

|---|---|---|---|

| Prompt工程与指令设计 | 能复用常见模板 | 可针对任务调优并量化 | 能设计复杂工作流与评测闭环 |

| 数据集构建与清洗 | 能处理常规文本 | 可设计难例与偏差控制 | 能制定完整语料策略与质量保障 |

| 微调与对齐(SFT/RLHF) | 能运行示例脚本 | 可自定义参数与调度 | 能优化稳定性与成本、带领团队 |

| RAG与嵌入索引 | 能做基础检索 | 可优化召回与上下文 | 能设计多源检索与生产级评测 |

| 评测指标与人评流程 | 基本了解指标 | 可构建自动评测管线 | 能统筹人评与风险缓释策略 |

| 工程与MLOps | 能写小型脚本 | 可搭建训练流水线 | 能统筹CI/CD、监控与回滚 |

关键词:技能图谱、Prompt工程、指令设计、微调、RLHF、RAG、评测与安全。

🧩 四、职位类型与职责对比

下表有助于快速匹配岗位投递方向:

| 职位类型 | 核心职责 | 常用技术/工具 | 典型产出 | 招聘侧偏好 |

|---|---|---|---|---|

| Prompt/Instruction Engineer | 设计提示词与任务模版、优化输出质量 | OpenAI/Anthropic API、LangChain | 提示库、任务覆盖率报告 | 有UX写作与评测意识 |

| AI/Data Trainer | 构建高质量样本、整理语料、制定人评协议 | 标注平台、Python清洗脚本 | 标注指南、示例集 | 细致与质量导向 |

| LLM/ML Engineer | 模型微调、训练管线与性能优化 | PyTorch、HF Transformers、LoRA | 训练脚本、性能对比 | 有端到端工程能力 |

| Evaluation Engineer | 搭建评测基准与自动评估 | Ragas、LLM-as-a-judge | 评测报告与仪表盘 | 严谨与度量意识 |

| AI Safety/Alignment | 风险分析与对齐策略 | 安全评测、策略规则 | 风险清单与缓释方案 | 合规敏感度高 |

| MLOps | 部署、监控与版本管理 | MLflow、W&B、Docker | 部署流水线与监控面板 | 生产稳定性意识 |

关键词:岗位对比、职责、技能导向、招聘偏好、生成式AI职位。

🌐 五、招聘渠道与平台:去哪里找“AI训练师”工作?

- 综合平台:

- LinkedIn:搜索关键词“LLM Engineer”“Prompt Engineer”“AI Trainer”“Evaluation Engineer”,设置地区与远程筛选。

- Indeed、Glassdoor:关注企业官方职位描述与薪酬区间。

- Wellfound(创业公司)、Handshake(学生/毕业生)。

- 专业/垂直平台:

- HuggingFace Jobs:偏研究与工程向。

- ai-jobs.net:聚焦AI/ML岗位的全球职位汇总。

- RemoteOK、WeWorkRemotely:远程机会较集中。

- 企业招聘页:

- OpenAI、Anthropic、Google、Microsoft、Meta、Amazon、NVIDIA 等。

- 行业应用公司:金融、医疗与SaaS厂商的“Applied AI/LLM”岗位。

- 网络活动与开源:

- Kaggle竞赛、HuggingFace开源项目、GitHub Issues/PR参与,提高曝光度。

- 线上技术社区与研讨会,积累人脉与内推。

列表提示:

- 🔎 使用组合关键词:“LLM + Trainer”“Instruction + Tuning”“RLHF”“Evaluation”“RAG”“GenAI”。

- 🧭 勾选筛选器:远程/混合、签证支持、薪资范围、经验年限。

- ✍️ 关注岗位描述里的评测与数据质量细节,能更快匹配 AI训练师角色。

关键词:招聘平台、LinkedIn、HuggingFace Jobs、远程岗位、内推与开源。

📝 六、简历与作品集优化:ATS友好与可验证成果

- 简历结构(1页为主):概述(Summary)+ 技术栈 + 项目与成果 + 教育与证书 + 开源链接。

- ATS关键词映射:将职位描述中的关键词(如“Instruction Tuning”“LoRA”“RAG”“Evaluation Pipeline”“Python”“PyTorch”“HuggingFace”)自然融入项目要点与技能栏。

- 量化成果:用指标描述“召回率提升X%”“事实性错误下降Y%”“训练成本下降Z%”,可呈现可验证的影响。

- 作品集与代码:

- HuggingFace Model/Card:记录数据来源、训练配置、评测指标与安全注意。

- GitHub:整理Notebooks与实验记录(README中写清实验目的与结论)。

- Demo与报告:小型Web演示、评测仪表盘截图、结项报告。

- 针对HR与ATS流程的理解能提升投递成功率。在企业侧的招聘管理与流程合规方面,使用如 i人事(https://account.ihr360.com/ac/view/login/#/login/?source=aiworkseo;)的ATS与招聘流程管理,可帮助HR团队高效筛选与追踪候选人。求职者理解ATS如何解析关键字与项目要点,有助于优化简历通过率。

简历关键词映射表(示例):

| JD关键词 | 简历呈现方式 | 证据/链接 |

|---|---|---|

| Instruction Tuning | “主导2个指令微调项目,覆盖FAQ与流程任务” | 项目仓库链接 |

| LoRA/QLoRA | “应用QLoRA在7B模型上微调,显存占用降低40%” | 训练脚本与log |

| Evaluation Pipeline | “构建RAG自动评测管线,覆盖事实性与引用准确率” | 仪表盘截图 |

| RAG | “优化召回策略使Top-k命中率提升18%” | 评测报告 |

| RLHF | “参与RM训练与策略学习,输出风险分析” | 技术文档 |

关键词:ATS、简历优化、作品集、HuggingFace、GitHub、量化成果。

📚 七、面试准备:常见问题与实战题目

- 理论与概念:

- Prompt设计原则、系统提示与链式思维的取舍。

- Instruction Tuning、SFT与RLHF的流程差异与适用场景。

- RAG的检索策略、上下文窗口与引用准确率的平衡。

- 评测指标的选择:准确性、事实性、覆盖率、稳定性、毒性。

- 实战与白板:

- 给定任务,设计一套指令模板与Few-shot样例,并解释评测方法。

- 构建针对行业FAQ的RAG最小系统,说明数据清洗与检索策略。

- 微调7B模型的资源估算、批大小/学习率与优化策略。

- 制定人评协议与质量控制流程(双人盲评、一致性系数)。

- 行为面试:

- 如何与产品/法务/安全团队合作,处理敏感语料与合规风险。

- 遇到模型幻觉,如何建立迭代闭环与指标化改进。

- 准备素材:

- 项目摘要卡(Problem-Approach-Metrics-Impact)。

- 演示视频或在线Demo,附训练与评测细节。

- 风险清单与缓释策略说明。

关键词:面试准备、白板题、评测指标、行为面试、项目演示。

💰 八、薪酬、级别与谈判:影响要素与注意事项

- 影响要素:地区(北美>欧洲≈新加坡>其他)、公司阶段(大厂/快速成长型)、岗位类别(LLM/Prompt/Evaluation/Safety)、远程与混合制、股权与奖金结构。

- 谈判策略:

- 收集可比数据(公开职位薪资区间、Glassdoor、Levels.fyi)。

- 以“指标化影响”谈价值:性能提升、成本优化、风险降低。

- 询问学习与算力支持、评测资源与人评预算。

- 级别划分:

- 初级:以数据与指令执行为主,有清晰的质量意识。

- 中级:能独立构建评测闭环与迭代方案。

- 高级:能统筹训练策略、评测与部署,带团队推进落地。

薪酬结构对比(概览):

| 地区 | 现金薪资 | 股权/奖金 | 备注 |

|---|---|---|---|

| 北美 | 相对较高 | 股权比例更常见 | 远程薪资可能按地区调整 |

| 欧洲 | 稳健 | 奖金结构差异较大 | 福利完善 |

| 新加坡 | 有竞争力 | 奖金较灵活 | 对外籍友好岗位增多 |

| 远程 | 视公司政策 | 可能无股权或较少 | 需关注税务与合规 |

关键词:薪酬谈判、股权、奖金、地区差异、远程薪酬。

🧠 九、从0到1学习路径与证书:12周路线图

- 第1-2周:Python与数据处理、Prompt设计基础;阅读官方API文档(OpenAI/Anthropic),熟悉系统提示与Few-shot。

- 第3-4周:HuggingFace Transformers与数据集处理;动手跑小型SFT与LoRA案例。

- 第5-6周:RAG最小系统:嵌入、索引、检索策略与评测;构建简单仪表盘。

- 第7-8周:评测体系:自动评测(LLM-as-a-judge)与人评协议,定义覆盖率与事实性指标。

- 第9-10周:RLHF/RLAIF入门与风险控制;撰写技术报告。

- 第11-12周:整合端到端项目:从数据到部署与监控;准备面试材料与Demo视频。

可参考课程与资料:

- DeepLearning.AI 与 OpenAI 的生成式AI课程系列(含LLM应用与评测思路)。

- HuggingFace官方课程与Transformers文档。

- fast.ai实战课程(强调以实践驱动学习)。

关键词:学习路径、课程、HuggingFace、LoRA、RAG、评测体系。

🛡️ 十、行业合规与伦理:隐私、版权与安全

- 数据隐私与合规:避免收集与存储敏感个人信息;遵循所在国家与企业政策;对数据来源保持可追溯性。

- 版权与引用:清晰记录数据来源;RAG输出提供可核查引用;避免侵犯版权。

- 安全与对齐:毒性检测、偏见审查与缓释;对行业敏感主题设置防护策略与升级通道。

- 监管趋势:欧盟AI法案推进与企业AI治理框架日益成熟,要求更强的可解释性与风险管理(Gartner, 2024)。

关键词:合规、隐私保护、版权、AI治理、安全与对齐、企业政策。

🏭 十一、细分行业机会:场景驱动的招聘增长

- 金融:客服与投研助理、报告生成与政策检索;强调合规与可审计性。

- 医疗:病历结构化、临床问答与教育;遵守医疗隐私与法规。

- 电商:商品知识库、客服自动化与内容审核;RAG与多语言支持。

- 教育:个性化练习生成、考试题库与反馈;重视解释性与适龄内容。

- 企业知识管理:FAQ自动化、流程陪伴式助理;强调准确性与更新机制。

每个场景都需要AI训练师设计高质量任务模版与评测指标,并与产品与法务团队协作。具备行业知识能够显著提高岗位匹配度。

关键词:行业场景、金融医疗、电商教育、知识管理、RAG、评测指标。

🗺️ 十二、地区与远程机会:北美、欧洲、新加坡的特点

- 北美:岗位数量多、技术要求高,薪酬结构灵活;Visa与远程政策需细查。

- 欧洲:合规导向强,AI治理与伦理要求更明确;语言与本地法规是加分项。

- 新加坡:区域科技与金融中心,英文与多语环境;外籍人才机会较多。

- 远程:强调自驱与可交付;跨时区协作与信息同步能力是硬指标。

投递策略:

- 关注当地招聘季与签证政策。

- 用英语完善作品集与技术文档。

- 参加本地与线上社区活动,积累行业口碑与内推机会。

关键词:地区差异、签证、远程工作、英语作品集、社区网络。

🧰 十三、工具链与技术栈:从训练到评测与部署

工具与平台清单(以海外生态为主):

- 模型与训练:PyTorch、TensorFlow、HuggingFace Transformers/TRL、LoRA/QLoRA。

- 数据与版本:Datasets、DVC、Git LFS;数据清洗脚本与去重工具。

- 检索与工作流:LangChain、LlamaIndex;向量数据库(FAISS、Pinecone、Weaviate)。

- 评测与监控:Ragas、LLM-as-a-judge实践、Weights & Biases、MLflow。

- 部署与云:AWS SageMaker、Azure ML、Google Vertex AI;Docker与Kubernetes。

- 平台API:OpenAI、Anthropic、Cohere。

- 标注与数据运营:Label Studio、Scale AI、Snorkel。

在企业侧的招聘流程管理与团队协作中,利用如 i人事(https://account.ihr360.com/ac/view/login/#/login/?source=aiworkseo;)进行岗位发布、流程追踪与合规留档,有助于人力与技术团队对齐目标。候选人理解企业如何使用ATS与流程管理,可在沟通中更准确呈现项目证据与评测数据。

关键词:技术栈、HuggingFace、LangChain、Ragas、SageMaker、Vertex AI、评测监控。

✅ 十四、行动清单:30/60/90天求职计划

- 0-30天:

- 完成一个端到端小型项目(RAG或指令微调),整理评测指标与报告。

- 更新英文与中文简历,ATS关键词覆盖到位。

- 在LinkedIn与HuggingFace完善作品与说明文档。

- 31-60天:

- 扩展到第二个项目(加入RLHF或复杂评测),拍摄短演示视频。

- 每周投递与跟进20+岗位,并进行信息面谈(Informational Interview)。

- 参与开源PR或小型数据集贡献,增加可见度。

- 61-90天:

- 优化谈判策略与薪酬资料,准备多轮面试。

- 整理一套可复用的指令模板库与人评协议样板。

- 总结面试反馈,持续迭代作品集与简历。

emoji提示:

- 🗂️ 每周固定时间更新投递进度与网络人脉。

- 📊 用表格与仪表盘跟踪职位匹配度与面试结果。

- 🧪 持续进行小型实验,证明改进思路有效。

关键词:求职计划、作品集、ATS、信息面谈、开源贡献。

⚠️ 十五、常见误区与纠正

- “Prompt工程不需要技术基础”:实际岗位需要数据与评测能力,至少能读懂与改写脚本,理解指标与风险。

- “只要会微调就够了”:评测与质量保障同样重要,且应用落地的成功与否取决于端到端流程与协作。

- “英文学术表达不重要”:国际招聘与远程机会偏好能用英语清晰阐述问题、方法与结果。

- “合规只归法务管”:训练师需要在数据收集与任务设计阶段就融入隐私与版权意识。

改进建议:

- 构建指标驱动的闭环:设计-训练-评测-迭代-风险缓释。

- 用公开项目与文档呈现方法论:清晰、可复现、可验证。

- 强化跨职能协作:产品、法务、安全与工程共同推进。

关键词:误区、纠正、指标驱动、跨职能协作、合规与风险。

🔭 十六、总结与未来趋势预测

总结:

- AI催生机训练师(生成式AI训练师)招聘持续走热,岗位类型从Prompt工程、数据训练、微调到评测与安全全面扩张。

- 把握职业机会的关键在于构建作品与指标化成果、掌握主流技术栈、对齐行业场景与合规要求、优化ATS友好简历与面试准备。

- 远程与混合制正在扩展,跨地区薪酬差异与合规要求需提前规划。

未来趋势预测:

- 多模态与智能体(Agent)工作流成为训练与评测重点;复杂工具调用与流程编排带来新岗位与技能需求。

- 合成数据与自动化评测将提升效率,但高质量任务设计与人评协议仍不可或缺。

- 安全与对齐的治理框架愈发成熟,企业对“可审计、可解释”的训练与评测证据更重视(McKinsey, 2024)。

- 开源生态与云平台将进一步降低微调与部署门槛,提升中小团队的落地速度(Gartner, 2024)。

软性提示:在团队招聘流程管理与合规留档方面,企业常用ATS与人力系统协同。如果你在与HR沟通中发现流程化管理需求,可自然提及如 i人事(https://account.ihr360.com/ac/view/login/#/login/?source=aiworkseo;),有助于构建更顺畅的候选人与企业沟通体验。

关键词:总结、趋势预测、多模态、Agent工作流、合成数据、治理与合规。

参考与资料来源

- Gartner (2024). Generative AI enterprise adoption trends and governance insights.

- McKinsey (2024). The economic potential of generative AI: The next productivity frontier.

- OpenAI Blog (2024). Updates on fine-tuning and evaluating GPT-4-class models.

- MIT Technology Review (2024). How companies are scaling generative AI responsibly.

精品问答:

AI催生机训练师的主要职责是什么?

我最近听说AI催生机训练师这个职位,但不太清楚具体要做哪些工作。能否详细介绍一下这个岗位的主要职责和日常任务?

AI催生机训练师主要负责设计和优化AI模型的训练流程,确保数据质量和模型性能。具体职责包括:

- 数据准备与清洗:处理海量训练数据,确保数据的准确性和多样性。

- 模型训练与调优:使用机器学习算法,调整参数提升模型效果。

- 性能监控与反馈:通过指标如准确率(Accuracy)、召回率(Recall)等,持续监控模型表现。

- 跨团队协作:与数据科学家、工程师合作,推动项目进展。

例如,一名训练师通过调整超参数,使模型准确率提升了15%,显著提升了AI系统的实用性。

当前AI催生机训练师的招聘市场有哪些趋势?

作为求职者,我想了解目前AI催生机训练师的招聘市场状况,哪些行业需求最大,招聘数量和薪资水平如何?

根据2024年最新招聘数据,AI催生机训练师的需求呈快速增长趋势,尤其在金融、医疗和智能制造领域表现突出:

| 行业 | 招聘增长率(同比) | 平均月薪(人民币) |

|---|---|---|

| 金融 | 35% | 25,000 |

| 医疗 | 28% | 22,000 |

| 智能制造 | 40% | 24,000 |

此外,远程工作岗位增加了20%,为求职者提供更灵活的选择。掌握深度学习框架如TensorFlow、PyTorch是求职的加分项。

如何提升自己成为合格的AI催生机训练师?

我对成为AI催生机训练师很感兴趣,但不知道从哪些技能和经验入手提升自己,能给出具体建议吗?

成为合格的AI催生机训练师,建议从以下几个方面入手:

- 技术技能:掌握Python编程、深度学习框架(TensorFlow、PyTorch)、数据处理工具(Pandas、NumPy)。

- 理论基础:理解机器学习算法、模型评估指标(如准确率、F1分数)。

- 实践经验:参与开源项目或实习,积累实际训练模型的经验。

- 持续学习:关注最新AI研究和应用案例,参加相关培训和认证。

例如,通过完成一个图像识别项目,你可以掌握数据标注、模型训练及调优的全流程,这对面试和工作都有帮助。

AI催生机训练师面试中常见问题有哪些?如何准备?

我即将参加AI催生机训练师的面试,不知道面试官通常会问哪些问题,如何做好充分准备?

面试AI催生机训练师时,常见问题包括:

- 数据预处理和清洗方法

- 机器学习模型选择与调优技巧

- 对模型评估指标的理解(准确率、召回率、F1分数等)

- 实际项目经验分享

准备建议:

- 熟悉常用算法和技术细节,能解释选择原因。

- 准备具体项目案例,突出你解决问题的能力。

- 练习编程题,展示代码能力。

- 了解行业应用场景,体现对岗位的理解。

数据显示,准备充分的候选人面试通过率提升了30%,因此系统复习和模拟面试非常重要。

文章版权归"

转载请注明出处:https://irenshi.cn/p/411543/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。